0 引言

随着深度学习被广泛应用于遥感图像中的目标检测,一系列基于卷积神经网络(CNN)的检测器被提出并且取得了良好的表现[1-4]。然而,许多检测器的开发都使用了通用目标检测框架,而其中水平边界框用于定位目标。对于通常具有复杂背景和密集排列的遥感图像的目标检测,具有额外背景信息的水平边界框 (HBB) 在非极大值抑制过程中难以处理,这可能导致假阴性。由于这种问题的存在,许多带有定向边界框(OBB)的检测器应势而生[5-8]。然而这些框架大多依赖于锚点的设置,对于未知对象需要放置不同比例和纵横比的锚点来进行预测和定位。显然,使用固定参数预测未知物体会使检测器的性能严重依赖先验信息,对参数的变化极为敏感,同时导致冗余计算。为了缓解这个问题,有人提出的无锚框架选择通过训练热图并通过选择热图[9-13]上的峰值来预测对象的关键点。但大多数无锚框架仍然使用水平边界框来定位目标。定向边界框应用在无锚网络中并不是一种流行的做法。

除了骨干框架和锚机制的优化外,还有一些检测器专门通过优化损失函数来提高检测性能。用于边界框回归的一系列损失函数Ln-norm,L1和L2范数在许多检测器中被广泛采用。然而,Ln-norm并不适合作为边框回归的通用指标来评估预测框和真实框之间交并比(IoU)[14-17]。因此,相关研究提出了一系列损失函数直接优化评估度量本身[10-14]。IoU损失函数[14]会首先将所有绑定变量作为一个整体进行回归,但在非重叠情况下存在梯度消失问题。GIoU损失函数[17]扩展了IoU的概念,并通过引入惩罚因子避免了非重叠情况下IoU损失函数的普拉托问题。惩罚因子缓解了非重叠情况下的梯度消失问题,但仍然存在边界框差异测量不全面和收敛速度慢的问题[18]。

本文针对边界框回归提出了一种基于GIoU损失的与尺度无关的GIoU (SGIoU) 损失函数,通过在GIoU损失中添加惩罚因子来衡量2个框的形状之间的差异,将一种特殊的形状表示方法改编成GIoU形式考虑形状差异指标;通过将SGIoU损失应用于无锚检测器,可以生成旋转边界框来预测对象,实现高性能的任意对象目标检测。

1 GIoU无锚图像目标检测算法

1.1 旋转式全卷积单级目标检测器

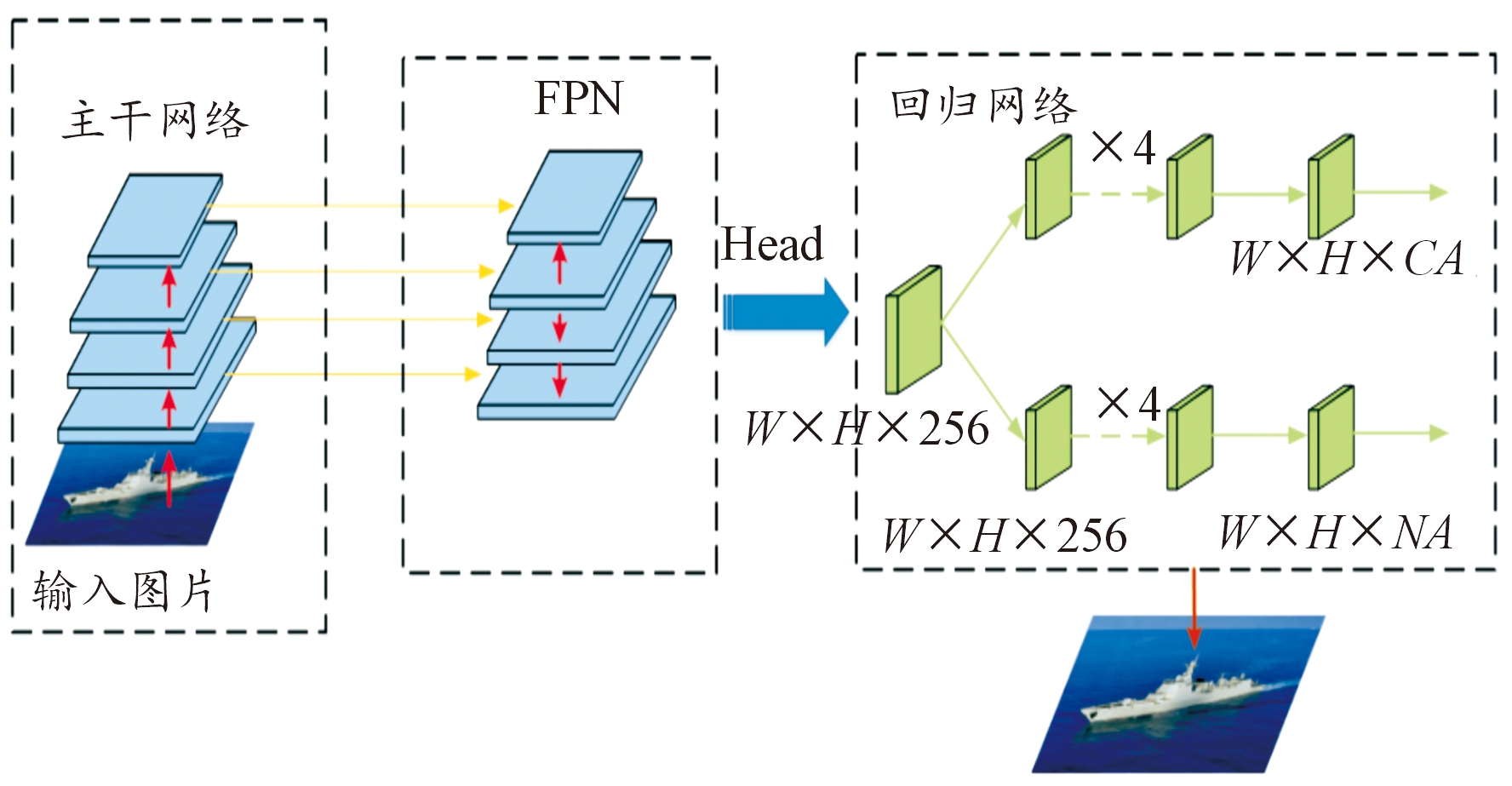

本节通过构建一个无锚基线,为定向边界框 (OBB) 的回归设计与尺度无关的GIoU (SGIoU) 损失,将SGIoU损失应用于基线检测器以构建旋转式全卷积单级目标检测器。旋转式全卷积单级目标检测器的整体结构如图1所示。

图1 旋转式全卷积单级目标检测器的整体结构

Fig.1 The overall structure of a rotating full convolution single-stage target detector

本方法首先使用卷积神经网络作为主干从输入图像中提取特征图,应用 FPN 生成多个比例特征图,并使用一个共享头来回归特征图上点的类别和位置。在回归分支中,使用4个分支来完成对象分类和边界框回归。对于分类,分类分支用于预测置信度,中心度分支用于获取特征图中每个点的中心度。中心度是到目标对象中心的归一化距离。它可以以如下方式定义:

(1)

其中 (l*,r*,t*,b*) 用于描述目标的位置。通过添加中心度分支,远离目标中心的框将被非极大值抑制压低。旋转式全卷积单级目标检测器的训练损失由4部分组成:分类损失、中心度损失、角度回归损失和边界框回归损失。损失函数如下:

(2)

其中, Lcls表示分类的焦点损失,Lcls表示中心度的二元交叉熵 (BCE) 损失,px,y表示分类分数,Lreg_ang表示角度回归的平滑L1 损失,θx,y表示角度回归分数,Lreg_bbox表示边界框回归的SGIoU损失,如![]() 将

将![]() 为1,否则为0。tx,y表示回归分数,Npos表示正样本的数量。

为1,否则为0。tx,y表示回归分数,Npos表示正样本的数量。

1.2 广义IoU损失函数

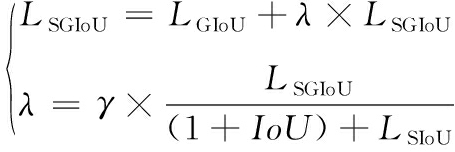

为了在训练时获得更好的 OBBs 回归性能,本文提出了一种基于广义IoU损失的新损失函数:

(3)

其中, λ表示一个正的权衡参数,γ 表示用于调整 λ 的比重。尺度敏感是形状回归中的一个普遍问题,它对小边框的影响比大边框更明显。因此,设计了一个与尺度无关的IoU (SIoU)损失来衡量纵横比的一致性。在开始之前使用以下公式计算边框的宽度和高度:

w=x2-x1, h=y1-y2

(4)

那么可以使用 (w,h) 来表示边界框的形状。

为了得到只与形状相似度而不是与框的纵横比有关的SIoU,利用水平框来计算SIoU损失。如图2所示,首先将2个水平框放在一起计算LSIoU(b,b*),然后改变预测框的宽度和高度来计算LSIoU(b′,b*)。最后,选择最小值作为边界框回归的SIoU损失。详细定义如下:

图2 计算与尺度无关的IoU示例

Fig.2 Example of calculating scale independent IoU

LSIoU=min{LSIoU(b,b*), LSIoU(b′,b*)}

(5)

其中,SIoU为预测框和GT框之间重叠部分,是广义IoU,这个重叠中心不考虑角度,其定义如下:

LSIoU(b1,b2)=

(6)

其中, b、b′和b*分别表示预测框、比例交换预测框和GT框,分别用(w,h)、(h,w)和(w*,h*)。b1、b2由(w1,h1)和(w2,h2)描述。SIoU损失的范围在[-1,1]。

这种新颖的SGIoU损失函数将目标形状差异考虑在内,帮助旋转全卷积单级实现对定向矩形框的准确描述并加快收敛速度。同时,SGIoU损失在优化回归过程中具有更好的性能。

2 仿真分析

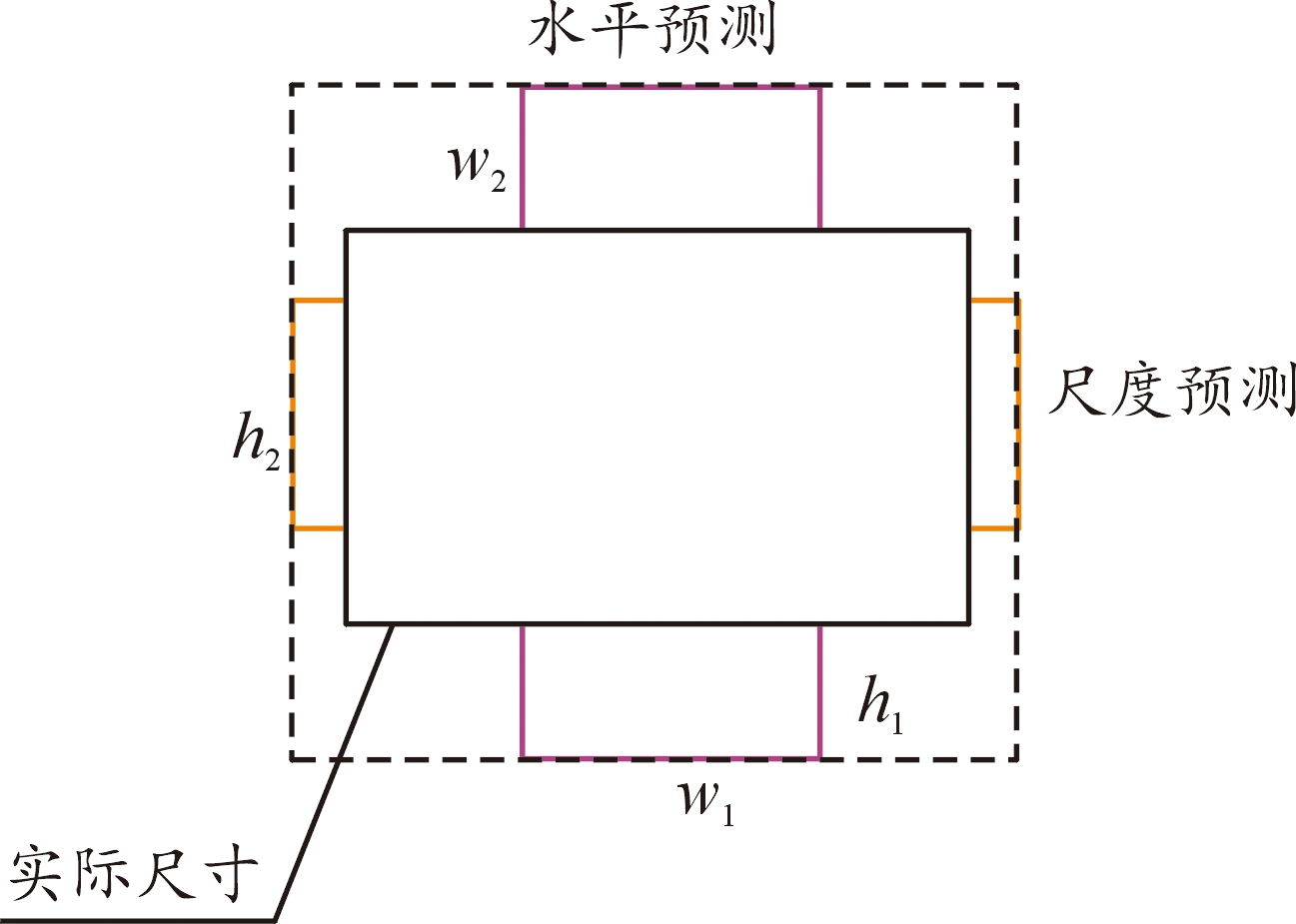

仿真模拟实验旨在将所提出的方法与以前的更一般情况下的GIoU损失、DIoU损失和CIoU损失进行比较。真实数据以 (10,10) 为中心,具有1 个比例(面积为1)和5个纵横比(即1∶3、1∶2、1∶1、2∶1和3∶1)。初始预测框均匀分布在以 (10,10) 为中心、半径为3的圆内平均选择的5 000个位置,其中包括重叠和非重叠情况。在每个位置上,预测框的纵横比设置为与地面实况的纵横比相同,即 1∶3、1∶2、1∶1、2∶1、3∶1,比例设置为0.5、0.67、0.75,1.33,1.5和2。

梯度下降法用于优化边界框回归:

(7)

其中, L(·)指损失函数,是学习率从 0.1 逐渐衰减到0.001,为了加速收敛可将将梯度乘以![]() 由于对于相同的回归情况,不同的损失函数计算得到不同的损失值,在此每个损失函数的性能采用L1-norm评估:

由于对于相同的回归情况,不同的损失函数计算得到不同的损失值,在此每个损失函数的性能采用L1-norm评估:

(8)

仿真实验清楚地表明,无论是优化速度还是最终误差,SGIoU损失下的优化都优于其他3种损失函数。回归案例分析结果见图3。蓝色点是在圆中均匀选择的5 000个点。红色框是在每个位置设置不同比率的锚。绿色方框是以(10,10)为中心的5个不同比率。

图3 回归案例分析

Fig.3 Regression cases analysis

3 实验验证与分析

本节采用遥感数据集HRSC2016以验证所提出方法的有效性。HRSC2016是一个具有挑战性的遥感船舶检测数据集,通过定向边界框来表示遥感船舶。包含1061张各种船舶的图像,分为训练集、验证集和测试集,分别包含436、181、444张图像。将HRSC2016提供的xml文件转换为json文件。用于后续的训练和测试。除此之外,还采用随机翻转、旋转和HSV颜色空间变换进行了数据增强。

利用上面描述的旋转全卷积单级目标探测器作为基线模型,并应用SGIoU损失来优化边界框的回归,在Python 3.8、PyTorch 1.7环境下运行。所有图像大小都调整为 1 024×1 024,使用 SGD 优化器进行训练,初始学习率设置为 0.002 5。在HRSC2016的72个epoch中训练模型,所有模型在 RTX 3090Ti GPU 上进行训练,批量大小设置为 4。

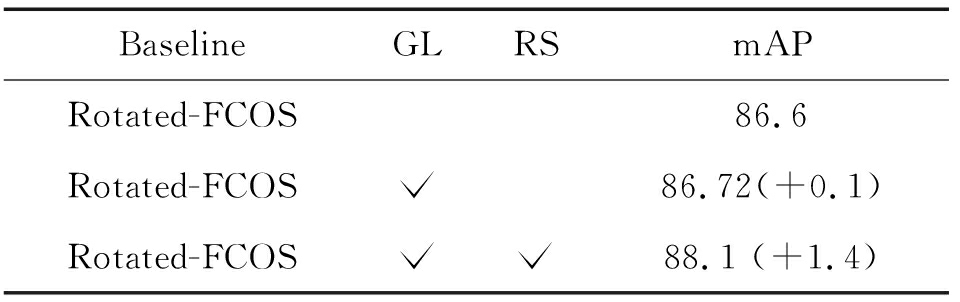

HRSC2016 数据集上进行的实验结果证实了SGIoU损失的有效性。实验结果如表1所示:基线模型是上面详述的旋转全卷积单级目标探测器。回归头输出本节中的定向边界框。该检测器在 HRSC2016 上实现了 88.1% 的mAP,与基线模型相比提高了1.5%。广义IoU(GIoU)解决了IoU在非重叠情况下的弱点,加快了网络的收敛。形状损失考虑了边界框的形状,因此进行了更高的检测精度。它将mAP提高了 1.4%。总而言之,这种与尺度无关的形状损失不仅加速了收敛过程,而且对预测框的形状提供了约束。

表1 不同分量的评价SGIoU损失、GL、SL、RS分别代表广义IoU损失、形状损失、交换比率策略

Table 1 Evaluation of different components SGIoU loss,GL,SL and RS represent generalized IoU loss,shape loss and exchange ratio strategies respectively

BaselineGLRSmAPRotated-FCOS86.6Rotated-FCOS86.72(+0.1)Rotated-FCOS88.1 (+1.4)

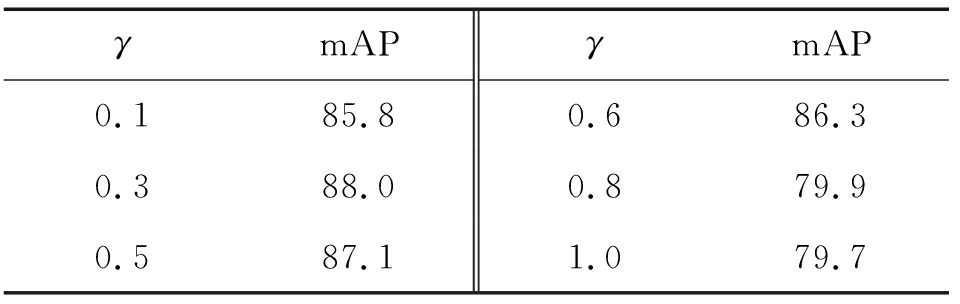

另外通过进行参数敏感性实验以在SGIoU损失中找到合适的超参数设置,结果如表2所示。在存在不确定性抑制项的情况下,在适当增加γ的同时,与尺度无关的形状损失的影响增加,从而导致mAP的改善。但是,当γ太大时,性能会急剧下降。

表2 HRSC2016数据集上的超参数γ分析

Table 2 Hyperparameters on HRSC2016 dataset γ analysis

γmAPγmAP0.185.80.686.30.388.00.879.90.587.11.079.7

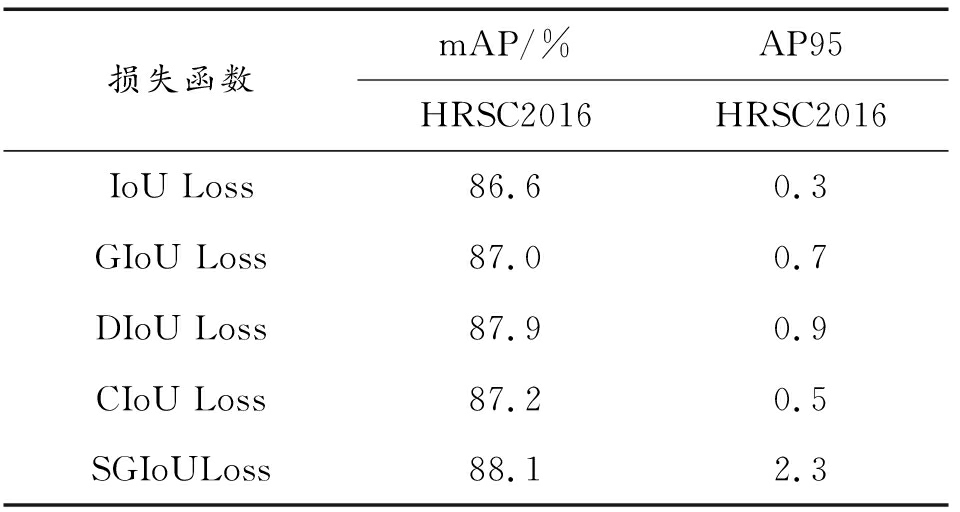

在HRSC2016 数据集上与相关方法对比实验结果如表3所示。主要使用0.5作为阈值来衡量模型的性能。基线模型利用IoU损失作为边框回归的损失函数。GIoU loss 扩展了 IOU的概念,避免了 IOU损失在非重叠情况下的平台期。当GIoU损失用于旋转式目标检测时,它比 HRSC2016上的基线模型分别提高了 0.1%。至于DIoU损失,它结合了边界框和地面实况之间的归一化距离,与 HRSC2016上的基线相比分别增加了 0.3%。CIoU然后整合了所有3个重要的几何因素,从而导致更快的收敛和更好的性能。它比基线模型好 0.6%。所提出的SGIoU损失在旋转物体检测中考虑了框的形状,而没有考虑长宽比,因此预测框对形状更敏感,因此在收敛性和准确性上都取得了更好的性能。与基线模型相比,它在 HRSC2016 上增加了1.5%。IoU、GIoU、DIoU、CIoU和SGIoU阈值的mAP值等于0.95,在表中显示为 AP95。在此阈值下进行的实验证明,与其他方法相比,本方法有助于检测器获得更多高质量的边界框。

表3 HRSC2016上与其他损失函数的比较

Table 3 Comparison with other loss functions on HRSC2016

损失函数mAP/%AP95HRSC2016HRSC2016IoU Loss86.60.3GIoU Loss87.00.7DIoU Loss87.90.9CIoU Loss87.20.5SGIoULoss88.12.3

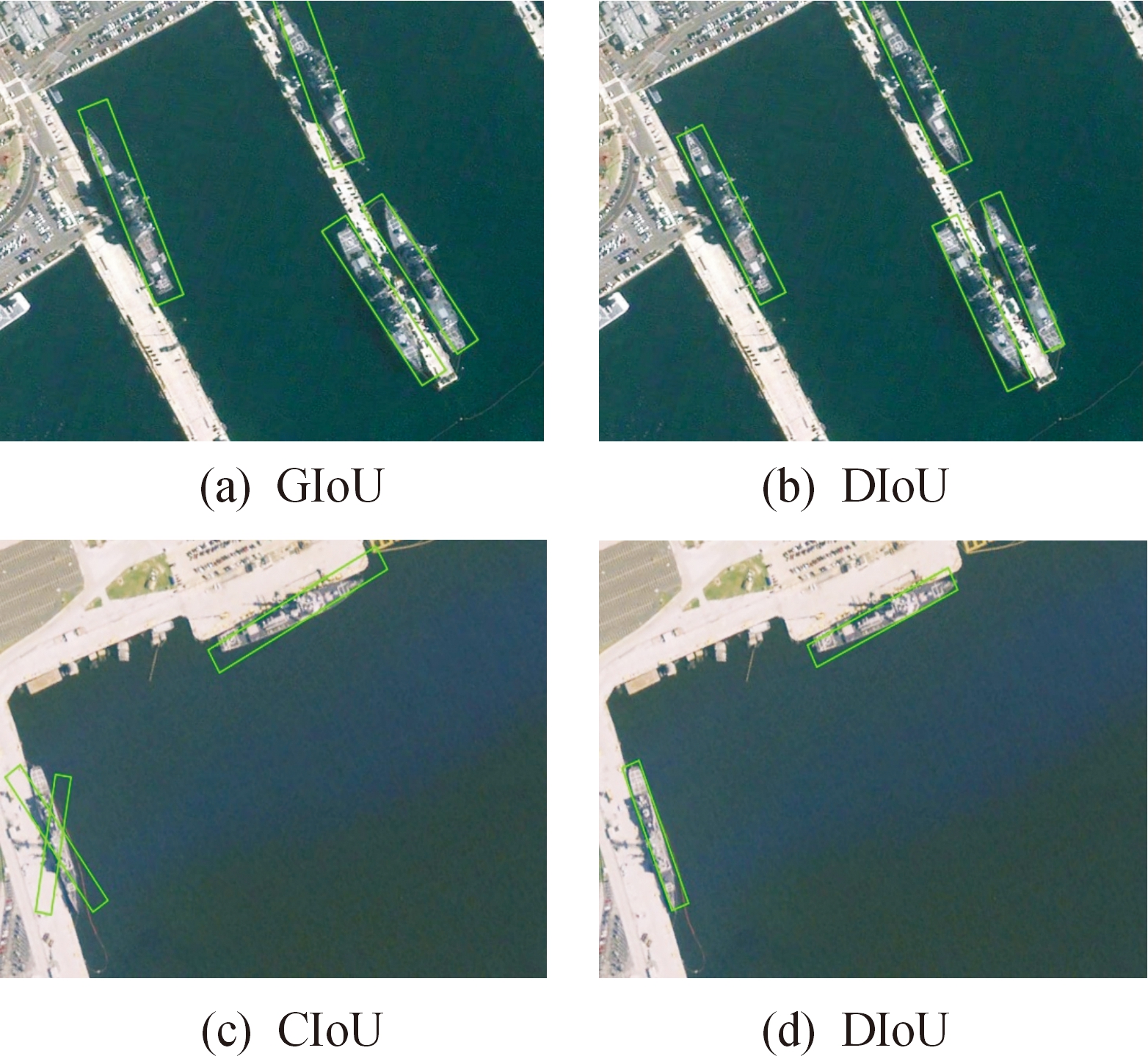

图4显示了检测器在 HRSC2016上的可视化结果,SGIoU损失模型预测边界更加合理和精确。

图4 检测器在 HRSC2016上可视化结果

Fig.4 Results of Rotated FCOS with HRSC2016 dataset

4 结论

光学遥感图像处理中传统的目标检测方法由于存在不同尺度和形状不规则的图像目标,在检测中很难设置具有最优参数的锚点。除此以外,复杂背景和非极大值抑制处理也需要良好对齐的边界框来预测密集目标。然而需要注意的是,回归损失函数与检测器最终最优目标之间的不相容性也对结果的收敛性和准确性拥有难以忽略的影响。为了解决这个问题,本文将旋转边界框回归引入到典型的无锚网络全卷积单级目标检测器中,提出了与尺度无关的GIoU(SGIoU)损失用于图像目标检测的边界框回归。SGIoU损失可以快速将预测框的形状调整为开始时与真实相似的形状,并在回归过程中加快收敛速度。该检测器在 HRSC2016上实现了 88.1%的mAP,与基线模型相比提高了 1.5%。广义IoU(GIoU)解决了IoU在非重叠情况下的弱点,加快了网络的收敛。形状损失考虑了边界框的形状,因此达到了更高的检测精度,它将mAP提高了 1.4%。验证了SGIoU损失为任意对象的目标检测中的边界框回归效果优势。

[1] ZHANG M,CHEN Y,LIU X,et al.Adaptive anchor networks for multi-scale object detection in remote sensing images[J].IEEE Access,2020(8):57552-57565.

[2] 张静,农昌瑞,杨智勇.基于卷积神经网络的目标检测算法综述[J].兵器装备工程学报,2022,43(6):37-47.

ZHANG Jing,NONG Changrui,YANG Zhiyong.Review of object detection algorithms based on convolutional neural network[J].Journal of Ordnance and Equipment Engineering,2022,43(6):37-47.

[3] 任会峰,朱洪前,唐玥,等.基于多级特征稀疏表示的遥感图像分类[J].重庆理工大学学报( 自然科学),2021,35( 7):131- 138.

REN Huifeng, ZHU Hongqian, TANG Yue,et al. Multi-level feature sparse representation based remote sensing image classification[J].Journal ofChongqing University of Technology(Natural Science),2021,35(7):131-138.

[4] XU T,SUN X,DIAO W,et al.ASSD:Feature aligned single-shot detection for multiscale objects in aerial imagery[J].IEEE Transactions on Geoscience and Remote Sensing,2021(99):1-17.

[5] MING Q,MIAO L,ZHOU Z,et al.CFC-Net:A critical feature capturing network for arbitrary-oriented object detection in remote-sensing images[J].IEEE Transactions on Geoscience and Remote Sensing,2022,60(3):91-97.

[6] LI Y F,KONG C H,DAI L G,CHEN X.Single-stage detector with dual feature alignment for remote sensing object detection[J].IEEE Geoscience and Remote Sensing Letters,2022,19(1):1-5.

[7] DUAN K,BAI S,XIE L,et al.CenterNet:Keypoint triplets for object detection[C]//2019 International Conference on Computer Vision(ICCV),2019.

[8] LAW H,DENG J.CornerNet:Detecting objects as paired keypoints[J].International Journal of Computer Vision,2020,128(3):642-656.

[9] TIAN Z,SHEN C,CHEN H,et al.FCOS:Fully convolutional one-stage object detection[C]//2019 IEEE/CVF International Conference on Computer Vision (ICCV).IEEE,2020.

[10]YU D,JI S.A new spatial-oriented object detection framework for remote sensing images[J].IEEE Transactions on Geoscience and Remote Sensing,2022,60(12):1-16.

[11]ZHANG T,ZHUANG Y,WANG G Q,et al.Multiscale semantic fusion-guided fractal convolutional object detection network for optical remote sensing imagery[J].IEEE Transactions on Geoscience and Remote Sensing,2022,60(1):1-20.

[12]WU BX,SHIVANNA VM,HUNG HH,et al.ConcentrateNet:Multi-scale object detection model for advanced driving assistance system using real-time distant region locating technique[J].Sensors,2022,22(19):1-25.

[13]REZATOFIGHI H,TSOI N,GWAK J Y,et al.Generalized intersection over union:A metric and a loss for bounding box regression[C]//2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR).IEEE,2019.

[14]ZHENG Z,WANG P,LIU W,et al.Distance-IoU Loss:Faster and better learning for bounding box regression[C]//2019 Proceedings of the AAAI Conference on Artificial Intelligence,AAAI,2019.

[15]QIAN X,LIN S,CHENG G,et al.Object detection in remote sensing images based on improved bounding box regression and multi-level features fusion[J].Remote Sensing,2020,12(1):1-21.

[16]GOLPARDAZ M,HELFROUSH M S,DANYALI H.A new conditional random field based on mixture of generalized Gaussian model for synthetic aperture radar image segmentation[J].International Journal of Remote Sensing,2021,42(12):4743-4761.

[17]ZHANG J S,XING M D,SUN G C,et al.Oriented gaussian function-based box boundary-aware vectors for oriented ship detection in multiresolution SAR imagery[J].IEEE Transactions on Geoscience and Remote Sensing,2022,60(1):1-15.

[18]LI C,WANG L,KANG B,et al.Arbitrary-oriented ship detection based on feature filter and KL loss[C]//2020 International Conference on Wireless Communications and Signal Processing (WCSP).2020.