0 引言

晶振在电路系统中为电路提供基本的频率信号,如果晶振没有办法正常工作,对整个设备与系统会产生极大的影响。在晶振生产过程中,晶振总会产生表面损伤、电极错位、引线缺失、无面胶或面胶覆盖不均匀、水印等各种问题,多个种类的缺陷可能同时出现在同一个晶振上。目前,晶振检测主要有以下2种方法:

1)人工目检和功能测试。由于人眼容易疲倦,工人受外界影响干涉大,使得检测效率低,错误率高、生产所产生的人工成本高。人工方法可以将多个缺陷标注分类并反馈于生产端,针对不同缺陷问题产生的生产环节进行微调,使得生产的晶振质量保持较高的水准,实现精细化。

2)自动光学检测系统。其主要原理是把从光源反射回来的量与已经编好程的标准进行比较、分析和判断。其优点在于能够快速地实现缺陷的判断。但其缺点表现为其无法标注缺陷的具体种类,因此无法及时反馈于生产端,此外在高倍数的放大情况下,细微的不同也会导致反射量的变化,需要图片精度高,需要经常地调试设备,且调试周期长、无法长期保持高精度检测,有不方便部署的弊端。

现有的2种方法缺陷本质上在于多个缺陷的同时出现,导致无法兼顾晶振检测的速度、自动进行判断记录和对于生产端缺陷的及时反馈等3个要素。

早在十多年前,计算机视觉技术刚刚起步,文献[1-2]就提出了用机器视觉方法代替人工进行晶振检测。但由于计算机算力不足,以及相关机械设备发展尚早,始终无法进行高速清晰的识别并应用于实际生产环境。目前随着深度学习技术发展,已经有学者将目标检测技术用于缺陷检测。常用的目标检测算法分为2类:一类是以SSD[3]和YOLO[4]为代表的一段式目标检测算法,这种算法不需要region proposal,经过1次检测即可以生成锚框,得到最终检测结果,其速度较快,广泛应用于工业领域和视频实时检测;另一类是二段式检测算法,主要代表有Faster R-CNN[5],Mask R-CNN[6]算法,这种算法首先进行region proposals,然后对目标进行分类识别,常常在小目标检测中得到广泛应用,其精度较高,但速度较慢,所以常用于图片方面的处理识别等实时性要求不高的场景。目前已经有多名学者利用目标检测技术进行缺陷检测。

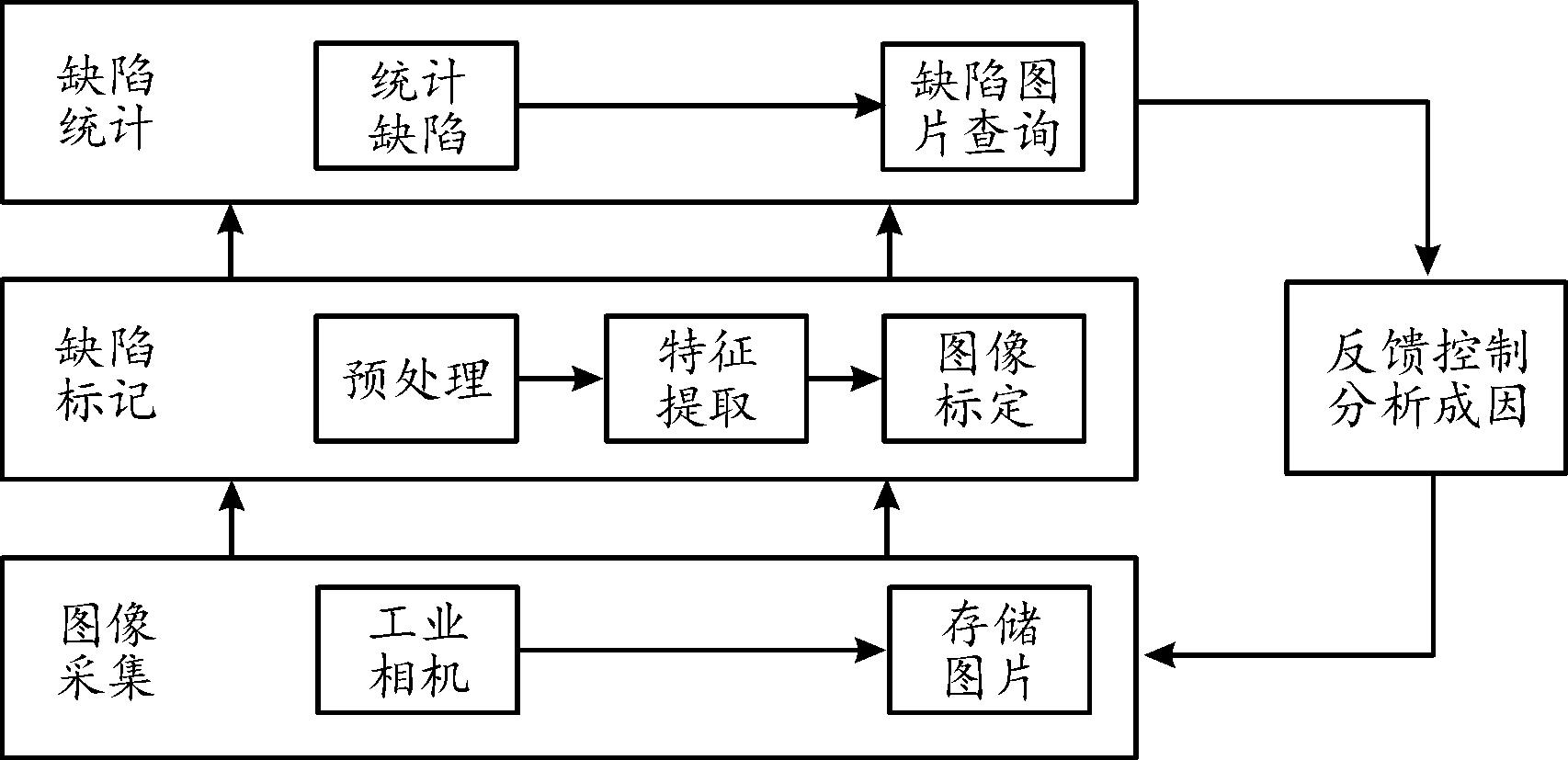

为解决晶振检测过程中人工处理受外界影响大、自动光学检测系统的部署需要高分辨率图像且需要经常调试的问题,本文做了以下工作。提出了基于Yolov5的改进算法,根据实际情况去除自适应填充功能;在Neck中增加新的检测尺度;借鉴加权双向金字塔的结构将Backbone中的特征信息引入Neck中进行特征图融合;改变其Neck部的激活函数,加快收敛速度;在检测部分引入注意力机制,增加通道间的联系;通过libtorch框架进行编译和推理,进行集成的部署和系统设计。系统框架图如图1所示。

图1 系统框架图

Fig.1 System framework

1 算法介绍及其改进

1.1 存在问题

1) 多缺陷指的是多个缺陷、多类缺陷可能同时出现于同一个晶振上。目标检测技术的核心任务是“定位”问题和“分类”问题。应用于缺陷检测方面的优点在于可以实现定位缺陷用锚框标出,实现不同锚框区域中不同缺陷的分类。这是传统方法所不具备的优点

在晶振检测问题下,遇到的问题是如何提升缺陷区域较小缺陷的定位能力和分类能力,即小目标检测能力。小目标的定义有2种:一是指所占绝对像素少;二是指相对来说在整幅图片中所占的大小相对较小。晶振检测任务中,吸嘴印和电极错位容易漏检的问题即是小目标检测能力不足的体现。

通常情况下,模型是通过卷积来提取原始图片像素中包含的特征的,感受野就反应了单个高层特征的信息与原始像素之间的对应关系,在网络卷积核确定的情况下,随着网络层数的增加,单个高层特征反应原始图片像素的范围就越大,视野就越宽,高层信息就越能够反应原始图片中物体的宏观轮廓。然后,随着网络层数的增加和感受野的变大,微观的信息就会丢失,这样对于小目标的信息就会聚合到一个点,小目标原本包含的像素就少,随着感受野的增加,聚合后的特征就更少了,比如10*10像素的小目标,经过卷积后的特征可能就只有1*1,甚至出现多个10*10像素的小目标,经过多次卷积核,合并成了一个特征。这样,小目标就无法识别。因此,深层的多次卷积,对于小目标的微观特征实际上是不利的。

2) 当前深度学习不断发展,虽然深度学习技术在工业界不断应用,但相比于学术界的发展,如何部署于工业界仍是需要解决的问题,在图像学中,GPU的计算速度更快,更适合于进行深度学习。但是在工业界中,缺少GPU的加持,且在工业界中GPU型号并不靠前,所以需要考虑模型的轻量化。

综合以上考虑,本文采用Yolov5进行算法的改进。

1.2 Yolov5算法介绍

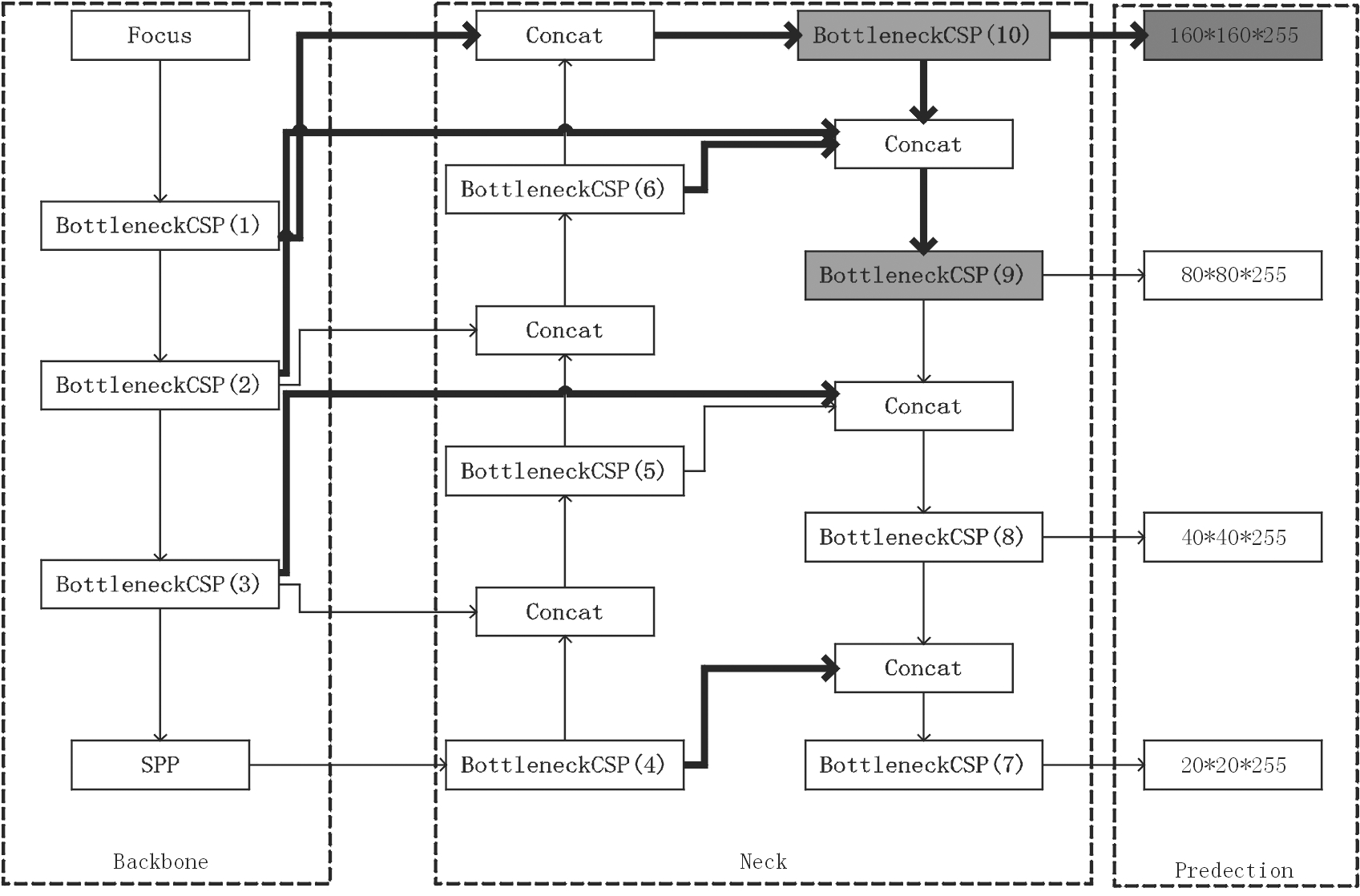

整个网络结构由输入端、主干网络、Neck网络、Head输出层所组成。Yolov5s结构框图[7]如图2所示。

图2 Yolov5s结构框图

Fig.2 Block diagram of the Yolov5s structure

输入端Yolov5s采用了Mosaic方法进行数据增强,增强鲁棒性。采用自适应填充的办法,减少了信息冗余,进一步提高运行速度。

主干网络Backbone通常由特征提取网络构成,其中典型网络包括ResNet[8]、DenseNet[9]、EfficientNet[10],其主要的作用是提取特征。主干网络引入了注意力机制[11],注意力机制的引入使神经网络能更好地提取特征[12],提高系统的精度。CSP结构引入了与DenseNet相似的的跳层连接思想[13]。CSP结构解决了其他大型卷积神经网络框架Backbone中网络优化的梯度信息重复问题,既保证了推理速度和准确率,又减小了模型尺寸。

Yolov5 的 Neck 部分采用了PANet结构[14],Neck 主要用于生成特征金字塔。特征金字塔会增强模型对于不同缩放尺度对象的检测,从而能够识别不同大小和尺度的同一个物体。PANet结构是在FPN的基础上引入了 Bottom-up path augmentation 结构。PANet在 FPN 的基础上加了一个自底向上方向的增强,使得顶层 feature map 也可以享受到底层带来的丰富的位置信息,从而提升了大物体的检测效果。

Head 进行最终检测部分,输出的特征图上会应用锚定框,并生成带有类别概率、置信度得分和包围框的最终输出向量。

1.3 对于Yolov5s算法的改进

1.3.1 Input模块的优化

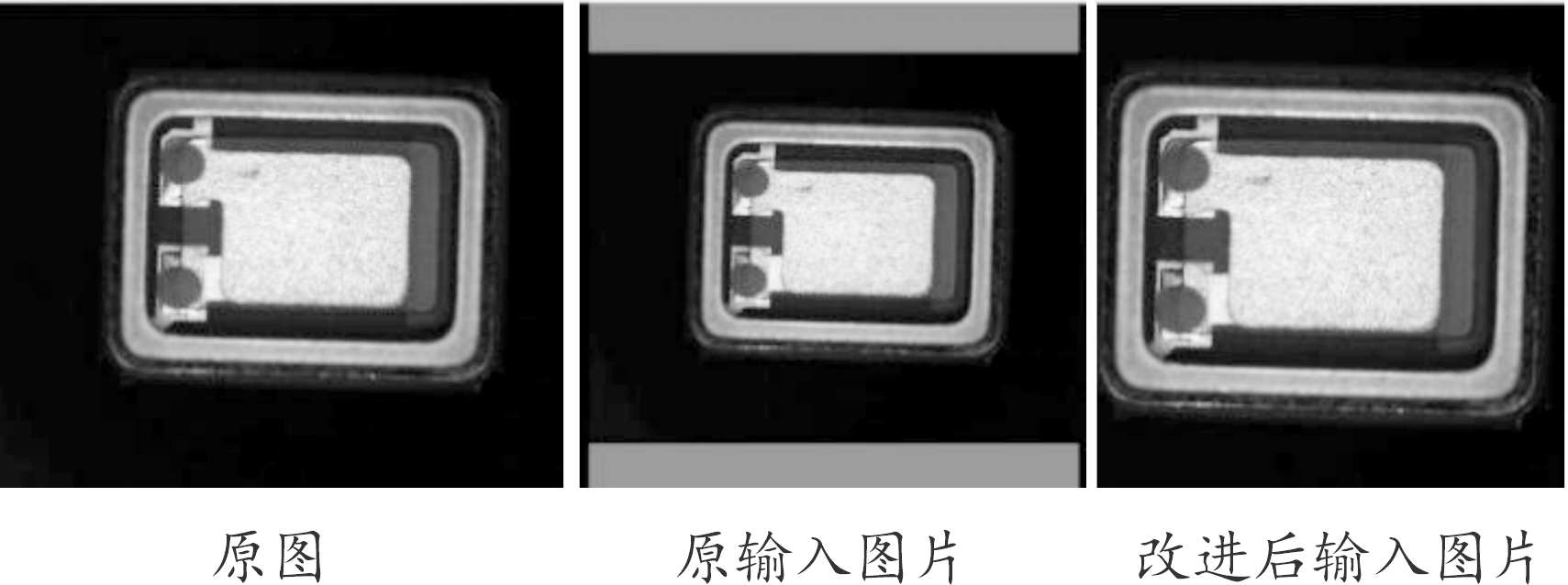

加入裁剪模块并启用多尺度大小训练。在Yolov5s算法中,输入图片会自适应大小为640*640的大小,受限于相机的配置参数,无法拍摄为正方形图片,图片原大小为2 480*2 056,在自适应缩放图片大小的过程中,会在2 056的边长处增加黑色长度,然后缩放至640*640,这样的处理无意间增加了多余的冗余信息,对于训练并不友好,在dataset模块中,根据所拍摄图片的大小,加入裁剪模块,将整幅图像裁剪为2 056*2 056的比例。训练图片输入大小对比如图3所示。

图3 训练图片输入大小对比

Fig.3 Training image input size comparison

这一改进同时增加了一个图中多个缺陷区域的相对面积,改善目标较小难以定位的难题。在一定程度上这一改进增强了算法的定位能力。

1.3.2 Backbone和Neck的改进

由上文描述的问题可知,要进一步提高目标检测的精度,既要确保网络层次够深,又要避免过度降维以至于损失特征的问题,在以下的改进中,主要思想是增加新的检测尺度和特征图融合的方法来增加特征并进一步增加网络深度。

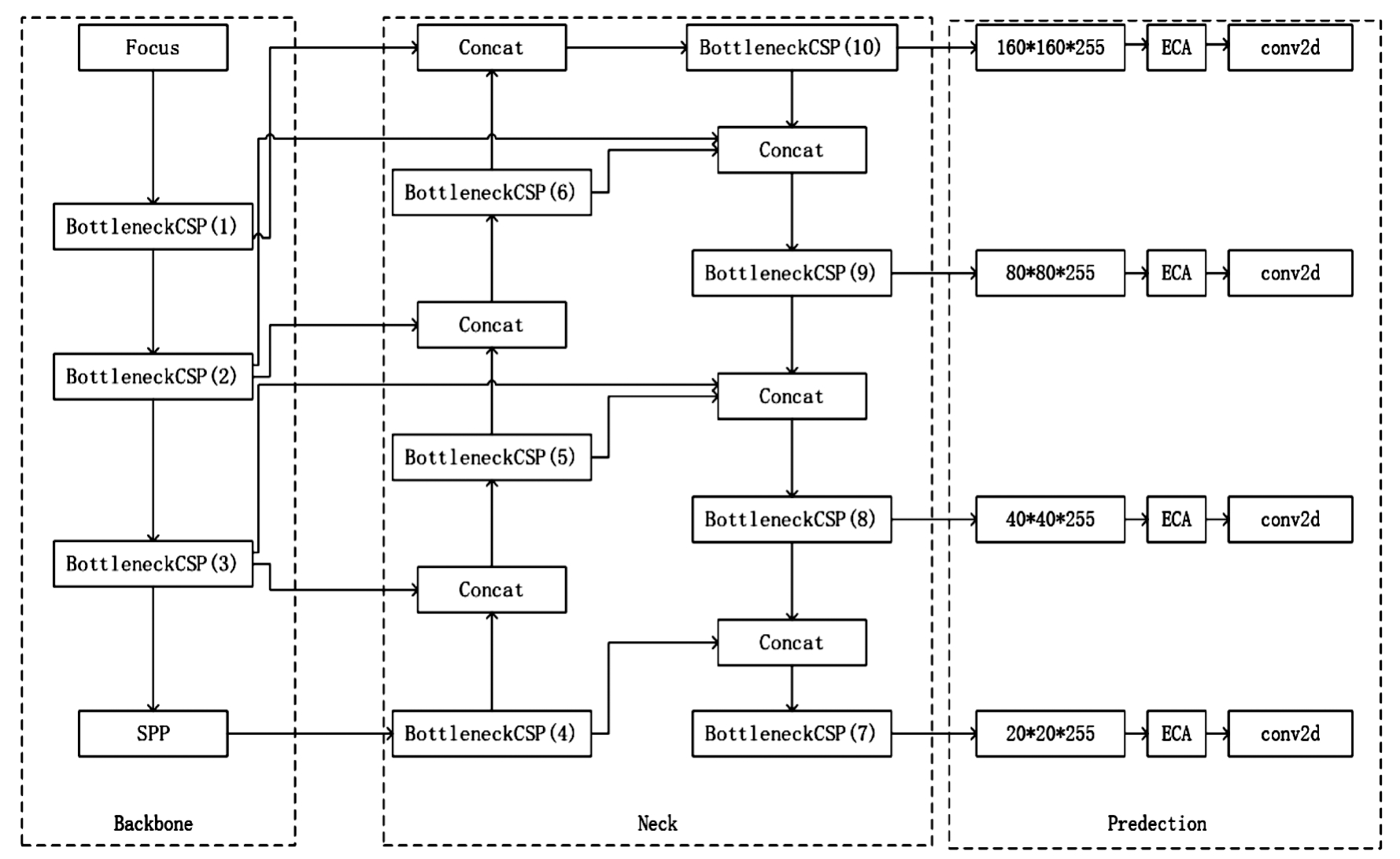

在晶振检测的环境背景下,很多目标本身就很小,原始的Yolov5在检测过程中可能会被覆盖或是忽略,为了解决小目标检测的问题,在主干网络和颈部网络的部分增加新的尺度检测层连接。通过新的卷积采样的增加,使得新的尺度检测的增加,更加适用于密集出现的缺陷。新的检测层参数经过卷积和通道数的变化,新的检测层为160*160*255。新添加的检测层在Neck中生成新的特征金字塔结构,原本的特征金字塔层数较少,新的检测层的特征金字塔层数将更多,将更小的目标信息映射。

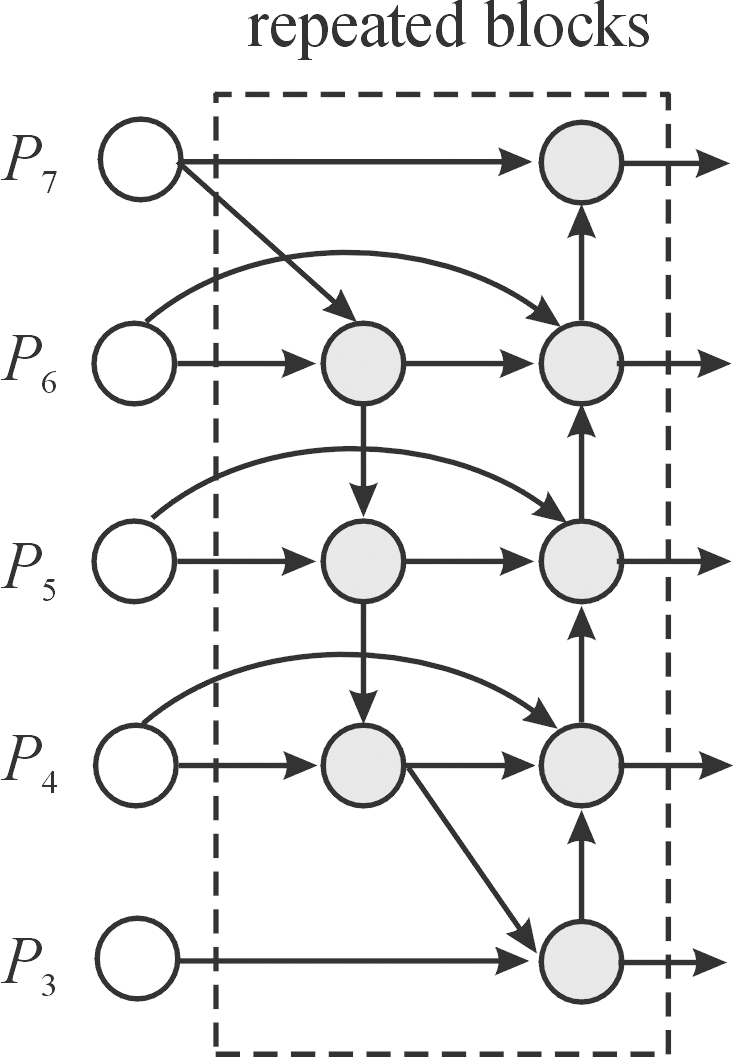

以上进行的增加尺度检测模块改进主要是为了加强网络的特征融合能力,但是同时存在问题是所有的特征信息都将是处理后得到的,原始信息很少参与到特征金字塔的生成。为了进一步减少偏差,增强特征图的融合信息能力,使得主干网络中的原始特征信息参与到学习训练学习中,在此借鉴了加权双向特征金字塔(BiFPN)[15]中的结构,进行特征融合。增强不同尺寸的特征图,不同信息量的特征图的融合。BiFPN的结构图如图4所示,在此结构中,原本是将不同的特征图按照不同的权值进行交融,在此次的改进中,主要借鉴其结构思想进行改进。改进后的yolov5结构图如图5所示。

图4 BiFPN结构图

Fig.4 BiFPN structure

图5 Backbone与Neck部分的联合改进

Fig.5 Joint improvement of Backbone and Neck sections

图5中颜色最深的模块是新添加的小目标检测层,较粗的连接线是为了添加此模块所进行的连接,此结构增加了一层不同尺度的检测,旨在增加小目标检测能力。虽然增加了小目标的检测层,但是本身结构仍然是PANet的普通结构,在经过处理后,会造成原始特征的丢失。

这一部分改进特意增加了更适合检测小目标的小尺度检测层,以改善在网络深度过深时小目标所携带的信息被稀释。此后,在生成的新的特征金字塔结构中进行结构改进,旨在将原始特征更多地引入,避免原始特征信息经过多次处理后的丢失。相较于未改进,经过改进使得模型中的特征信息更多,增加定位能力,为检测分类提供帮助。

1.3.3 Neck部分的改进

在许多实验中使用Hard-swish激活函数都提高了模型的收敛速度,使得神经网络的性能得到很大的提高。H-Swish函数公式为:

Swish(x)=x·sigmoid(βx)

(1)

由上述公式可知,本函数具有非单调和有下界无上界的特点,且计算量小,有助于加快收敛,增加模型的准确程度。同时这一改进有利于解决在深度学习中常见的区域最优解问题,帮助模型更快跳出区域最优解。

1.3.4 Predesition部分改进

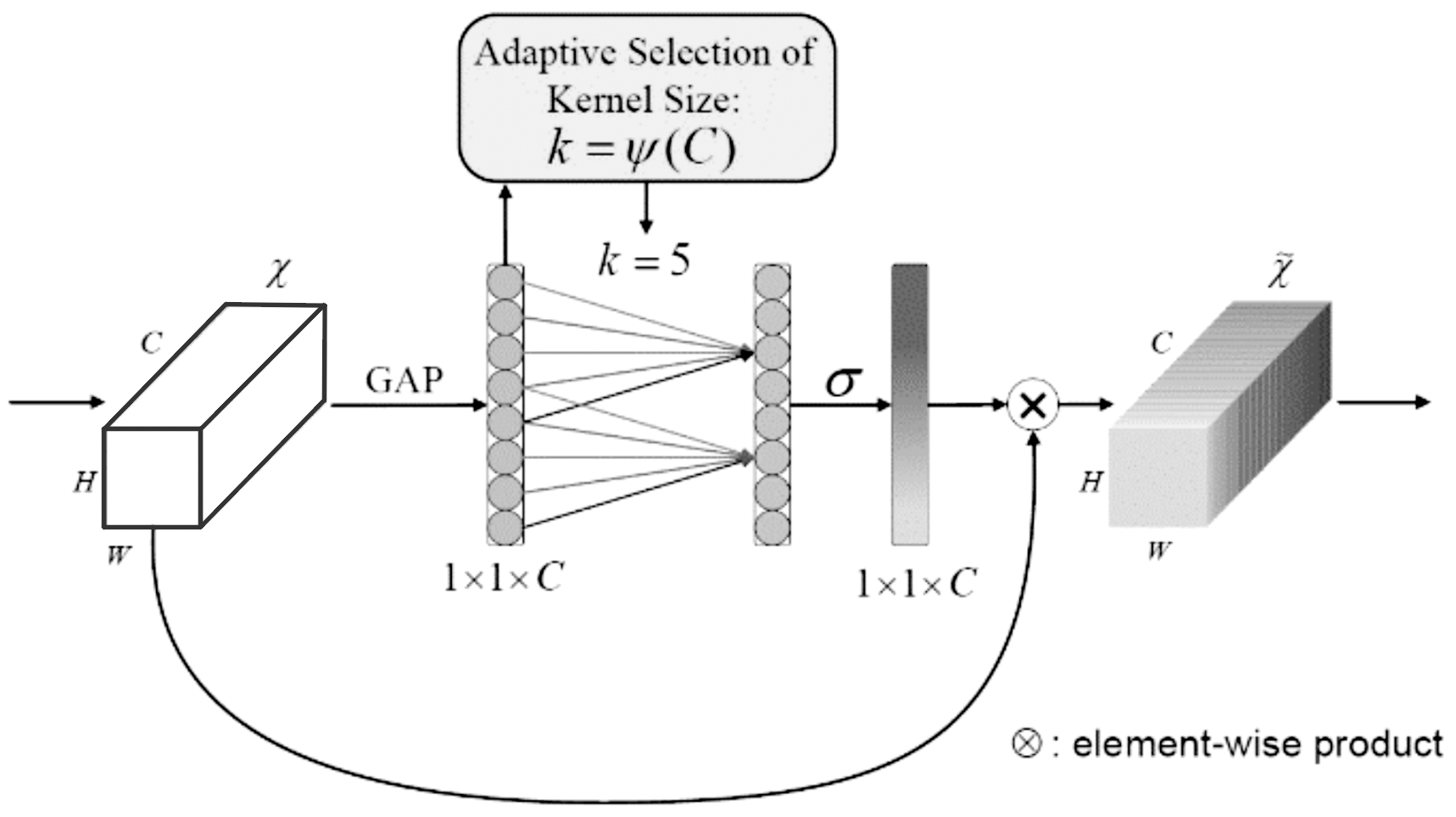

引入了ECA[16]注意力机制。注意力机制的有效性已经被广泛证明,ECA注意力机制在SE注意力机制的基础上提出,其主要特点是在不降维前提下增加通道之间的联系,并且不用对网络的模型参数做出修改,可以随时方便引用。其计算结构如图6所示。其中的GAP代表进行全局池化操作,进行卷积核大小为k的一维卷积操作,并经过Sigmod函数得到不同的通道权重大小。

图6 ECA注意力机制结构图

Fig.6 Structure of the ECA attention mechanism

在1.3.3节的改进中,在网络结构方面已经进行了多次特征图的融合,特征图的信息量相较于原网络更多,为了让通道之间相互关联,进一步提高检测精度,在输出部分引入注意力机制,使得特征图的注意力信息能被更好地利用。完整的改进后结构图如图7所示。

图7 改进模型图

Fig.7 Diagram of the improved model

引入ECA注意力机制后,各个通道间相互关联,在特征信息增多的前提条件下,更有效地利用原有信息,且并没有过多的增加计算量,使得检测的分类能力提升,能更加准确地识别出缺陷的种类。增强了检测多缺陷时的分类能力。

2 实验场景的搭建

2.1 相机设置和搭建

本次实验相机型号为TS5MCL-156M,生产厂家为合肥埃科光电科技股份有限公司,在相机的配置过程中,要在个人计算机安装图像采集卡,为最大限度贴合实际生产环境,安装图像采集卡的个人计算机不再另外配有显卡,采用英特尔i9cpu进行推理运算。相机及图像采集卡如图8所示。

图8 实验场景搭建

Fig.8 Experimental scene construction

进行训练的个人计算机配置:网络语言基于python3.7的Pytorch框架实现,软件平台为Pycharm,主机基于linux系统配置,共16G内存,cpu配置为i9,显卡为NVIDIA GEFORCE GTX1080Ti,显存为11G,CUDA版本为10.2。

2.2 数据集的制作

本次采用图像均用工业相机进行采集照片共2 142张,其中700张为工厂环境进行采集的,其余在实验室自行采集,以2种图片混合进行数据集制作。

工业环境中对于结果影响最大的是光照因素,目标检测技术更像是模仿人眼在一定程度上进行定位和分类2个任务。虽然室内是一个相对封闭且光源相对稳定的空间,但是流水线不同的检测位置仍然会影响晶振的成像,根据实验,在放大倍数很大但不使用补光灯的情况下,往往需要不断地调节镜头以及设备的位置来保证成像的合格。这也是自动光学检测设备对晶振无法保持高精度的检测,并且必须经常重新调试设备的原因。为了保持设备在一定范围内的稳定性,所以采用圈型的补光灯将光照强度控制在一定程度内。

数据集标注,标注格式有yolo、VOC等格式,为了方便使用,此处标注格式为VOC格式,标注完成后,通过data文件夹下的txt_make.py和label_make.py转为指定的格式要求。缺陷分类共5类,分别为吸嘴印、电极错位、引线缺失、水印、无面胶或面胶不均。晶振出现的缺陷种类如图9所示。

图9 晶振典型缺陷检出

Fig.9 Typical defect detection of crystal oscillator

各种典型缺陷的特征描述如下:

1) 吸嘴印:表现为在电极上(上图中面积最大的灰白色或灰黑色部分)与周遭颜色不同的小黑块或者黑点,大小为0.2~0.8 mm的不规则区域。

2) 引线缺失:表现为面胶(图中的圆形黑色部分)与晶片(图9左下的圆形面胶与电极之间的亮银色部分)中间呈现出未分层的现象。

3) 电极错位:表现为电极与晶片的不对齐,大小不定。

4) 面胶问题:面胶未呈现相互对称或接近于完整圆的状态。

5) 水印:在黑色的的晶振电极上呈现出白色的小圆。其大小通常为0.2~0.4 mm的圆。

多缺陷可能同时出现在同一晶振,同一缺陷也可能反复出现在同一个晶振的不同区域。数据集划分比例采用1:9划分训练集与验证集,除2142张缺陷标记图片外,其中插入70张无缺陷晶振图片于训练集,以提高模型的鲁棒性和泛化性。

本文中主要采用mosaic数据增强技术, mosaic主要采用多张图片随机裁剪、缩放、翻转后,再随机排列拼接形成1张图片,实现丰富数据集的同时,增加了小样本目标,提升网络的训练速度。训练完成后,重新采集100张图片进行验证,根据评估参数评估试验结果。

2.3 评估参数

主要用以下4个指标对实验进行评估。

1) 精确率P(Precession),其计算公式为:

式中:TP表示把正类预测为正类;FP表示表示把负类预测为正类。参数表示正确预测占全部预测为正的的比例。

2) 召回率R(Recall),其表示预测为正占全部样本的比例,FN表示把正类预测为负类。其计算公式为:

3) mAP@0.5:0.95:AP表示的是单类别的平均准确度,mAP表示对所有类别求均值,mAP@0.5:0.95表示在不同阈值下平均的mAP值。

4) Speed(cpu),其是预测在cpu上的表现速度。为考虑部署过程中的实际应用,图像的采集和其相关数据的存储一定会耗费时间,在没有GPU加速的前提下,在cpu上的表现速度十分关键。

3 实验结果及模型部署

3.1 实验结果

3.1.1 实验超参数设计

将data文件夹下的mydata.yaml文件的类别数改为5,分类具体类别为:“NG1、NG2、NG3、NG4、NG5,分别对应不同的缺陷种类。此次共5种缺陷,所以修改yolo5s.yaml文件类别数为5,训练轮次为300,batchsize为8。SGD[17]优化算法没有使用动量,容易陷入局部极值。使用Adam优化算法[18],利用梯度的1阶矩估计和2阶矩估计动态调节每个参数的学习率。此外打开多尺度训练,超参数进化的选项。

3.1.2 改进模型前后对比

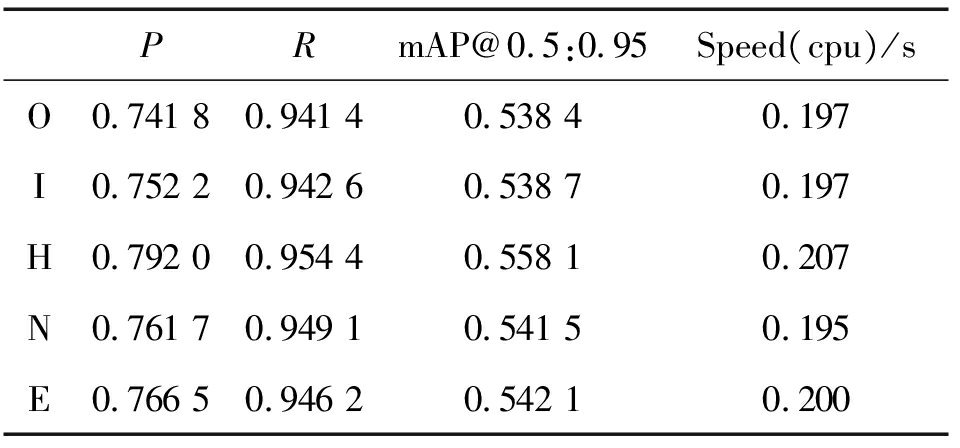

实验中对ECA注意力机制的引入进行了多次实验,分别在预测部分、主干网络部分和颈部网络中进行引入,但只有在预测部分,其有正优化的效果,因此表1中列出的仅仅是在预测部分引入的效果。

表1 不同改动所产生的效果

Table 1 Effect of different changes

PRmAP@0.5:0.95Speed(cpu)/sO0.741 80.941 40.538 40.197I0.752 20.942 60.538 70.197H0.792 00.954 40.558 10.207N0.761 70.949 10.541 50.195E0.766 50.946 20.542 10.200

改进模型部分分别以以下字母代表改进部分。O代表未进行任何改进进行训练的模型网络,I代表改进Input模块,H代表主干网络和颈部网络的联合改进,N代表改动Neck部分的激活函数,E代表引入注意力机制。例如I代表改进Input模块的模型。表1为分别改进后的模型训练结果。

从表1可以得出,优化的每一部分都为正向优化,在损失可接受范围内的计算速度的同时,在颈部网络和主干网络进行特征图的融合带来了巨大的提升效果。在Input网络方面虽然成效不大,但是也仍然带来了一定的提升。此对比实验成功证明了改进网络所进行优化是可行的。尤其是在进行特征图的融合后,在计算量增大有限的前提下,使得检测的精度大幅度地提升。

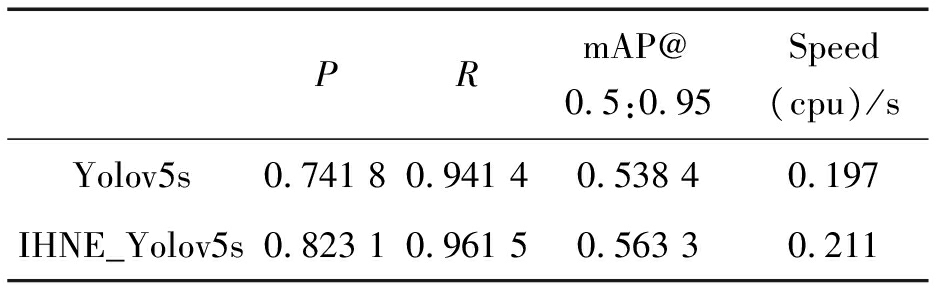

最终将4种改进同时进行,改进后的模型命名为IHNE_Yolov5s,改进前后的实验结果如表2所示。

表2 改进前后评估对比

Table 2 Comparison of assessments before and after improvements

PRmAP@0.5:0.95Speed(cpu)/sYolov5s0.741 80.941 40.538 40.197IHNE_Yolov5s0.823 10.961 50.563 30.211

在实验中,改进后的网络在一定程度上牺牲了运算时间,这是为了提升精度不可避免地一部分,但其在cpu上地运算速度表现仍然控制在0.3 s以内,其准确率提升了约7%,召回率提升了2%左右,证明了本文改进的有效性。

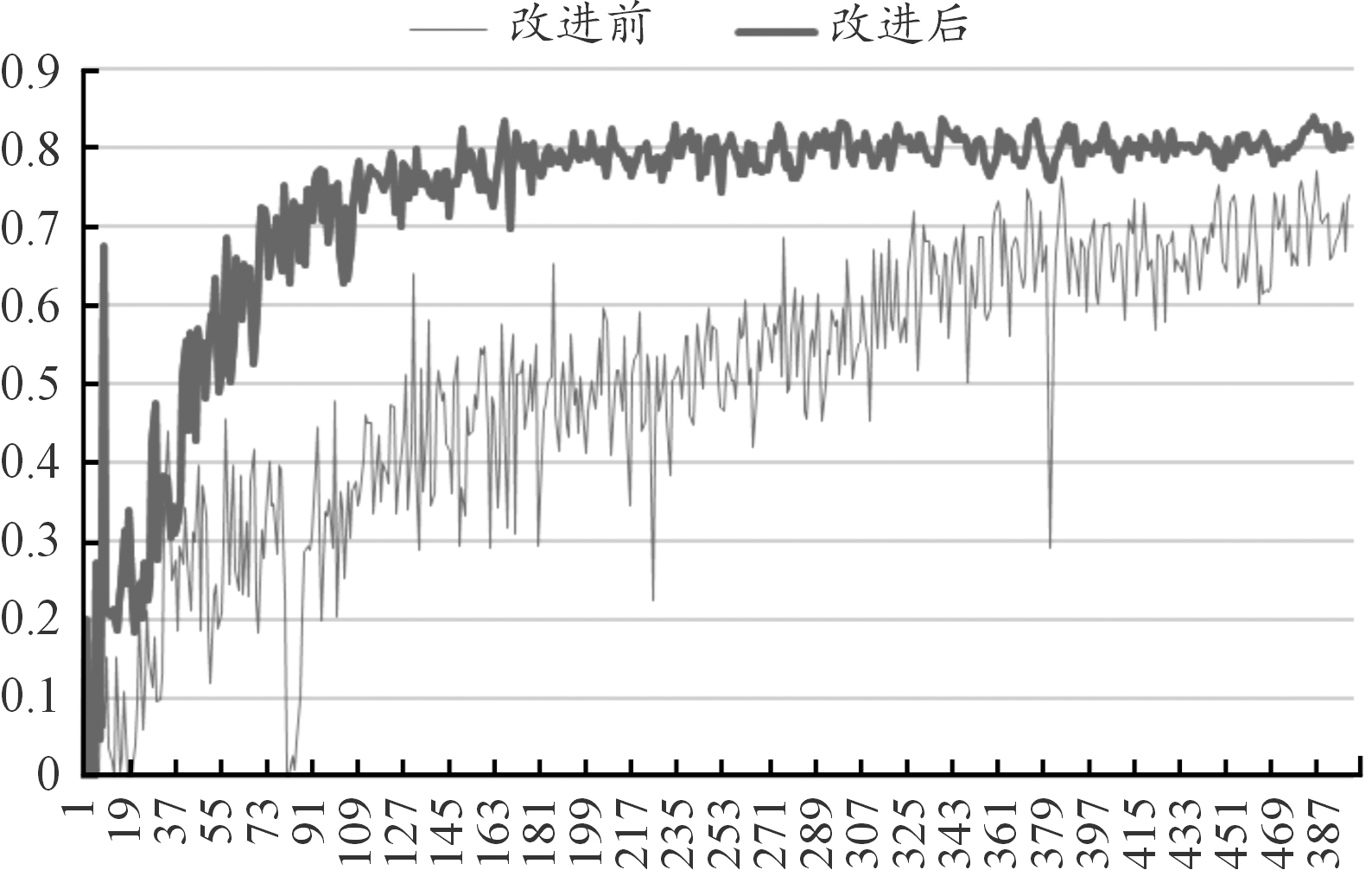

此外,在训练过程中发现,召回率的收敛速度相似,但是总体上改进后的网络收敛速度更快,图10为训练过程中Yolov5s改进前后的Pression曲线变化,通过观察曲线趋势,发现改进后的网络收敛速度更快,证明了虽然有计算量的加大,在进一步数据集扩充情况下,我们可以适当减少训练轮次,将其更快更准确地应用于缺陷的检测。

图10 改进前后的精度对比

Fig.10 Comparison of accuracy before and after improvement

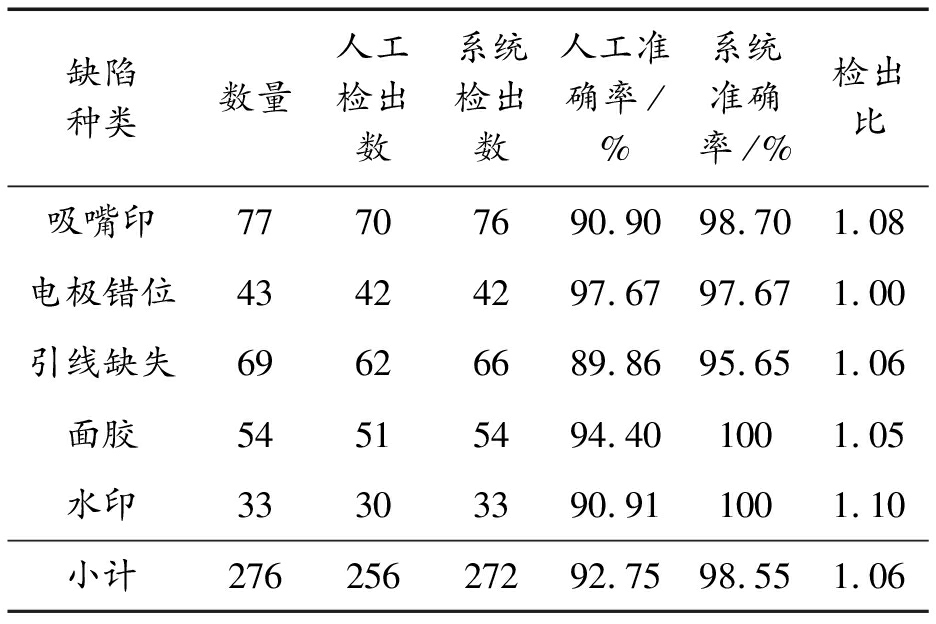

3.1.3 人工检测结果对比

本次人工检测过程共采集100张图片,其中50张由工厂工人采集,50张在实验室进行采集。采集到的图片缺陷由双方共同认定缺陷数量和种类。其中,工人检测由另外一批不参加图像采集的工人进行识别,确保实验结果不受干扰。实验结果如表3所示。

表3 人工检测结果

Table 3 Manual testing results

缺陷种类数量人工检出数系统检出数人工准确率/%系统准确率/%检出比吸嘴印77707690.9098.701.08电极错位43424297.6797.671.00引线缺失69626689.8695.651.06面胶54515494.401001.05水印33303390.911001.10小计27625627292.7598.551.06

从表3可以看出,利用改进后的模型进行检测缺陷是可行的,在工人未长时间工作的前提下,总体人工检出的准确率仍然低于系统检出的准确率,其中3项缺陷,系统检出比人工更高,系统检出率全部高于95%。根据检出比来看,无论哪一类缺陷,系统都能够准确识别,除电极错位以外,系统检测比人工更加准确可靠。系统能准确地识别错误,根据图10所示,当多缺陷出现在同一晶振上时,也可以准确判断识别。表明本文给出的方法能成功地做到精确识别,精准分类。

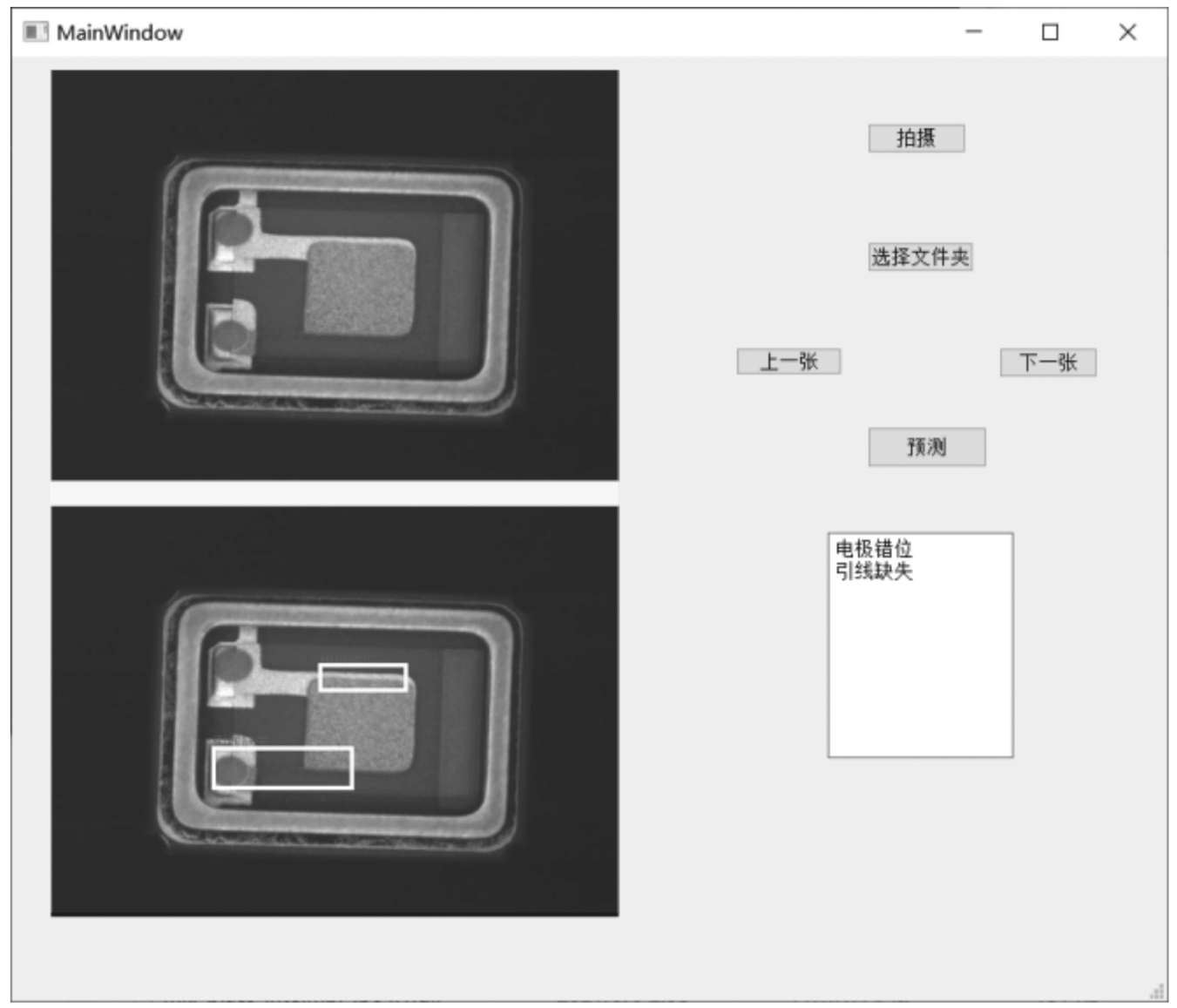

3.2 模型部署

模型部署过程中首先进行模型剪枝工作,原Yolov5模型已经很小,但其仍然包括了反馈部分进行loss的计算,在剪枝过程中,仅保留其前向计算部分和训练参数部分,进行libtorch的推理工作。主要步骤如下:① 进行opencv安装;② 对项目进行libtorch环境的配置;③ 生成onnx中间文件;④ 编译文件,进行推理加速。

本文界面采用QT进行界面的编写,并最终集成,这样做的好处是每一个函数部分相对独立,后期仍然可以基于此界面添加其他功能。在编写过程中,引入中文,实现缺陷中文名称的显示,使得方便统计。主要包含了图像读取以及预测2个功能模块,图像读取包含2种方式:一种是通过程序接口与工业相机进行连接,直接从工业相机中读取晶振图像;另一种是通过读取计算机本地存储的图像,通过“选择文件夹”来打开图片,并通过“上一张”和“下一张”按钮来选择文件夹里的图像。

预测模块将图像输入进网络并进行预测以及生成预测框,并将对应缺陷位置显示出来,将预测结果显示在文本框内,这样就可以清晰地显示出晶振具体出现的缺陷,预测结果效果图如图11所示。

图11 检测效果图

Fig.11 Detection effect

同时在预测过程中,后台会自动统计缺陷的种类及累计的个数生成csv文件,csv文件中主要包括图片缺陷检测种类的总数统计以及缺陷图片的位置路径。方便将其反馈于生产端,使得其生产工艺进一步提高,减少不良品的百分比。

4 结论

1) 以电子工业相机拍摄晶振照片进行数据采集,在拍摄过程中适度调整光照强度,在训练过程中进行反转裁剪等数据增强。

2) 为解决晶振检测中细小的表面损伤和电极错位难以检出的情况,对模型进行强化改进,保留其轻量化的同时,增强了定位和分类能力,实现了检出率高于95%,单张速度小于0.3 s,实现检测精细化和高速化。

3) 根据工厂需求设计可视化界,进行模型剪枝加速,并将模型、相机控制程序和检错统计的程序集成,实现晶振检测的精细化管理。

鸣谢:在此特别感谢应达利电子股份有限公司的合作,为本次实验提供数据集支持。

[1] 谢佩军,计时鸣,程越.基于计算机视觉的晶振帽缺陷自动检测系统[J].仪器仪表学报,2008(5):1079-1083.

XIE Peijun,JI Shiming,CHENG Yue.Automatic detection system for crystal cap defects based on computer vision[J].Journal of Instrumentation,2008(5):1079-1083.

[2] 庞章炯,张鹰,谢佩军,等.机器视觉在晶振外壳缺陷检测中的应用[J].制造技术与机床,2007(3):87-91.

PANG Zhangjiong,ZHANG Ying,XIE Peijun,et al.Application of machine vision in the detection of defects in crystal shells[J].Manufacturing Technology and Machine Tools,2007(3):87-91.

[3] LIU W,ANGUELOV D,ERHAN D,et al.SSD:Single shot multibox detector[C]//Proceedings of European Conference on Computer Vision.Heidelberg:Springer,2016:21-37.

[4] REDMON J,DIVVALA S,GIRSHICK R,et al.You only look once:unified,real-time object detection[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition.Los Alamitos:IEEE Computer Society Press,2016:779-788.

[5] REN S Q,HE K M,GIRSHICK R,et al.Faster R-CNN:Towards real-time object detection with region proposal networks[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2017,39(6):1137-1149.

[6] KAIMING H,GEORGIA G,PIOTR D,et al.Mask R-CNN[C]//2017 IEEE International Conference on Computer Vision (ICCV),2017:2980-2988.

[7] 李永上,马荣贵,张美月.改进YOLOv5s+DeepSORT的监控视频车流量统计[J].计算机工程与应用,2022,58(5):271-279.

LI Yongshang,MA Ronggui,ZHANG Meiyue.Improving YOLOv5s+DeepSORT for monitoring video traffic statistics[J].Computer Engineering and Applications,2022,58(5):271-279.

[8] HE K,ZHANG X,REN S,et al.Deep residual learning for image recognition[C]//Proc.of the IEEE Conf.on Computer Vision and Pattern Recognition,2016:770-778.

[9] HUANG G,LIU Z,VAN DER MAATEN L,et al.Densely connected convolutional networks[C]//Proceedings of the IEEE conference on computer vision and pattern recognition.2017:4700-4708.

[10] TAN M,LE Q.Efficientnet:Rethinking model scaling for convolutional neural networks[C]//Proc.of the International Conference on Machine Learning.PMLR,2019:6105-6114.

[11] VASWANI A,SHAZEER N,PARMAR N,et al.Attention is all you need[C]//Proceedings of the 31st Conference on Neural Information Processing Systems,2017.

[12] WOO S,PARK J,LEE J Y,et al.CBAM:convolutional block attention module[M].Computer vision-ECCV 2018.Cham:Springer International Publishing,2018:3.

[13] HUANG G,LIU Z,LAURENS V D M,et al.Densely connected convolutional networks[C]//Proc.of the Conference on Computer Vision and Pattern Recognition,2017.

[14] TRINH H C,LE D H,KWON Y K.PANET:A GPU-based tool for fast parallel analysis of robustness dynamics and feed-forward/feedback loop structures in large-scale biological networks[J].PLo S ONE,2014,9(7):e103010.

[15] TAN M,PANG R,LE Q V.EfficientDet:Scalable and efficient object detection[C]//Proceedings of the IEEE/CVF conference on computer vision and pattern recognition.2020:10781-10790.

[16] WANG Q,WU B,ZHU P,et al.ECA-Net:Efficient channel attention for deep convolutional neural networks[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition,2020:11534-11542.

[17] RABZNO S L,CABATUAN M K,SYBINGCO E,et al.Common garbage classification using mobile net[C]//Proc.of the Baguio Philippines:International Conference on Humanoid,Nanotechnology,InformationTechnology,Communication and Control,Environment and Management,2018.

[18] KINGMA D P,BA J.Adam:A method for stochastic optimization[C]//Proc.of the International Conference on Learning Representations,2015:1-13.