0 引言

现有的雷达目标属性识别技术主要是利用雷达回波中的频谱信息、极化特征信息、高分辨距离像等实现对目标属性的识别,很少有利用雷达检测到目标的速度、加速度和方位等数据进行目标属性识别。文献[1]针对雷达点迹数据,采用递归神经网络(recursive neural network,RNN)进行目标航迹特征识别。文献[2]针对雷达点迹数据,采用卷积神经网络(convolutional neural network,CNN)进行目标航迹特征识别。在上述文献中,基于深度学习的方法均取得了优异的属性识别结果,但以上文献都是对航迹曲线特征进行属性识别,并未对航迹所对应的目标进行属性识别。传统的军事武器系统中通常通过获得的雷达航迹数据对目标属性进行识别,但是单一雷达传感器目标属性识别性能往往会受到环境噪声的干扰和自身传感器因素的影响。文献[3]鉴于传统车辆避撞系统中,因采用单一传感器进行目标识别,在感知范围、识别准确性等方面存在的固有缺陷问题,提出了一种基于雷达与机器视觉信息融合的目标识别方法,实现了目标的准确识别与定位。文献[4]针对复杂战场环境下目标信息不确定性造成目标识别困难和误判,导致目标识别结果准确率低的问题,提出了一种基于离散因子多传感器目标识别的数据融合方法,使目标识别结果更加准确,符合实际。以上文献表明,通过多传感器信息融合技术,能够解决单一传感器识别能力低的问题,提高目标识别结果的准确性。

随着技术的不断发展,目前的雷达大多都配备着各种类型的光电传感器辅助雷达进行目标识别,这些光电传感器包括白昼型或者微光型电视跟踪及监视设备、前视红外跟踪及监视设备、激光测距机等。利用这些设备能够观察目标的特征及跟踪情况。因此可以在传统武器系统中使用光电图像和雷达航迹进行目标属性识别。

故本文中设计了一种使用D-S证据理论并基于决策级信息融合将雷达航迹信息与光电图像进行融合识别的方法。该方法在融合处理雷达航迹信息、光电图像信息的基础上,利用融合后的目标信息完成对目标的正确识别。通过实验分析,论证了该方法能够提高雷达的目标属性识别能力。

1 研究方法

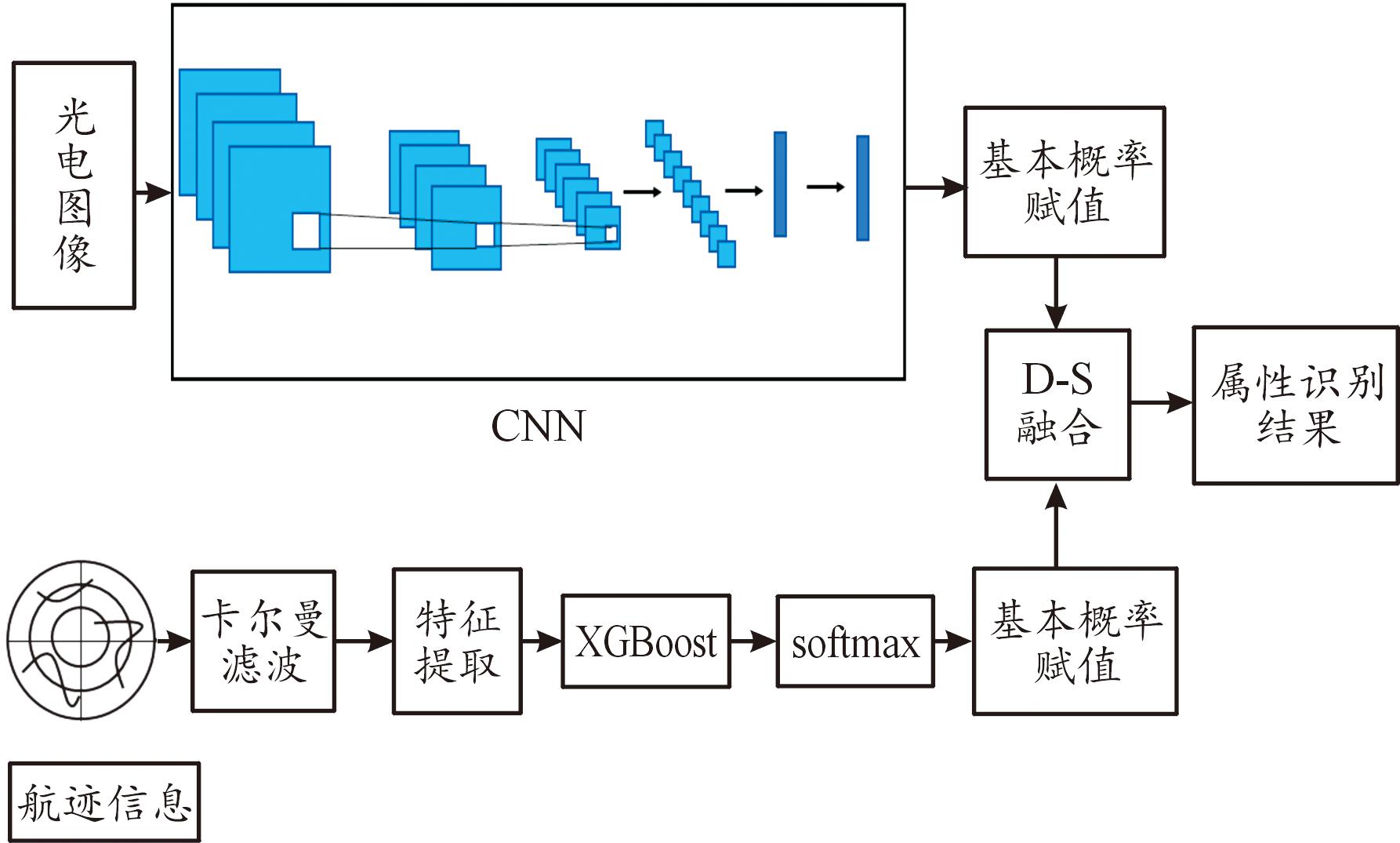

图1为本文中使用的目标属性识别框架,通过对航迹信息进行卡尔曼滤波后提取运动特征并使用XGBoost模型进行分类最后通过Softmax函数输出基本概率赋值。光电图像采用34层的在ImageNet数据集上预训练好的ResNet网络进行分类,最后使用D-S证据理论对2个模型的识别结果进行融合。

图1 信息融合目标属性识别框架图

Fig.1 Information fusion target attribute recognition framework diagram

1.1 XGBoost网络

XGBoos是陈天奇等[5]提出的一种基于梯度提升树的集成学习算法,具备更加快速准确解决许多数据科学问题的优点,其思想就是不断地生成新的树,每棵树都是基于上一颗树和目标值的差值来进行学习,从而降低模型的偏差,最后将所有树的结果加起来就是模型对一个样本的预测值。而如何选择生成一颗较优的树,则是通过目标函数来定义。

XGBoost的目标函数Obj如式(1)所示:

![]()

(1)

式(1)中:L为误差项;![]() 为复杂度函数项。

为复杂度函数项。

误差项L就是所有数据训练后得到的预测值和对应的真实值之间的误差相加,而每一次迭代得到的预测结果都是对上一次迭代残差的修正。假设模型在第s步得到的预测值为![]() 则每次的预测值可表示为

则每次的预测值可表示为

![]()

(2)

![]()

(3)

……

![]()

(4)

如果叶子的节点数太多,模型过拟合的风险就会增加,所以加入复杂度函数Ω(fs)来限制叶子节点个数,即

![]()

(5)

式(5)中:γ、λ为超参数,用来控制叶子节点数和权重。

1.2 ResNet网络

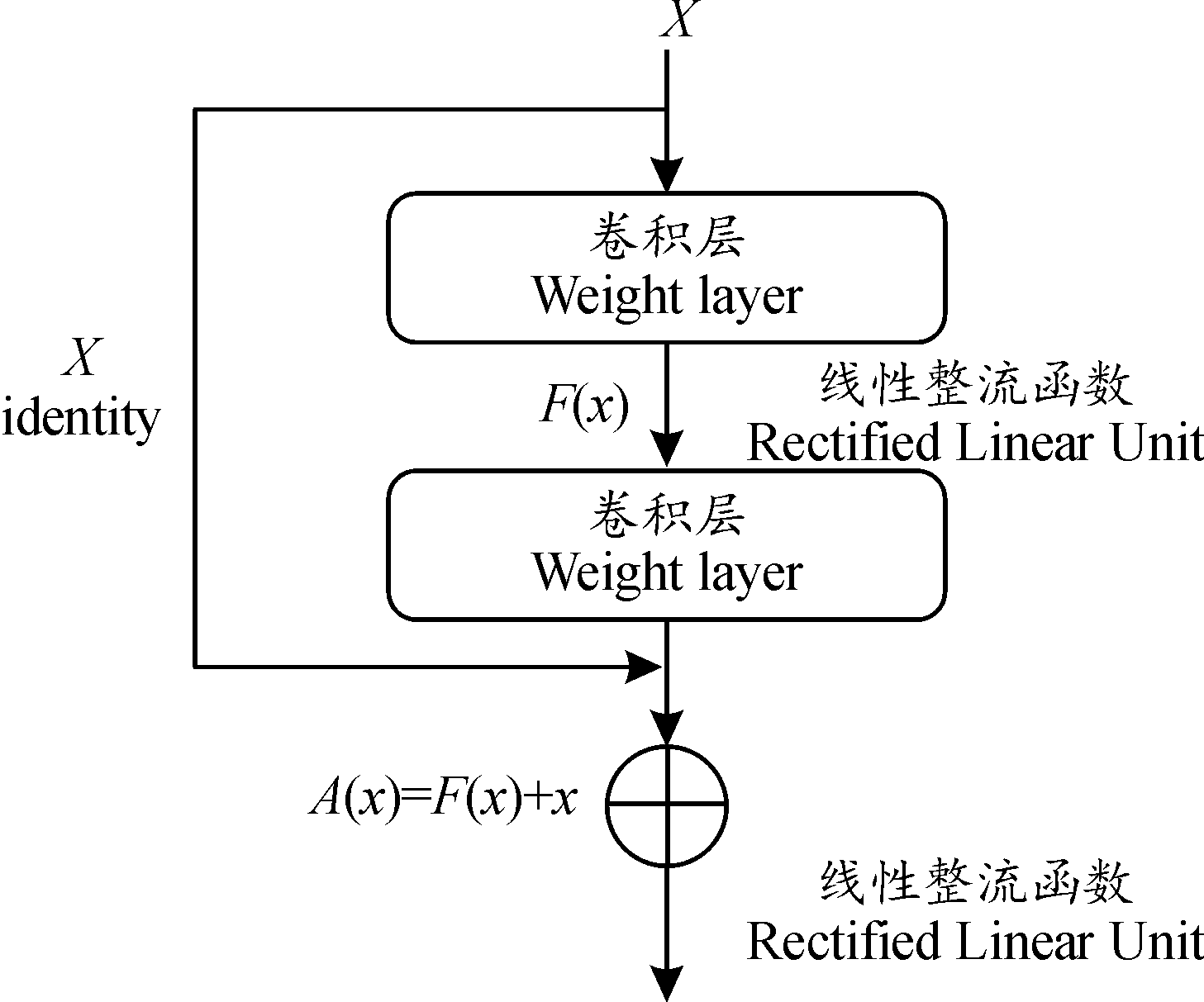

本文中需要识别的光电图像目标种类较多,并且目标大小也是模拟光电系统实际观测大小,所以需要特征提取能力较强的网络,若采用较深的网络结构,虽然可以提高网络的特征提取能力,但是随着网络不断的加深,不仅会使网络的训练速度呈现下降的趋势,模型难以收敛,还会使模型出现梯度消失、梯度爆炸等复杂问题。因此,本文使用了He等[6]在2015年提出的ResNet网络,即残差神经网络。首先使用ResNet网络在ImageNet数据集上预训练权重,然后使用本文中构建的光电图像数据集对模型再训练。网络结构如图2所示。

图2 残差块结构

Fig.2 Residual block structure

该残差块输出为

A(x)=F(x)+x

(6)

故网络的学习目标为

F(x)=A(x)-x

(7)

若此时卷积神经网络发生了梯度爆炸问题,无法继续学习,即F(x)=0,那么A(x)-x=0,即输出等于输入,故ResNet网络能够有效克服网络训练收敛难、网络退化和信息丢失等问题。

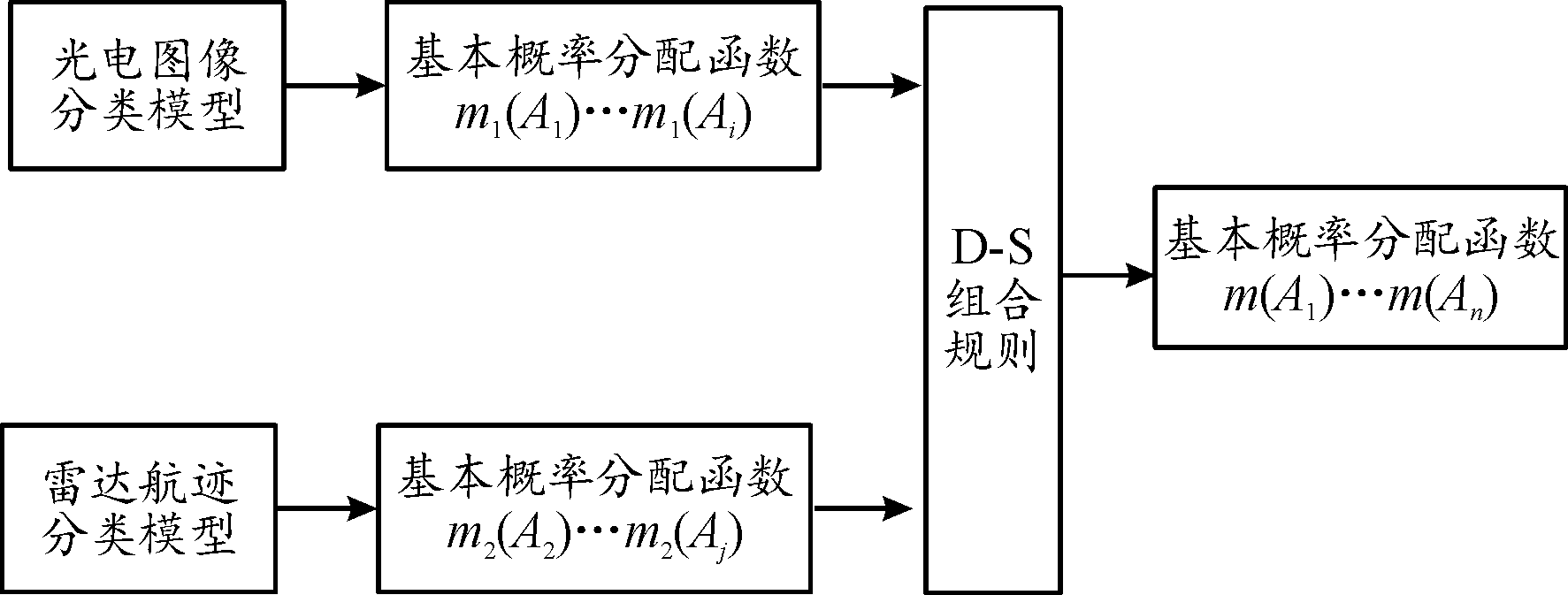

1.3 D-S证据理论

D-S证据理论是Dempster[7]提出,后经Shafter[8]的进一步发展而形成的一种不精确推理理论。其能够针对所研究的不确定性问题的基本事件幂集空间,确定相应的基本概率赋值,使用D-S组合规则进行融合,从而得到不确定性问题的解。本文中使用D-S证据理论的融合流程如图3所示。

图3 D-S融合流程图

Fig.3 D-S fusion flow chart

如图3所示,光电图像分类模型提供的基本概率分配函数为模型预测各个类别的概率m1(Ai),雷达航迹分类模型提供的基本概率分配函数为模型预测各个类别的概率m2(Aj)。

则融合后目标属性类别的概率分布为

![]()

(8)

式(8)中: m1(Ai)和m2(Aj)分别代表光电图像分类模型和雷达航迹分类模型预测目标属性为第i类和第j类的概率。K代表证据间的冲突程度,被称为冲突因子。1/1-K是确保融合质量一致性的归一化因子。K的计算式为

![]()

(9)

2 相关工作

2.1 数据集的构建

1) 光电图像数据集的构建。由于并没有针对巡航导弹(CM)、制导炸弹(GB)、空地导弹(AG)、武装直升机(AH)、无人机(UAV)、固定翼飞机(AC)6类目标的光电图像公开数据集,所以本文中通过多光谱软件仿真生成每个目标的光电图像数据,并对生成的图像进行随机翻转、随机裁剪、随机缩放、随机旋转等操作,以扩充数据集。生成的图像中不仅包含着战场背景信息同时目标在图片中的大小也是根据光学成像原理缩放,以模拟真实光电系统成像。P代表模拟真实光电系统成像目标的像素大小,计算公式为

![]()

(10)

式(10)中:H为目标实际尺寸,D为目标距光电传感器的距离, f为镜头焦距, μ为像元尺寸。

2) 雷达航迹信息数据集的构建。采用仿真的形式模拟部分了巡航导弹、制导炸弹、空地导弹、武装直升机、无人机、固定翼飞机6种目标航迹作为初始数据集,并对初始数据集内的轨迹进行旋转、对称和平移等操作,以扩充数据集。通过数据扩充,获得各个种类1 000条航迹,共计6 000条航迹作为数据集。并为所有轨迹添加均值为0的高斯白噪声以模拟观测的随机误差。其中方位角和高低角白噪声均方差为1密位,斜距离白噪声均方差为8 m。然后将上述轨迹转化到笛卡尔坐标系下进行卡尔曼滤波,去除缺失值后获得真实数据集。数据集中的原始特征包括扰动后的目标轨迹观测坐标(Observe)、卡尔曼滤波后的目标位置(filter_p)、目标速度(filter_V)、目标加速度(filter_a)。

2.2 雷达航迹信息特征提取

由于雷达航迹信息中存在着噪声的影响,所以需要将获得的航迹转化到笛卡尔坐标系下进行卡尔曼滤波,去除缺失值后获得真实数据集,而后通过特征工程进一步提取运动特征。

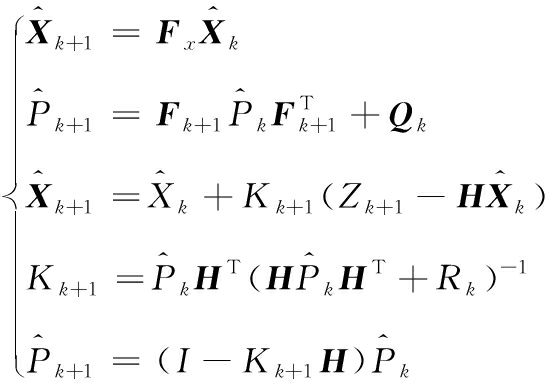

1) 卡尔曼滤波。目标运动学模型一般在笛卡尔坐标系下进行描述,其状态方程如式(11)所示:

Xk+1=FkXk+Wk

(11)

式(11)中:Xk为k时刻的目标状态;Fk为状态转移矩阵;Wk为均值为0,协方差矩阵为Qk的高斯白噪声。以xk、yk、zk与vx,k、vy,k、vz,k分别表示三维笛卡尔坐标系下的目标位置、速度,以ax,k、ay,k、az,k表示目标加速度,则目标状态向量Xk如式(12)所示:

Xk=[xk yk zk vx,k vy,k vz,k ax,k ay,k az,k]Τ

(12)

跟踪系统测量方程如式(13)所示:

Zk+1=HXk+Vk

(13)

式(13)中:H为测量矩阵,Vk为均值为0,协方差为Rk的高斯白噪声。

卡尔曼滤波是一种典型的线性最优滤波算法,在滤波时根据当前接收的观测数据和上一时刻的估值,根据系统状态方程,使用卡尔曼增益进行修正,预报出新的状态估计值。卡尔曼滤波的主要计算过程如式所示:

(14)

式(14)中:![]() 为验后的状态估计,

为验后的状态估计,![]() 为验后的协方差估计,K为滤波增益。

为验后的协方差估计,K为滤波增益。

2) 特征工程。主要的特征工程为滤波值特征上的统计特征值和常用的在滤波后速度和加速度上的航迹特征。基本特征为卡尔曼滤波后的目标位置、目标速度、目标加速度。其他特征在基础特征上衍生,首先对基础特征坐标变换,不妨以s表示某基础特征向量,则坐标变换如式(15)所示:

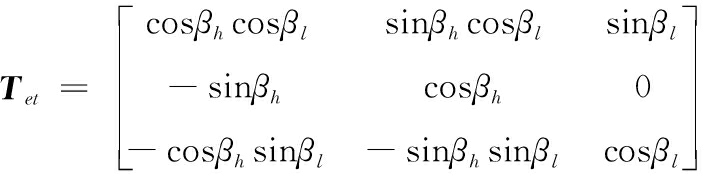

[sTx,sTy,sTz]T=Tet[sx,sy,sz]T

(15)

(16)

(17)

式(17)中: r矢量为坐标变换的基础矢量, βh为航向角,βl为俯冲角。

衍生特征在变换后的基础特征上构建,包括矢量平滑,平滑矢量的差分、模、相似度以及曲率依次如式(18)—式(22)所示:

![]()

(18)

![]()

(19)

![]()

(20)

![]()

(21)

![]()

(22)

式(18)—式(22)中:![]() 和

和![]() 为变换坐标后的基础特征。

为变换坐标后的基础特征。

3 实验设置

本文中所有的实验均在Linux系统下完成,电脑处理器为Intel i7-8700k,运行内存大小为32 GB,GPU 型号为 NVIDIA GeForce RTX2080,显存大小为16 GB。

3.1 训练过程与参数设置

1) 针对ResNet网络。由于原始的ResNet-34上的输出层数为1 000,为符合本文中的分类目标种类数,故将其输出层数改为6。训练采用超参数为:batchsize设置为16,训练轮数为100轮,学习率为0.001。

2) 针对XGBoost网络。XGBoost的训练过程中采用基于贝叶斯优化的Optuna[9]库搜索最优参数,主要优化参数范围为:树模型的深度在1~15,学习率在0.01~0.15,L1正则化系数在0.1~10,L2正则化系数在0.1~10,数据集采样比率和特征采样比率都在0.1~1。Optuna搜索出最优参数后,训练最大迭代次数为3 000,模型的损失函数采用交叉熵损失函数,当模型在验证集上的得分持续1 000次迭代不再提升即停止训练。

3.2 评价指标

网络训练完成后,需要在测试集上测试网络的效果,基于D-S融合的目标属性识别模型本质上是多分类模型,评价多分类模型的效果时采用的指标是由二分类问题的评价指标发展而来。

在二分类问题中,常用的指标包括分类准确率(accuracy)、精确率(precision)、召回率(recall)和F1得分(F1)。这些指标和TP(正类预测为正类的样本数)、FP(负类预测为正类的样本数)、TN(负类预测为负类的样本数)、FN(正类预测为负类的样本数)相关。在军事武器系统中,希望目标属性被误分类的概率最小化,故本文使用召回率作为模型的分类评价指标,召回率的定义如式(23)所示:

![]()

(23)

4 实验结果分析

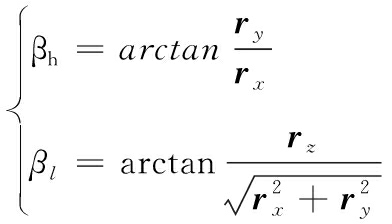

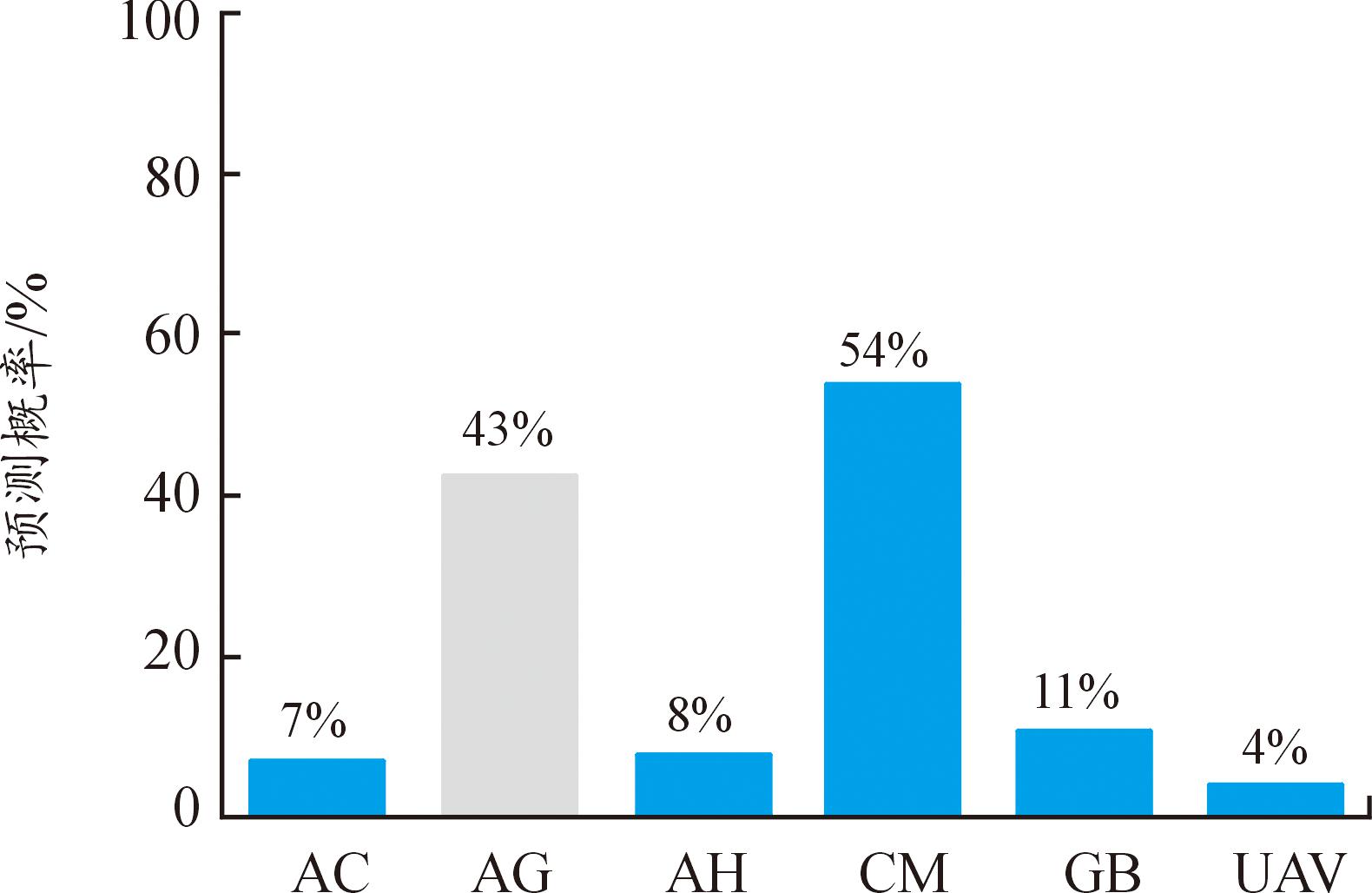

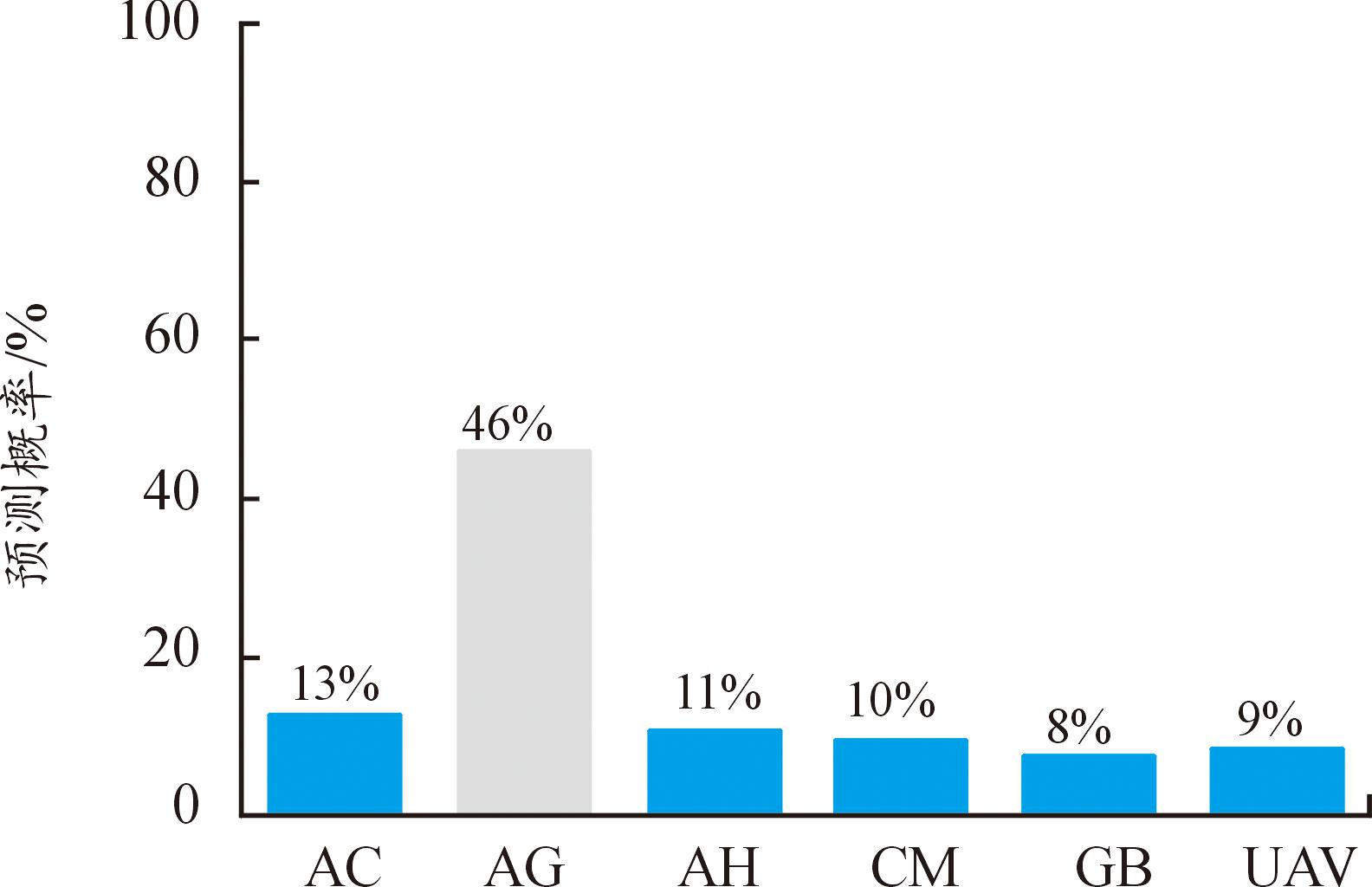

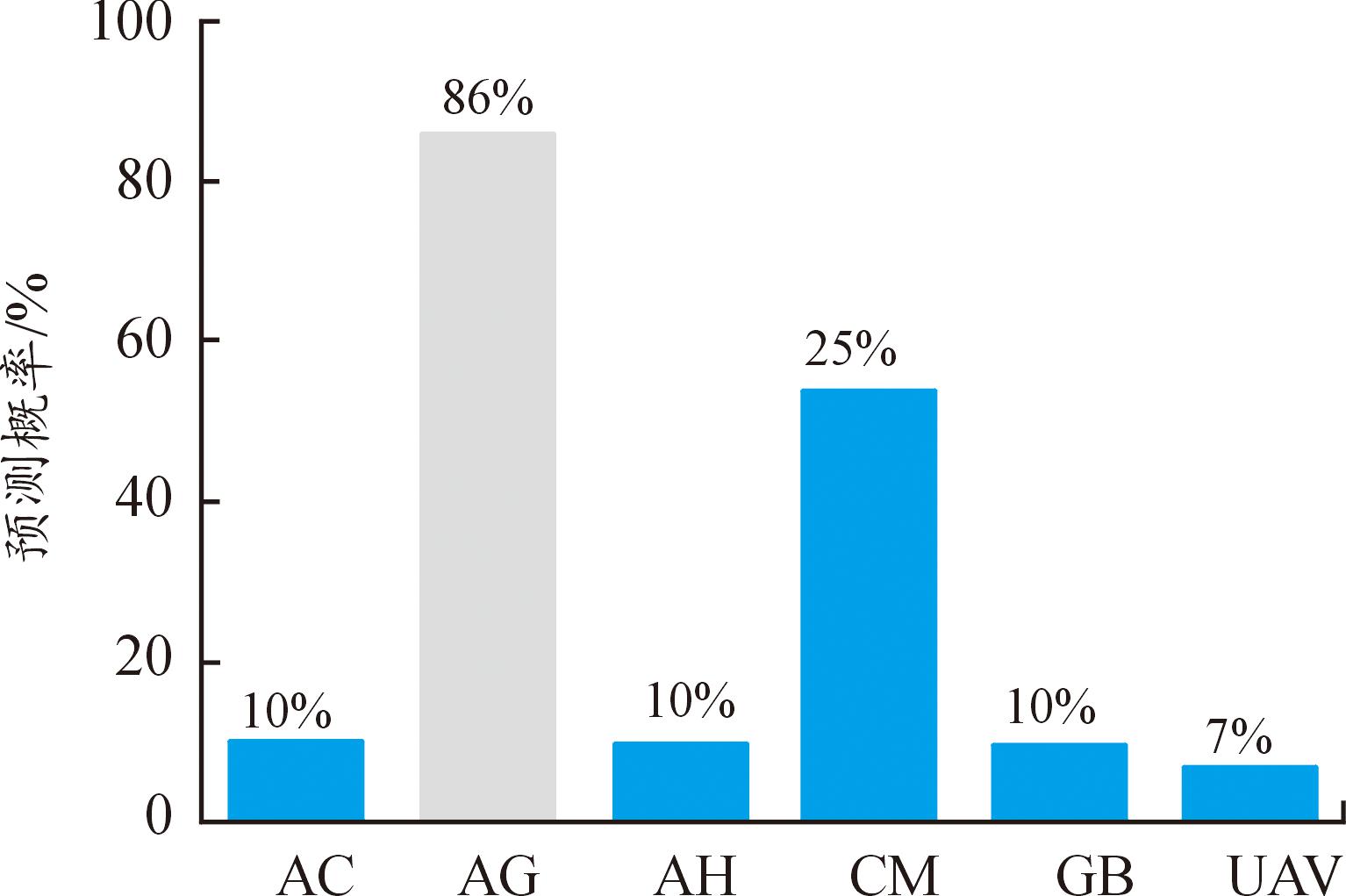

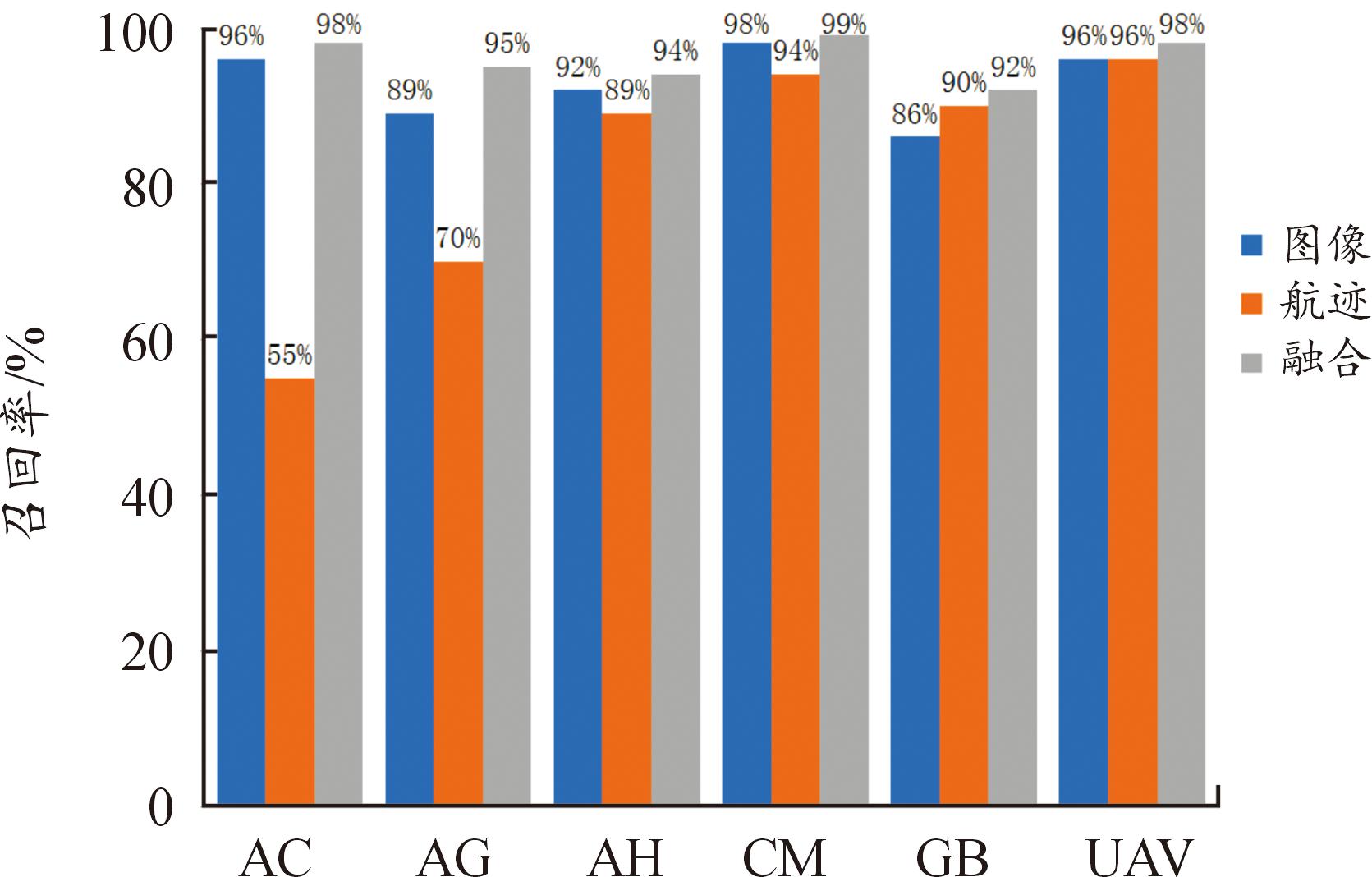

1) D-S融合对各模型误分类的影响。为验证D-S融合能否矫正因为单一模型分类错误而导致最终识别结果错误的问题,本文中分别对真实标签为AG的光电图像与航迹信息进行属性识别,并将单个模型对每个类别的预测概率与最终融合后模型对每个类别的预测概率进行对比。各模型对每个类别的预测概率分别如图4—图6所示。

图4表明了图像分类模型对真实标签为AG的光电图像目标属性识别结果为CM,并且识别为CM的概率为54%,识别为AG的概率为43%;图5表明了航迹分类模型对真实标签为AG的航迹特征目标属性识别结果为AG,并且识别为AG的概率为46%;图6表明了融合后模型的目标属性识别结果为AG,并且识别为AG的概率为86%。

图4 图像分类模型对真实标签为AG的各类别预测概率

Fig.4 Image classification model prediction probability for each category with true label as AG

图5 航迹分类模型对真实标签为AG的各类别预测概率

Fig.5 Trace classification model prediction probability for each category with true label as AG

图6 融合模型对真实标签为AG的各类别预测概率

Fig.6 Fusion model prediction probability for each category with true label as AG

由上述结果可知,即使光电图像分类模型给出了一个错误的识别结果,但通过D-S融合后,最终的识别结果却是正确的,并且最终预测为正确类别的概率也是高于融合前各模型预测为正确类别的概率。

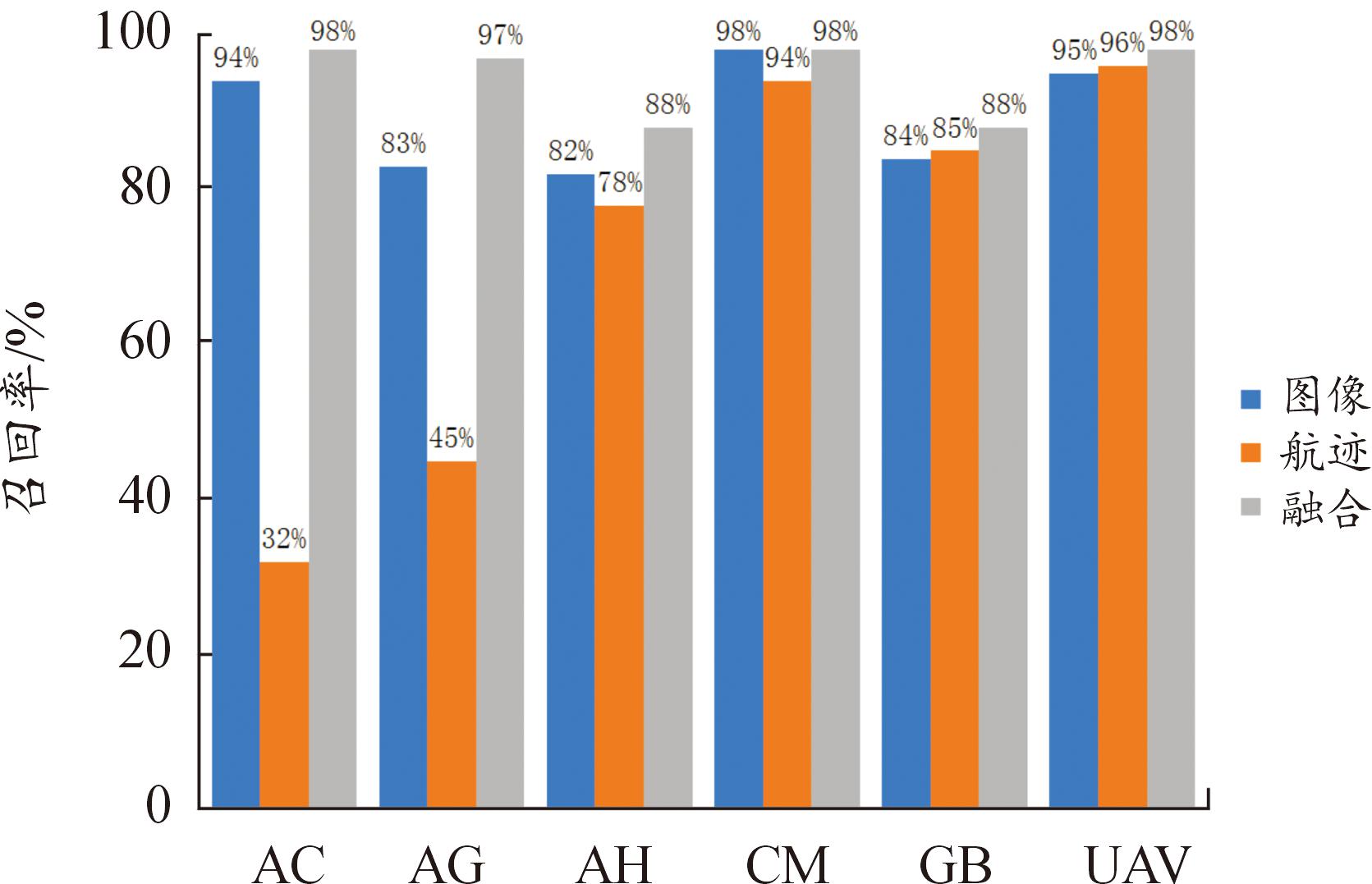

2)D-S融合对单一模型识别能力的影响。为了验证本文中所提出的使用D-S融合的方法是否能提高目标属性识别能力,本文中分别模拟了目标距光电传感器的距离D为1~3 km和3~5 km的航迹分类模型识别结果和光电图像分类模型识别结果与融合后的识别结果进行对比。各模型召回率在2种距离D上的实验结果分别如图7、图8所示。

图7 距离D为1~3 km的召回率

Fig.7 Recall at a disdance of 1~3 km

图8 距离为3~5 km的召回率

Fig.8 Recall at a disdance of 3~5 km

图7表明在目标距光电传感器距离D为1~3 km上,融合后模型各目标的召回率都均高于融合前单一模型各目标的召回率,并且融合后模型各目标的召回率比光电图像分类模型各目标的召回率平均高3%左右,比雷达航迹分类模型各目标的召回率平均高10%左右。图8表明在目标距光电传感器距离D为3~5 km上,融合后模型各目标的召回率也都均高于融合前模型各目标的召回率,且比光电图像分类模型各目标的召回率平均高5%左右,比雷达航迹分类模型平均高15%左右。

由上述结果可知,无论是距离D为1~3 km或是3~5 km上的目标属性识别,融合后模型的识别能力均高于融合前模型的识别能力。

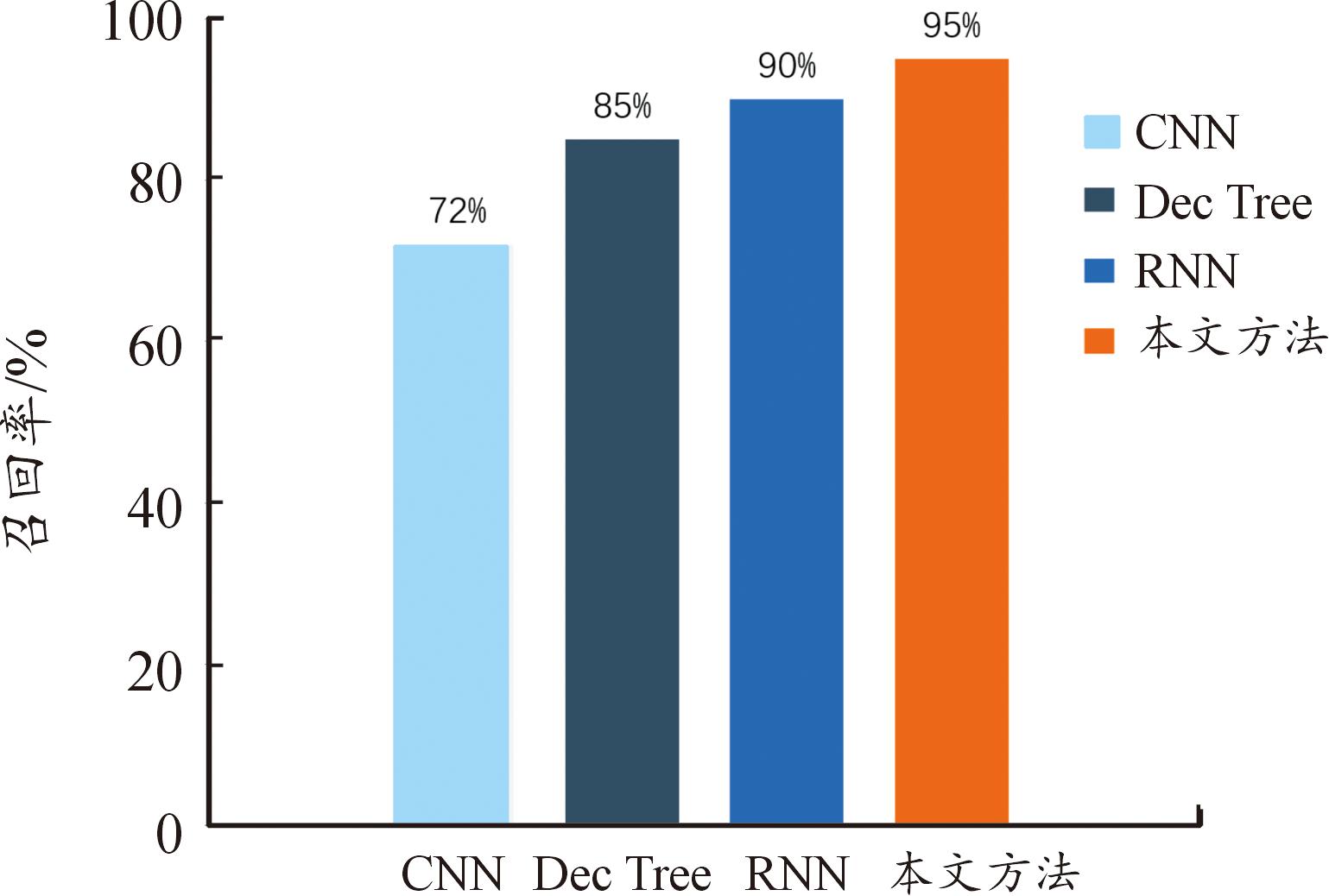

3) 本文中方法和其他算法性能比较。为验证所提方法的优越性,选取了3个常用于雷达航迹分类识别的算法与所提方法对比,分别是卷积神经网络(convolutional neural network,CNN)、递归神经网络(recursive neural network,RNN)以及决策树(decision tree,Dec Tree)。不同算法在识别性能召回率上实验结果如图9所示。

图9 各算法识别的召回率

Fig.9 Recall rate of each algorithm recognition

图9实验结果表明了CNN的识别效果一般, CNN虽然能自动从数据中学习特征,但CNN在处理有时序特征的数据时,其识别效果往往不理想;RNN和Dec Tree的识别效果较好,RNN在处理序列数据时往往会取得较好的结果,而一旦处理类似雷达航迹这种拥有长时间序列特征的数据时,其结果往往有待提升,决策树通常是递归选择最优属性,并根据该特征对训练数据进行分割,故而能得到较好的结果,但是决策树没有考虑航迹数据的时序性,所以结果也有待提升。以上算法对航迹识别性能均低于本文中所提的方法,从而验证了本文中所提方法在目标航迹识别上的良好效果。

综上可知,所提方法在雷达航迹识别性能上均高于其他的对比算法,提高了雷达航迹识别的召回率,同时无论是远距离目标属性识别或者近距离目标属性识别,融合后模型的识别能力也均高于融合前单一模型的识别能力,并且也能矫正因单一模型分类错误而导致最终识别结果错误的问题,从而表明本文中所提方法的有效性。

5 结论

本文中提出了一种基于光电图像和雷达航迹信息融合的目标属性识别方法,通过使用D-S组合规则将ResNet网络和XGBoost网络得到的目标类别概率进行融合。经实验表明:通过D-S融合能矫正因为单一网络识别错误而导致最终结果识别错误的问题;无论是在远或近距离目标的属性识别上,融合后模型的召回率都均高于单一模型的召回率,且融合后模型的平均召回率为95%。

[1] 樊玉琦,刘瑜岚,许雄,等.基于点迹时空关系的雷达目标航迹识别[J].电子测量与仪器学报,2020,34(9):108-116.

FAN Yuqi,LIU Yulan,XU Xiong,et al.Radar target track recognition based on spatial-temporal relationship of track points[J].Journal of Electronic Measurement and Instrumentation,2020,34(9):108-116.

[2] 樊玉琦,温鹏飞,许雄,等.基于卷积神经网络的雷达目标航迹识别研究[J].强激光与粒子束,2019,31(9):68-73.

FAN Yuqi,WENG Pengfei,XU Xiong,et al.Research on radar target track recognition based on convolution neural network[J].High Power Laser and Particle Beams,2019,31(9):68-73.

[3] 孙宁,秦洪懋,张利,等.基于多传感器信息融合的车辆目标识别方法[J].汽车工程,2017,39(11):1310-1315.

SUN Ning,QIN Hongmao,ZHANG Li,et al.Vehicle target recognition based on multi-sensor information fusion[J].Automotive Engineering,2017,39(11):1310-1315.

[4] 卢莉萍,张晓倩.复杂环境下多传感器目标识别的数据融合方法[J].西安电子科技大学学报,2020,47(4):31-38.

LU Liping,ZHANG Xiaoqian.Datafusion method of multi-sensor target recognition in complex environment[J].Journal of Xidian University,2020,47(4):31-38.

[5] TIANQI CHEN,CARLOS GUESTRIN.Xgboost:A scalable tree boosting system[J].CoRR,2016(12):2754-2763.

[6] HE K,ZHANG X,REN S,et al.Deep residual learning for image recognition[C]//Proceedings of the IEEE conference on computer vision and pattern recognition.2016:770-778.

[7] DEMPSTER A P.Upper and lower probabilities induced by a multivalued mapping[J].Annals of Mathematical Statistics,1967,38(2):325-329.

[8] SMITH A F M,SHAFER GLENN.A Mathematical theory of evidence[J].Biometrics,1976,32(3):173-179.

[9] AKIBA T,SANO S,YANASE T,et al.Optuna:A next-generation hyperparameter optimization framework[J].ACM,2019,12(3):144-148.

[10]王超,万兆江,周瑜杰,等.基于ResNet-50垃圾分类算法的改进及应用[J].智能计算机与应用,2022,12(10):184-188.

WANG Chao,WAN Zhaojiang,ZHOU Yujie,et al.Reserch on garbage classification algorithm based on improved RseNet-50[J].Intelligent Computer and Application,2022,12(10):184-188.

[11]闫吉庆,沈志远,吕靖,等.基于XGBoost和文本聚焦模型的招标文件自动分类[J].武汉大学学报(工学版),2022,55(3):310-318.

YAN Jiqing,SHEN Zhiyuan,LYU Jing,et al.Automatic classification of bidding documents based on XGBoost and text focus model[J].Engineering Journal of Wuhan University,2022,55(3):310-318.

[12]杨淑洁,孙伟,卢威,等.舰船雷达与AIS信息融合技术[J].舰船科学技术,2021,43(3):167-171.

YANG Shujie,SUN Wei,LU Wei,et al.Review of research on information fusion of shipborne radar and AIS[J].Ship Science and Technology,2021,43(3):167-171.

[13]KUMAR A,SARAWAGI S,JAIN U.Trainable calibration measures for neural networks from kernel mean embeddings[C]// International Conference on Machine Learning PMLR.2018.