0 引言

地球表面71%被水覆盖,海洋在全球资源交流和经济联系中扮演着重要角色。船舶作为水路交通运输的主要工具,承载着大量的货物和人员,为全球贸易和人员往来提供了便利[1]。随着内河航运的发展,船舶数量、种类和货运量都不断增加,经济效益提升的同时,内河航道监管面临严峻挑战[2]。统计船舶流量,监控船舶违法行为,水面安全事故调查等都离不开船舶监测[3]。船舶检测的核心是对船舶目标的实时准确检测。

得益于卷积神经网络(CNNs)[4]在目标检测领域中的广泛应用,一些学者也将其引入船舶检测中。与传统的目标检测[5]相比,基于卷积神经网络的目标检测算法可以通过训练来自主提取和利用图像的重要特征,不受人工提取质量不均衡的限制,能获得更准确的检测结果和更高的检测效率[6]。目前主要分为以SSD[7]、YOLO系列为代表的一阶段检测算法和以R-CNN、Faster R-CNN系列为代表的两阶段检测算法[8]。赵林等[9]使用预训练网络提取并连接特征图,并通过抑制冗余子特征映射提高了Faster R-CNN网络的检测性能。但是以Faster R-CNN为代表的两阶段算法仍然不能达到实时检测的要求。Yang等[10]在SSD检测模型的基础上,引入新的损失函数和Soft-NMS算法,使用3种上采样方法,提高了对遮挡船舶和小目标船舶的检测精度。Zheng等[11]采用重构自适应锚框、加权核聚类等方式来提高检测精度,并使用BN比例因子压缩YOLOv5网络,达到轻量化效果。

虽然深度学习方法在船舶实时监测领域已取得一些进展,但是自然条件下该任务仍然面临挑战。一是目前对于船舶实时监测工作大多关于SAR船舶探测器,而实景情况下船舶检测跟踪的研究不够深入[12]。二是水面条件复杂,障碍物等干扰因素多,如河道建筑、浮标和尾迹等都影响检测效果,以及同种船舶外观差距大等[13]。三是目前实景船舶监测的主要研究重点还是放在了模型准确度提升上,在减少模型参数量和计算量上的工作较为欠缺。此外,如何在精度、速度和计算成本之间取得良好平衡,将船舶监测模型部署到内存和计算能力有限的设备进行实际应用仍是一个挑战[14]。

本文中针对上述自然水域下船舶实时检测问题,提出了一种基于改进YOLOv7的船舶目标检测算法。在传统YOLOv7算法的基础上,将GhostNet网络和分布偏移卷积DSConv引入检测模型,以此来降低检测模型的参数量和计算量,达到轻量化的效果。同时引入注意力机制来弥补模型轻量化带来的精度损失,保持检测模型的高精度。结合船舶数据集的特点,引入WIoU,优化检测模型的损失函数,进一步提高了模型的检测精度。改进后的算法兼顾了轻量化和检测精度,有较好的系统性能。

1 改进的YOLOv7目标检测算法

1.1 YOLOv7目标检测算法

YOLO算法作为一阶段目标检测算法典型的代表之一,它基于深度神经网络进行对象的识别和定位,运行速度很快,可以用于实时检测以及相应的目标跟踪等任务。YOLOv7算法由Wang等[15]提出,检测速度和检测精度都比较均衡,非常适合用来作为船舶目标检测的基础模型。

就模型精度和推理性能而言,YOLOv7系列中比较均衡的是YOLOv7模型,如图1所示。整个YOLOv7网络所做工作就是特征提取-特征加强-预测先验框对应的物体情况。与之前的YOLO系列相比,YOLOv7在主干部分引入了ELAN和MP结构。ELAN通过控制最短最长的梯度路径,更深的网络可以有效地学习和收敛,模型的跳连接结构更加的密集。使用了创新的下采样结构,使用最大池化和步长为2×2的特征并行进行提取与压缩。在颈部特征融合和检测头部分引入了特殊的SPP结构,在SPP结构中引入CSP结构,扩大感受野,可以通过一个大的残差边辅助优化与特征提取。在检测头部分,YOLOv7借鉴了RepVGG的结构,实际预测的时候,可以将复杂的残差结构等效于一个普通的3×3卷积,降低了网络复杂度,同时保证了网络的预测性能。

图1 YOLOv7结构

Fig.1 YOLOv7 model structure

至于损失函数,YOLOv7的损失函数整体和YOLOv5保持一致,分为坐标损失、目标置信度损失和分类损失等3个部分。目标置信度损失和分类损失采用带log的二值交叉熵损失,坐标损失采用CIoU损失。

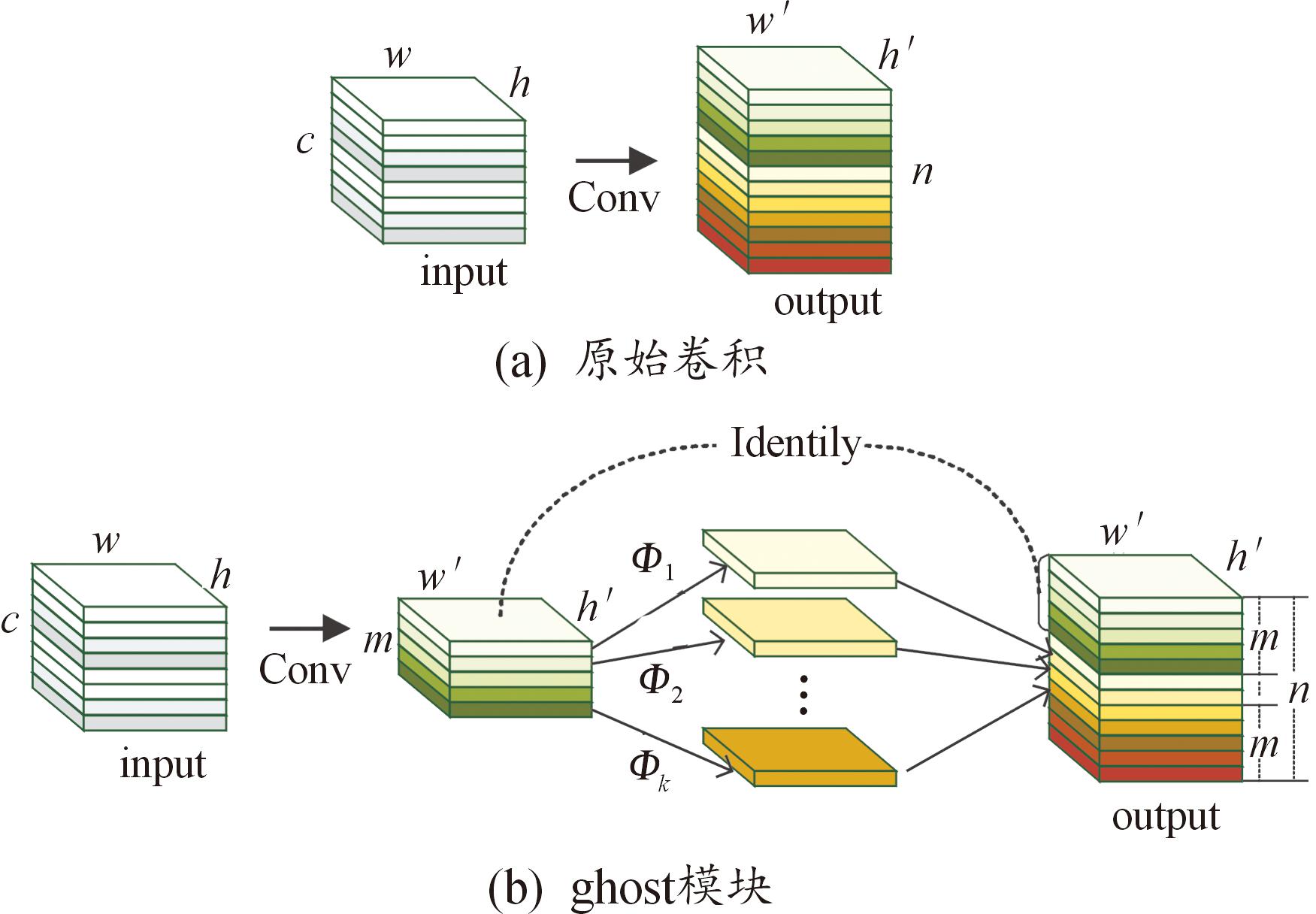

1.2 轻量特征提取网络

为了在内存和计算资源有限的情况下,船舶目标检测模型能达到良好的检测效果,本文中将轻量级检测网络GhostNet引入YOLOv7的主干特征提取网络中。GhostNet网络[16]是华为诺亚方舟实验室在2020年提出的一个轻量级网络,它使用一些计算量更低的操作,生成神经网络中冗余但重要的特征图,高性能的GhostNet是由ghost模块开发而成,ghost模块先利用1×1卷积获得输入特征的必要特征浓缩,然后通过低廉的线性操作Ф来代替部分通过卷积提取的特征,保留m个本质特征映射图,生成s-1组特征浓缩的相似特征图,对特征进行增强。图2(a)为原始卷积,图2(b)表示ghost模块。

图2 原始卷积与ghost模块

Fig.2 The convolutional layer and the ghost module

最终,ghost模块的输出和原始卷积输出的大小相同。线性操作Ф在每个通道单独进行,大大减少了模型参数量和运算量。理论上使用ghost模块和使用普通卷积的加速比,即

(1)

同理,模型的压缩比为

(2)

式(1) 、式(2)中:n表示输出特征映射图的通道数;h和w分别表示输入数据的高和宽;c表示输入的通道数;k表示卷积核的尺寸;d×d和k×k为相同量级;s=n/m,且s·c。

1.3 引入分布移位卷积的特征融合网络

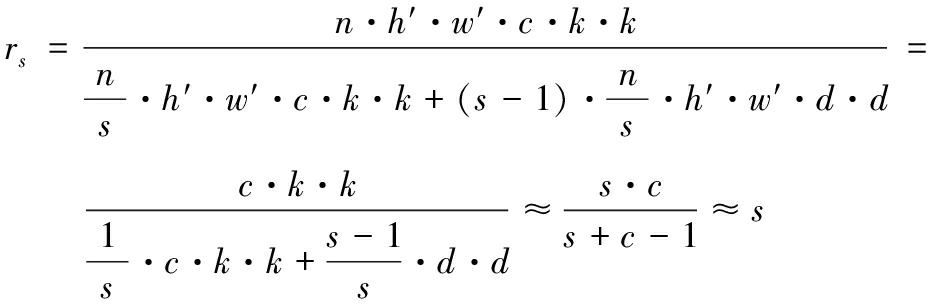

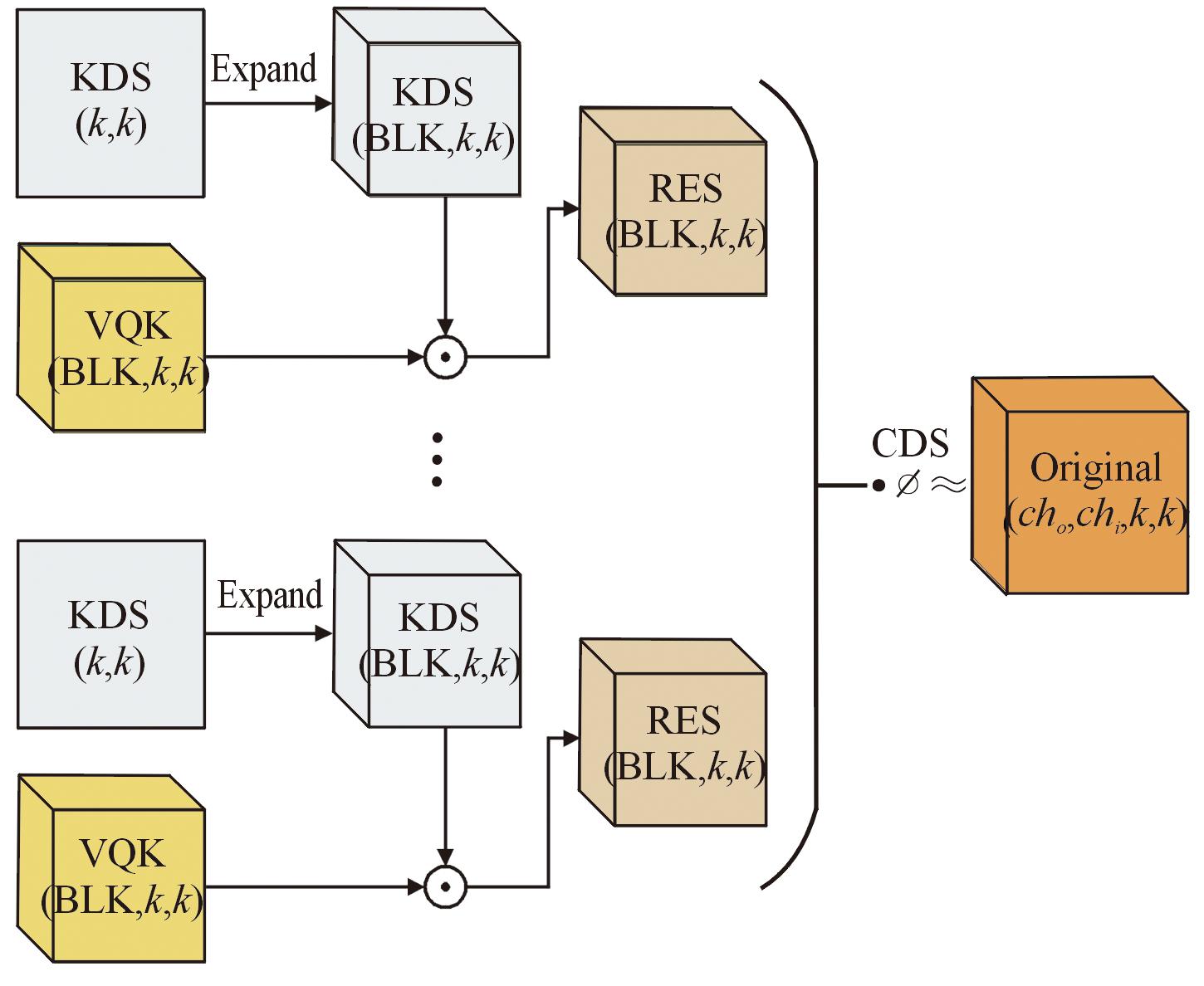

在主干轻量化的基础上,为了进一步提高船舶目标检测速度,降低内存使用,使YOLOv7模型能够部署到嵌入式移动设备上,本文中将高效卷积算子DSConv引入YOLOv7的特征融合网络中。

DSConv[17]是分布移位卷积,使用量化和分布偏移来模拟卷积层的行为。DSConv将传统的卷积核分解为2个组件:可变量化核 (VQK) 和分布偏移。在 VQK 中仅存储整数值,量化原始的浮点卷积核参数,来实现更低的内存使用和更高的速度。然后再通过内核分布偏移(KDS)和通道分布偏移(CDS)移动VQK,使输出和原始权重张量的值相匹配,最后保持与原始卷积参数相同的输出。DSConv 的基本操作如图3所示,在每个通道和块上执行这个操作。原始卷积张量的大小为 (cho,chi,k,k),其中 cho 是下一层的通道数,chi 是当前层中的通道,k是内核的宽度和高度,BLK是块大小超参数,⊙表示Hadamard操作符。

图3 DSConv操作

Fig.3 Operation of DSConv

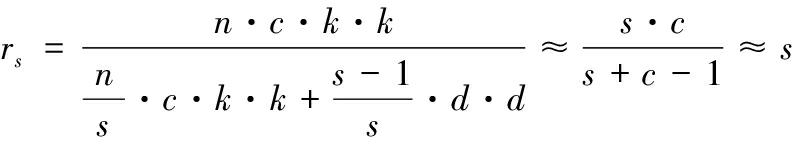

1.4 引入注意力机制的特征融合网络

GhostNet思想和DSConv思想的引入与应用,使船舶目标检测网络的参数量和计算量大幅降低,但随之而来的是模型的检测精度降低。为了在模型轻量化的同时,还能保证检测精度高,本文中将CBAM这一轻量级注意力模块引入到YOLOv7的特征融合网络中。

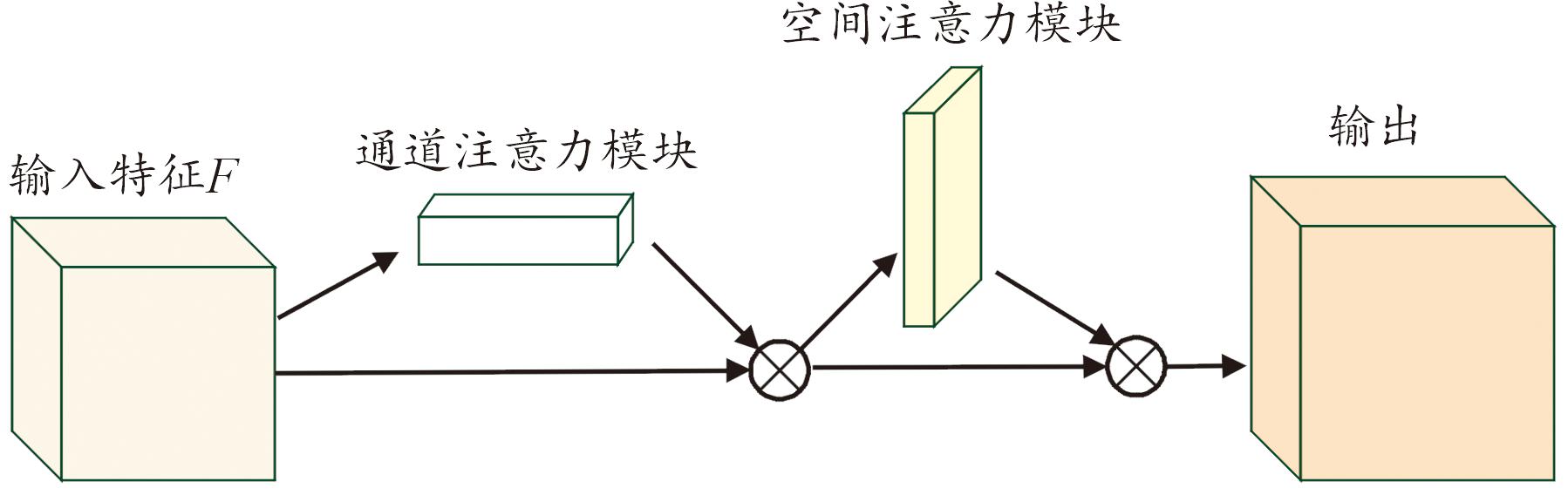

CBAM结合了通道注意力机制和空间注意力机制,相比于只关注通道的注意力机制,CBAM兼顾了空间相关性和通道相关性,模型可以取得更好的检测效果,获得更好的泛化性。CBAM可以对输入进来的特征层分别进行通道和空间上的注意力机制处理。其实现示意图如图4所示。

图4 CBAM

Fig.4 CBAM

通道注意力模块用于调整特征图中每个通道的权重,有助于网络选择有关的特征通道。首先,通过全局平均池化或全局最大池化操作,将每个通道的特征图转换为一个标量值,表示该通道的全局重要性。接着,通过一个包含全连接层和激活函数的结构,将全局特征转换为通道注意力权重。这些权重决定了每个通道在后续特征计算中的重要性。最后,将学习到的通道注意力权重应用到原始特征图的每个通道上,通过乘法运算来调整每个通道的特征响应。这样,网络在学习过程中可以更加关注对当前任务重要的通道,从而提高模型的性能和泛化能力。通道注意力表达式为

MC(F)=σ(MLP(AvgPool(F))+MLP(MaxPool(F)))

(3)

空间注意力模块用于在特征图的不同位置上调整权重,有助于选择有关的特征区域。它保持空间维度不变,压缩通道维度。首先,对输入特征图进行2个不同的操作:最大池化和平均池化,以获得每个空间位置的最大值和平均值。这2种操作有助于捕捉每个位置的重要性和整体分布。将最大池化和平均池化的结果连接在一起,并通过一个包含全连接层和激活函数的结构,学习得到每个空间位置的空间注意力权重。这些权重决定了不同位置在后续特征计算中的重要性。最后,将学习到的空间注意力权重应用到原始特征图的每个位置上,通过乘法操作来调整每个位置的特征响应。这样,网络可以更加关注对当前任务重要的空间位置,提高模型的性能和泛化能力。空间注意力表达式为

MS(F)=σ(f7×7([AvgPool(F); MaxPool(F)]))

(4)

式(4)中: F表示输入特征图;AvgPool表示平均池化;MaxPool表示最大池化;MLP表示共享的全连接层模块;σ表示激活函数sigmoid; f7×7表示7×7卷积。

1.5 损失函数优化

边界框回归损失函数是目标检测损失函数的组成部分之一,对目标检测模型的性能有重要影响。YOLOv7网络的原始边界框损失函数是CIoU。CIoU考虑了预测框和真实框之间的重叠面积、中心点距离、宽高纵横比,其损失函数为

![]()

(5)

式(5)中:IoU表示预测框与真实检验框的交并比;b表示真实框的中心点;bgt表示预测框的中心点;c代表覆盖2个框的最小矩形框的对角线距离; ρ表示b和bgt中心点坐标之间的距离;α表示权重函数,v描述了纵横比一致性。α、v具体定义为

![]()

(6)

![]()

(7)

现有工作主要是强化边界框损失的拟合能力,但是船舶目标检测的训练集会存在低质量示例,尤其是在一些标注质量差的数据集上。如果一味地强化边界框对低质量示例的回归,显然会危害船舶模型检测性能的提升。因此,本文中提出将基于动态非单调聚焦机制的边界框损失函数Wise-IoU(WIoU)应用于YOLOv7算法。WIoU[18]使用“离群度”替代 IoU 对锚框进行质量评估,并提供了明智的梯度增益分配策略。在船舶数据集上, WIoU 可以聚焦于普通质量的锚框,相对其他边界框损失的表现更好。同时,因为WIoU主要计算聚焦系数,统计IoU的损失均值,没有计算纵横比,反而会比CIoU有更快的速度。本文中使用的WIoU表达式为

LWIoU=r·(1-IoU)·RWIoU

(8)

式(9)中,r为非单调聚焦系数。r定义为

![]()

(9)

式(10)中, β为定义的离群度,离群度越小意味着船舶锚框质量越高。β表达式为

![]()

(10)

![]()

(11)

式(11)中:Wg和Hg分别表示最小包围框的宽和高;上标表示将Wg、Hg从计算图中分离,可以有效消除阻碍收敛的因素。

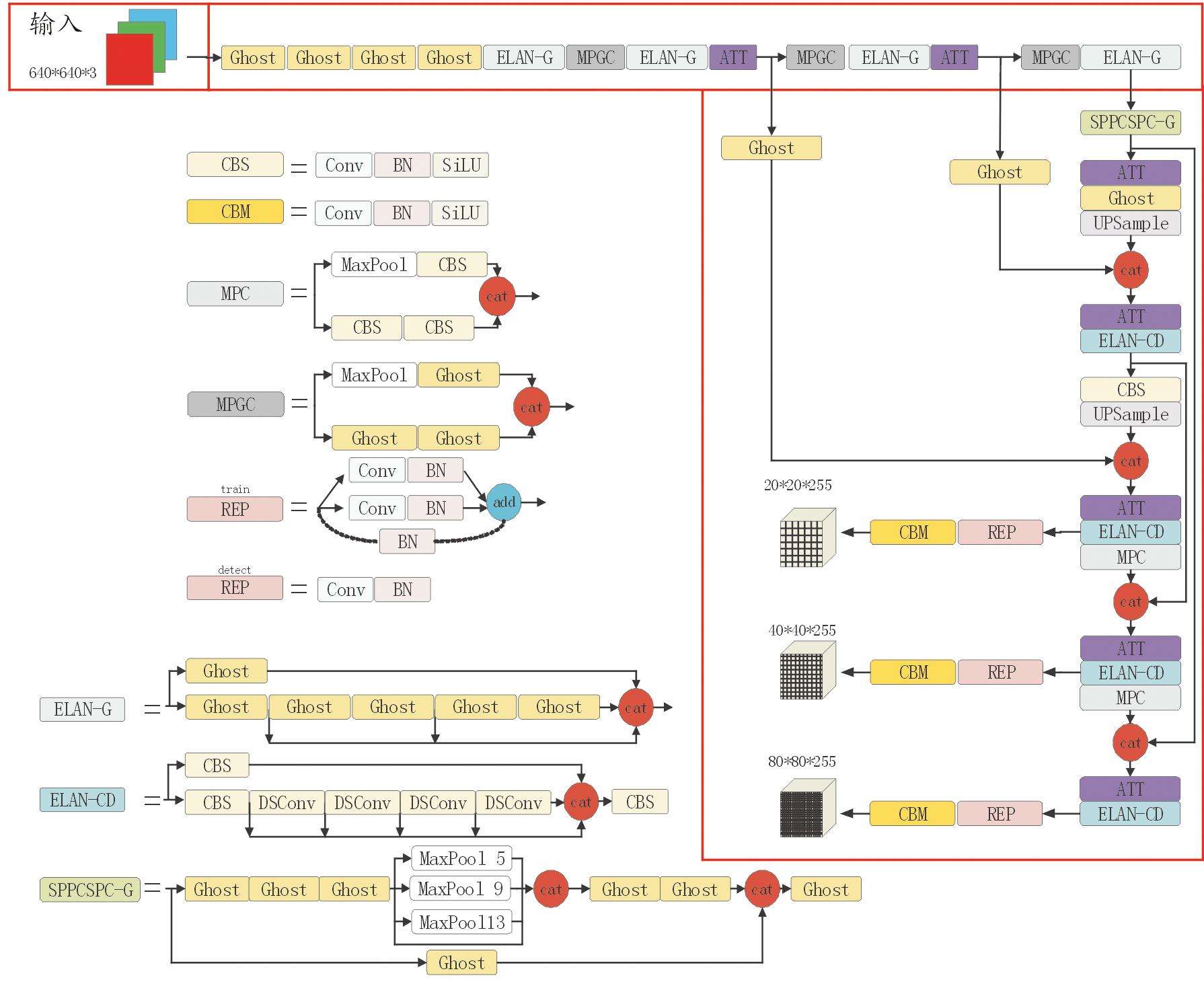

1.6 YOLOv7-F船舶目标检测模型

本文中在YOLOv7网络基础上进行改进,结合了GhostNet、 DSConv、注意力机制和WIoU,最终得到优化模型YOLOv7-F。它减少模型参数量和计算量的同时,还提高了检测模型的准确度。YOLOv7-F以YOLOv7网络为基准模型,主干网络借鉴了GhostNet的思想,初步实现了模型的轻量化。在此基础上,特征融合网络引入分布移位卷积DSConv,取代原始网络模型中的3*3卷积核,进一步减少了检测模型的参数量和计算量。Ghost模块和DSConv模块实现了本文中算法结构的轻量化。为了弥补模型简化和参数量减少带来的精度损失,在轻量化后的模型中加入轻量级注意力模块CBAM。基于改进YOLOv7的船舶实时目标检测模型结构如图5所示。

图5 YOLOv7-F模型结构

Fig.5 YOLOv7-F model structure

考虑到模型轻量化以及船舶数据集标定的质量不均衡等问题,本文中使用WIoU这一损失函数取代原始算法使用的CIoU损失函数。当锚框与目标框很好地重合时,损失函数WIoU减少对几何因素的惩罚,而较少的训练干预将使船舶检测模型获得更好的泛化能力。使用WIoU比使用CIoU计算速度快,在标注质量不均衡的数据集上性能提升效果更好。

2 实验数据及处理

本文中目标检测模型训练所用实验数据来源于自建的上海黄浦江面真实船舶数据集,为满足深度学习对大量训练样本需求,增加模型泛化能力,本文中采用随机缩放、翻转、Mosaic和mixup等方式进行数据增强。

2.1 评价指标

为了客观评价算法改进前后的差异,在模型轻量化方面,选取浮点运算次数FLOPs和参数量来评价模型复杂度和模型大小。在检测精度方面,选取的评价指标为召回率(recall,R)、精准率(precision,P)、平均均值精度mAP和P-R曲线。P-R曲线分别以召回率和精准率为横纵坐标,能直观反映全局性能[19]。

2.2 实验平台

本实验基于Ubuntu 20.04操作系统,CPU型号为Intel(R)Xeon(R)Silver 4210R CPU @ 2.40 GHz 2.39 GHz,GPU 选用 NVIDIA RTX A4000,使用的深度学习框架为 Pytorch 1.7.1,编程语言为Python 3.8.15,GPU加速库为CUDA 11.4。模型训练的迭代次数设置为300,batch size设置为8。采用SGD优化器进行优化,momentum设置为0.937。采用周期性学习率进行调整和Warm-Up方法预热学习率,初始学习率设置为0.01,学习率衰减权重为0.000 5。

2.3 数据集

本文中实验数据来自于上海黄浦江的真实水面船舶视频。参考公共数据集Seaships[20],通过对视频进行分帧处理和人工筛选,得到原始船舶图片共3 824张,以此作为本文中的数据集[21]。本文中数据集命名为HPRship,本数据集中将船舶共分为4大类:散货船(bulk carrier)、客渡轮(passenger ship)、游艇(yacht)、杂货船(general cargo)。本数据集具有以下特点:① 图片背景复杂,干扰性强,包括但不限于近岸建筑;② 图像内船舶目标尺寸差异大,小目标识别难度大;③ 同类船舶之间外观差异大,散货船船型最为复杂。图6展示了数据集部分示例图像。

图6 数据集示例

Fig.6 Dataset example

本文中使用LabelImg软件对建立的船舶数据集进行手动标注,并按照7∶1∶2的比例将数据集划分成训练集、验证集和测试集。LabelImg软件采用矩形框来标注船舶目标,包括对应的图片名、船舶类别、船舶标注框位置等信息,获得PASCAL VOC格式的.xml文件。

3 实验结果及分析

3.1 改进后的YOLOv7模型有效性验证

为验证本文中提出YOLOv7-F算法的有效性,通过实验将其与原始YOLOv7模型进行对比。YOLOv7-F与传统YOLOv7模型使用相同的测试集和验证集,设置一系列相同的参数,如640×640像素,batch_size为8,epochs为100等。出于对模型轻量化和检测准确率的考察,通过计算浮点运算次数、参数量、mAP0.5和mAP0.5∶0.95来进行对比试验。YOLOv7-F与原始YOLOv7模型在HPRship数据集上的检测结果如表1所示。

表1 改进前后算法测试结果

Table1 Test results of improved algorithm before and after

检测网络计算量FLOPs参数量(parameters)精准率(Precision)/%召回率(Recall)/%mAP0.5/%mAP0.5∶0.95/%YOLOv7104.9×10936.5×10694.296.898.174.9YOLOv7-F66.1×10930.8×10698.298.198.882.7

从表1数据可以看出,与传统算法相比,YOLOv7-F模型计算量仅为原来的63%,参数量减少了5.7×106。模型轻量化效果明显,同时YOLOv7-F在船舶数据集上检测精度也有所提高,精准率、召回率、平均精度均值mAP0.5、mAP0.5∶0.95分别提高了4、1.3、0.7、7.8个百分点。YOLOv7-F满足了轻量化要求,也实现了对船舶检测精度的提高。

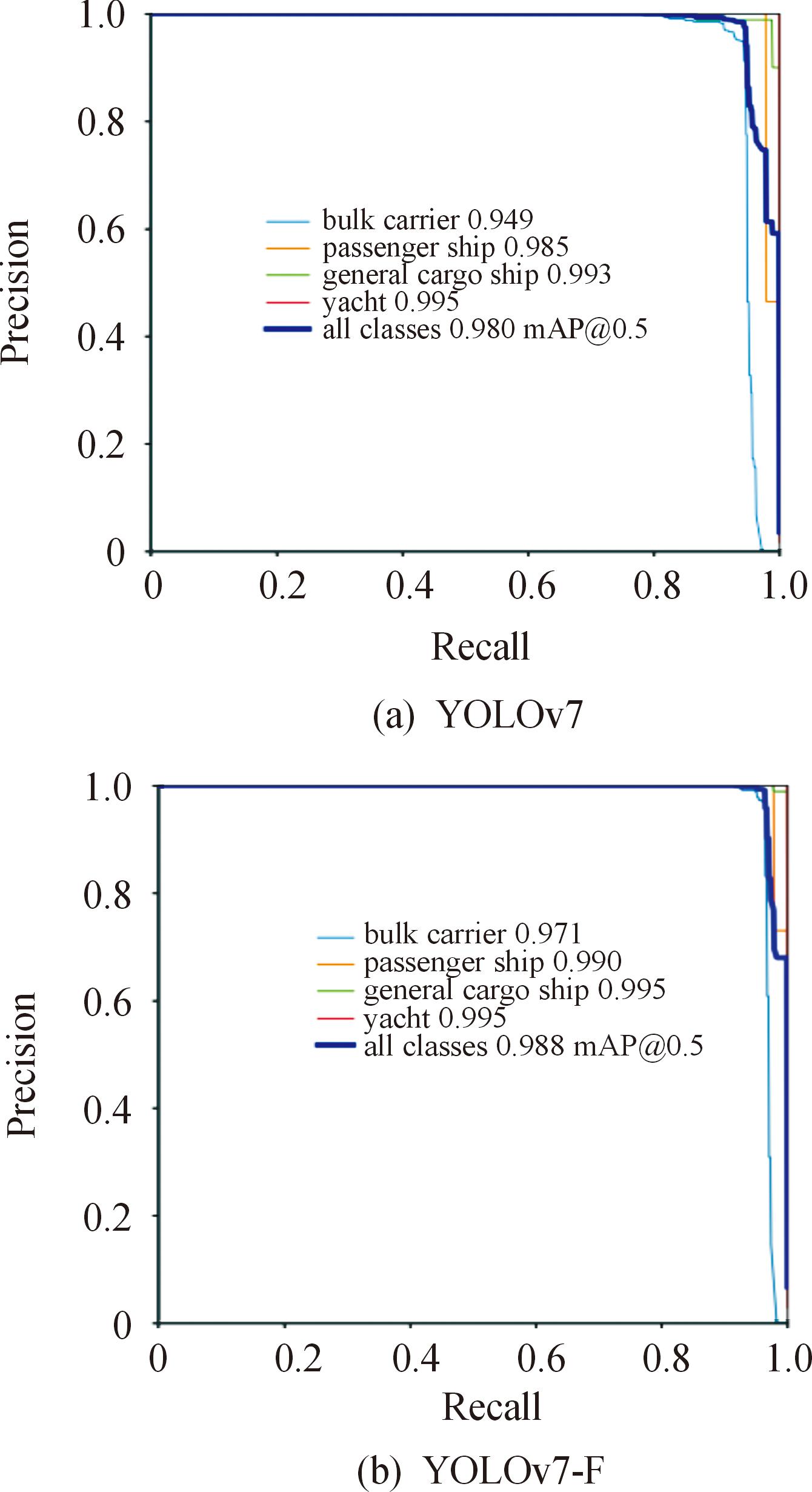

图7为YOLOv7算法改进前后的P-R曲线对比图,P-R曲线可以用来反映模型的性能。改进后的模型YOLOv7-F的P-R曲线与2个坐标轴围住的面积更大,并且它的平衡点更靠近坐标点(1,1),基于这些比较,可以说明改进后的船舶检测模型YOLOv7-F系统性能更好。

图7 P-R曲线

Fig.7 P-R curves

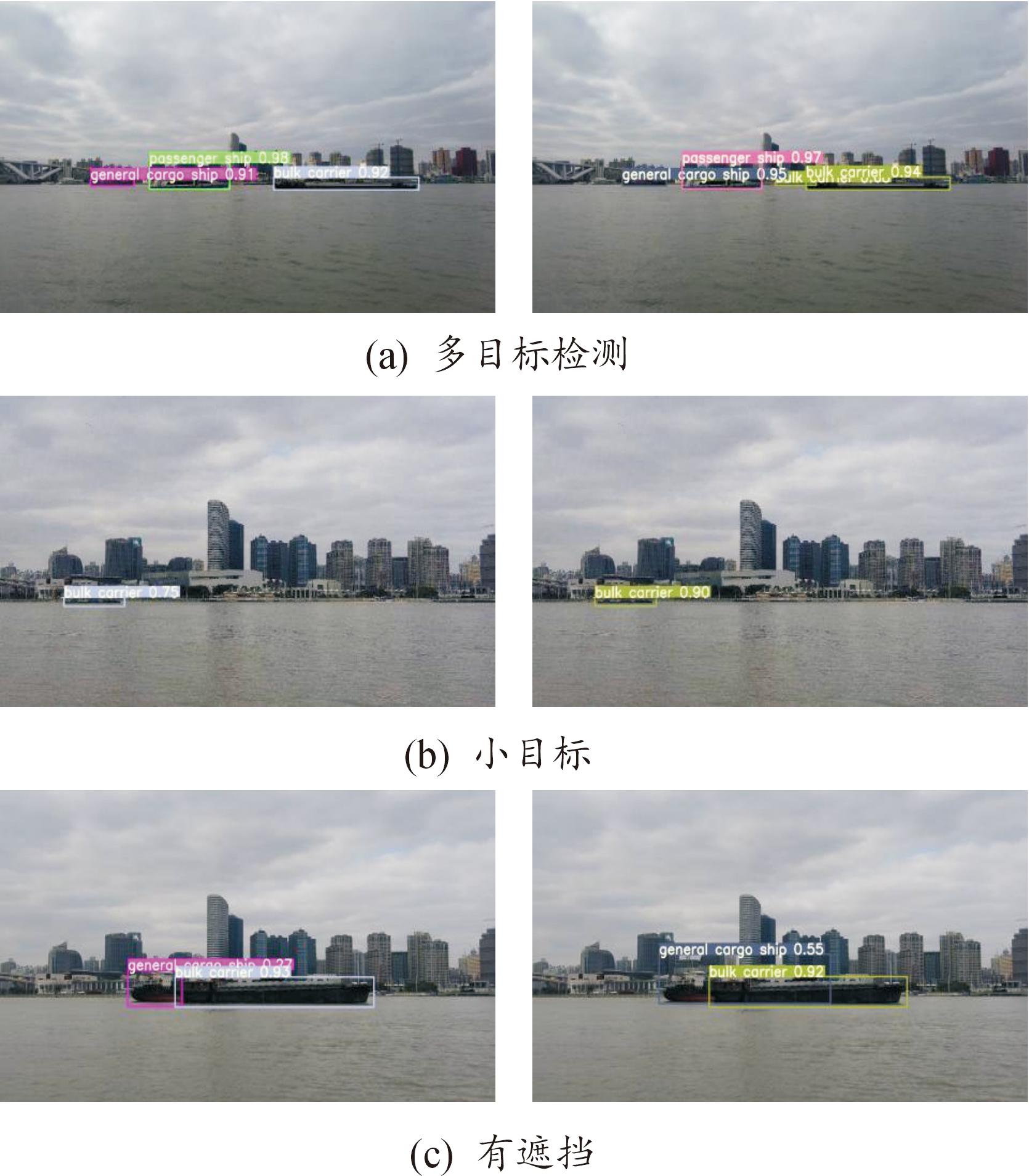

图8是改进前后的YOLOv7模型在不同情况下检验船舶的测试图像,设置IOU阈值为0.5。我们发现,在针对单只无遮挡船舶进行检测时,改进后的船舶检测模型针对船舶单目标时,置信度大大提高了。

图8 改进前后检测结果示意图

Fig.8 Schematic diagram of test results before and after improvement

图8(a)展示了多目标识别的场景,原始检测模型漏检了一艘bulk carrier;改进后的YOLOv7-F检测模型检测到了所有船只,并且具有很高的置信度。图8(b)展示了针对船舶图像中的小目标,改进后的YOLOv7-F模型比原始模型YOLOv7的置信度提高了15%。图8(c)展示了针对船体一部分被遮挡时,YOLOv7-F模型能更好地识别出被遮挡船只的整体,而原始YOLOv7模型只能识别出未被遮挡部分,且置信度较低。

根据图8的结果显示,在不同情况下,本文中的YOLOv7-F模型实现了模型轻量化,保持了较高的检测精度。还在一定程度上,降低了船舶漏检率、误检率。YOLOv7-F模型在船舶数据集上具有更优秀的系统性能。

3.2 消融实验

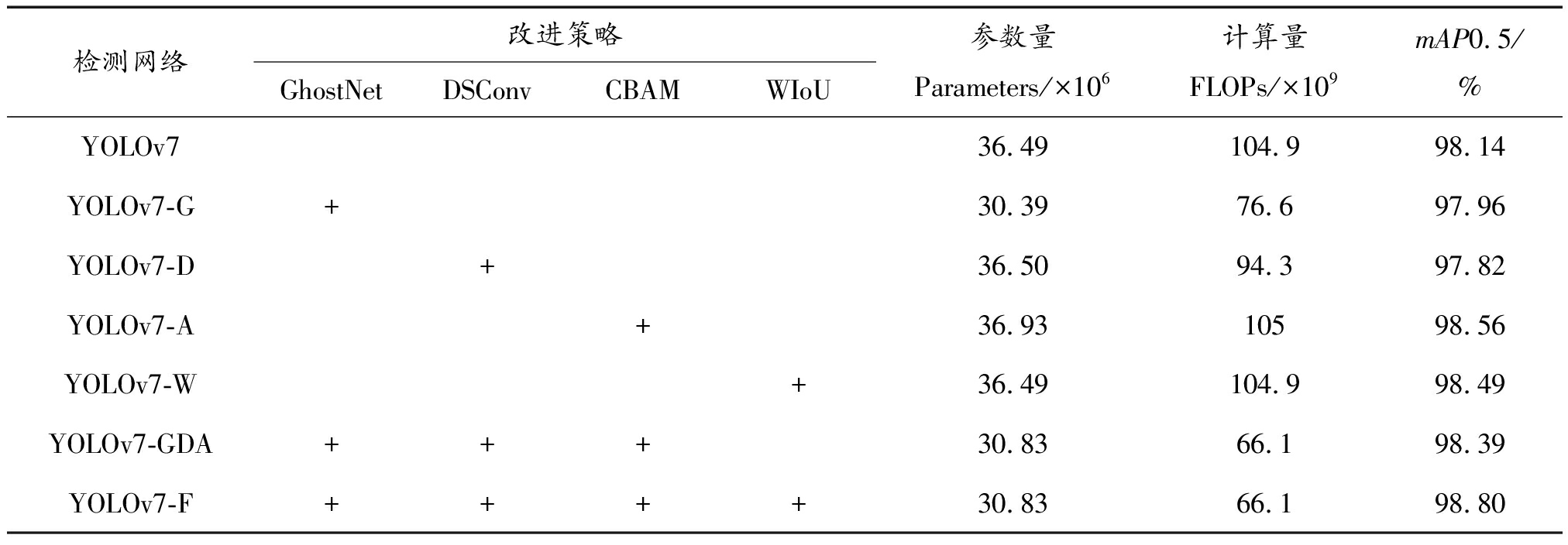

为进一步探究本文中算法YOLOv7-F中各项改进策略对算法整体改进的影响,分别对轻量化操作、特征融合增强操作和损失函数优化进行消融实验。这些实验分别在HPRship数据集上进行网络模型训练,实验中保持设备、实验环境、迭代次数等实验条件相同。选取参数量和计算量来衡量模型大小以及复杂程度,得到的实验结果如表2所示。

表2 不同改进操作有效性实验

Table 2 Effectiveness experiment of different improved operations

检测网络改进策略GhostNetDSConvCBAMWIoU参数量Parameters/×106计算量FLOPs/×109mAP0.5/%YOLOv736.49104.998.14YOLOv7-G+30.3976.697.96YOLOv7-D+36.5094.397.82YOLOv7-A+36.9310598.56YOLOv7-W+36.49104.998.49YOLOv7-GDA+++30.8366.198.39YOLOv7-F++++30.8366.198.80

主干特征提取网络引入GhostNet后的YOLOv7-G模型,较原始YOLOv7模型的参数量减少了6.1×106,FLOPs 减少了28.3×109,平均精度均值下降了0.18%; 在特征融合网络中将普通的3×3卷积,改为分布移位卷积DSConv,得到 YOLO v7-D模型,较原始YOLOv7模型的参数量增加0.01×106,FLOPs减少了10.6×109,平均精度均值下降了0.32%。这说明本文中在特征提取和特征融合部分采取的轻量化操作使模型的参数量和计算复杂度大大降低,达到了模型轻量化的目的,但同时也损害了模型的检测精度。在特征融合网络中引入CBAM注意力机制后的 YOLOv7-A模型,较原始YOLOv7模型的平均精度均值提高了0.42%,参数量增加了0.44×106,计算量增加了0.1×109。可见,引入CBAM能够在牺牲较少参数量和计算复杂度的情况下,有效提高模型的检测精度。在不影响模型大小和计算复杂度的情况下,引入基于动态非单调聚焦机制的边界框损失函数WIoU,模型YOLOv7-W检测精度有效提升0.35%。

总之,上述消融实验结果表明,引入GhostNet和分布移位卷积DSConv之后,牺牲部分精度可以使模型达到轻量化效果,在加入CBAM注意力机制之后,又能够有效弥补精度的亏损,具体如YOLOv7-GDA的实验结果所示。在此基础上,进一步优化损失函数,模型精度可以有效提升,推理效果也更好。最终得到本文中的检测模型YOLOv7-F,该模型既能将模型轻量化,又保证模型的检测精度较高。

4 结论

1) YOLOv7-F引入了GhostNet思想和分布移位卷积操作,实现了模型轻量化,有助于解决传统YOLOv7算法模型存在的计算量大和模型冗杂等问题。

2) YOLOv7-F在模型中增加了注意力机制,弥补了精度损失。并改进了损失函数,在标注质量不均衡的船舶数据集上目标检测性能提升效果更好。模型检测精度mAP0.5达到了98.80%。

3) 在下一步研究工作中,考虑在保证模型检测精度的情况下进一步简化网络,并将其切实部署到水面无人船等资源受限的设备上。

[1] 曹又文,刘庆省,魏自浩,等.基于单目相机的深海微地形地貌高精度三维重建[J].水下无人系统学报,2023,31(4):640-647. CAO Youwen,LIU Qingsheng,WEI Zihao,et al.Based on single-camera deep-sea micro-terrain high-precision 3D reconstruction[J].Journal of Unmanned Undersea Systems,2023,31(4):640-647.

[2] 王硕丰,李昀哲,杜鹏,等.船舶智能航行关键技术应用与展望[J].船舶工程,2024,46(2):30-37. WANG Shuofeng,LI Yunzhe,DU Peng,et al.Applications and prospects of key technologies for intelligent navigation of vessels[J].Ship Engineering,2024,46(2):30-37.

[3] 宋吉广,李德隆,冯亮,等.基于感知信息的USV目标环绕跟踪方法[J].水下无人系统学报,2023,31(5):696-702. SONG Jiguang,LI Delong,FENG Liang,et al.Method for USV target surrounding tracking based on perceptual information[J].Journal of Unmanned Undersea Systems,2023,31(5):696-702.

[4] DEO N,TRIVEDI M M.Convolutional social pooling for vehicle trajectory prediction[C]//Proceedings of the IEEE conference on computer vision and pattern recognition workshops.2018:1468-1476.

[5] PEDRO F F,ROSS B G,DAVID M,et al,Object detection with discriminatively trained part-based models[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2010,32(9):1627-1645.

[6] 王学敏,李文海,张翔宇.基于交叉定位的声纳浮标阵被动检测预处理研究[J].兵器装备工程学报,2023,44(5):192-199. WANG Xuemin,LI Wenhai,ZHANG Xiangyu.Research on passive detection preprocessing of sonobuoy arrays based on cross localization[J].Journal of Ordnance Equipment Engineering,2023,44(5):192-199.

[7] LIU W,ANGUELOV D,ERHAN D,et al.SSD:Single shot multibox detector[C]//Proceedings of the Computer Vision-ECCV 2016:14th European Conference,Amsterdam,The Netherlands,October 11-14,2016,Proceedings,Part I 14.Springer International Publishing,2016:21-37.

[8] 王新宇,翟飞阳,陈子豪,等.基于改进Mask RCNN的散货船压载舱裂缝检测算法[J].船舶工程,2023,45(S1):326-332. WANG Xinyu,ZHAI Feiyang,CHEN Zihao,et al.An algorithm for detecting bulk carrier cargo hold cracks based on improved Mask RCNN[J].Ship Engineering,2023,45(S1):326-332.

[9] LIN Z,JI K,LENG X,et al.Squeeze and excitation rank faster R-CNN for ship detection in SAR images[J].IEEE Geoscience and Remote Sensing Letters,2018,16(5):751-755.

[10] YANG Y,CHEN P,DING K,et al.Object detection of inland waterway ships based on improved SSD model[J].Ships and Offshore Structures,2022,18(8):1-9.

[11] ZHENG J C,SUN S D,ZHAO S J.Fast ship detection based on lightweight YOLOv5 network[J].IET Image Processing,2022,16(6):1585-1593.

[12] LI J,XU C,SU H,et al.Deep learning for SAR ship detection:past,present and future[J].Remote Sensing,2022,14(11):2712.

[13] XING Z,REN J,FAN X,et al.S-DETR:A transformer model for real-time detection of marine ships[J].Journal of Marine Science and Engineering,2023,11(4):696.

[14] 韩泽凯,朱兴华,韩晓军,等.基于卷积神经网络目标跟踪的 AUV回收视觉导引算法[J].水下无人系统学报,2022,30(6):801-808. HAN Zekai,ZHU Xinghua,HAN Xiaojun,et al.An AUV Recovery visual guidance algorithm based on convolutional neural network object tracking[J].Journal of Unmanned Undersea Systems,2022,30(6):801-808.

[15] WANG C Y,BOCHKOVSKIY A,LIAO H Y M.YOLOv7:Trainable bag-of-freebies sets new state-of-the-art for real-time object detectors[C]//Proceedings of the 2023 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR) ,IEEE,2023.

[16] HAN K,WANG Y,TIAN Q,et al.Ghostnet:More features from cheap operations[C]//Proceedings of the IEEE/CVF conference on computer vision and pattern recognition.2020:1580-1589.

[17] NASCIMENTO M G,FAWCETT R,PRISACARIU V A.DSConv:efficient convolution operator[C]//Proceedings of the IEEE/CVF International Conference on Computer Vision.2019:5148-5157.

[18] TONG Z,CHEN Y,XU Z,et al.Wise-IoU:Bounding box regression loss with dynamic focusing mechanism[J].arXiv preprint arXiv:2301.10051,2023.

[19] 张岚,邢博闻,李彩,等.采用改进SSD网络的海参目标检测算法[J].农业工程学报,2022,38(8):297-303. ZHANG Lan,XING Bowen,LI Cai,et al.Sea cucumber target detection algorithm using improved ssd network[J].Transactions of the Chinese Society of Agricultural Engineering,2022,38(8):297-303.

[20] SHAO Z,WU W,WANG Z,et al.Seaships:A large-scale precisely annotated dataset for ship detection[J].IEEE transactions on multimedia,2018,20(10):2593-2604.

[21] XING B,WANG W,QIAN J Y,et al.A lightweight model for real-time monitoring of ships[J].Electronics,Electronics,2023,12:3804.