0 引言

红外船舶检测一直是目标检测任务中的难点问题,红外图像本身色彩纹理特征较少、易受云雾和光线的干扰[1],再得叠加海上船舶目标通常成像距离远、与背景对比度低、容易淹没在海杂波中[2],这导致其对检测网络性能的要求很高,但是红外光相比于可见光具有抗干扰能力强、可以在夜间工作、不易受天气的影响、易于隐蔽的优点[3],因此在军事侦察、民用探测上具有十分重要的应用价值。

目前对于红外船舶目标检测的算法大致分为3类[4-6],一是基于海陆分割的方法,即首先确定海岸线位置来进一步筛选出船舶可能存在的区域,然后对相关区域根据其灰度、梯度等特征完成目标匹配;二是基于显著区域提取的方法,通过边缘提取、计算梯度变化、阈值分割对显著性区域生成特征图,再结合支持向量机、差分滤波、选择性搜索算法完成目标检测;三是基于深度学习的方法,通过构建数据集对卷积神经网络进行训练,不断优化网络结构,结合任务需要,设计相应损失函数,从而提升对目标的检测性能。

当前基于深度学习的方法较少,且对船舶目标的连续检测跟踪效果不佳,在检测精度和实时性上,无法满足现实任务需要,基于上述问题,采用PP-YOLOE算法[7]作为检测头,完成对红外遥感视频中的船舶目标的特征提取,输出目标检测框,再结合ByteTrack算法[8],指定detector权重为训练好的PP-YOLOE算法,进行预测,最终完成对船舶目标的连续跟踪。

1 基于改进PP-YOLOE的红外船舶目标检测算法

目前深度学习的方法以其适用场景广,检测精度高,实时性好的优点成为大家竞相使用方法,本研究中采用的检测网络框架基于PP-YOLOE,是一种单阶段检测算法,相比于其他YOLO系列算法,其引入了先进的无锚框(anchor-free)范式[9],并采用动态标签分配方法[10],以提高检测器的性能,在精度方面显著优于YOLOv5。

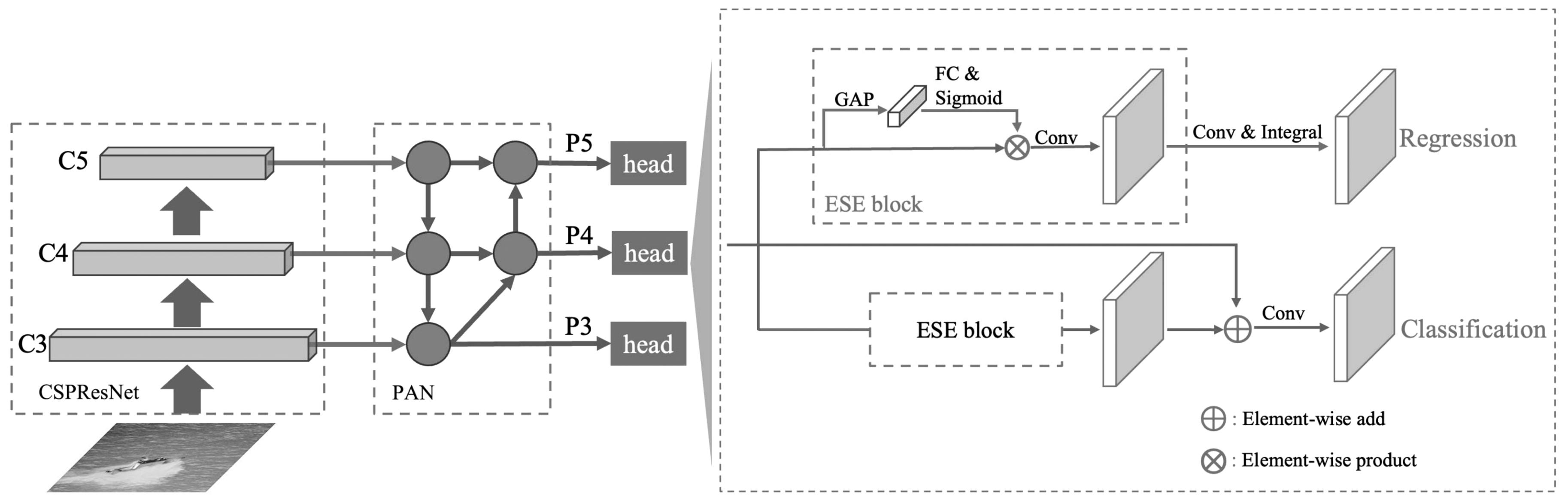

算法性能对比如图1所示。网络主干采用CSPRepResNet,将残差连接与密集连接结合在一起,共包含3个卷积层和由RepResBlock组成的四个阶段,在每个阶段都采用部分连接的方式,来避免3×3个卷积层带来的大量计算负担,在构建网络主干中,ESE(Effective Squeeze and Extraction)层[11]也被用于每个CSPRepResStage来施加通道注意力。算法的框架模型如图2所示。

图1 算法性能对比

Fig.1 Algorithm performance comparison

图2 网络结构框图

Fig.2 Network structure diagram

PP-YOLOE使用SimOTA[12]作为标签分配策略来提高性能,并且为了进一步克服分类和定位的不一致,采用任务对齐学习[13],它由动态标签分配和任务对齐损失组成,动态标签分配意味着预测/损失感知。根据预测,为每个ground-truth分配动态的、正的锚框数量。通过明确调整这2个任务,TAL可以获得最高分类分数和最精确的检测框。对于任务丢失,使用标准化的t,即![]() 来替换loss中的目标,它采用每个实例中最大的IoU进行归一化。该分类的二进制交叉熵(binary cross-entropy,BCE)[14]可以重写为

来替换loss中的目标,它采用每个实例中最大的IoU进行归一化。该分类的二进制交叉熵(binary cross-entropy,BCE)[14]可以重写为

![]()

(1)

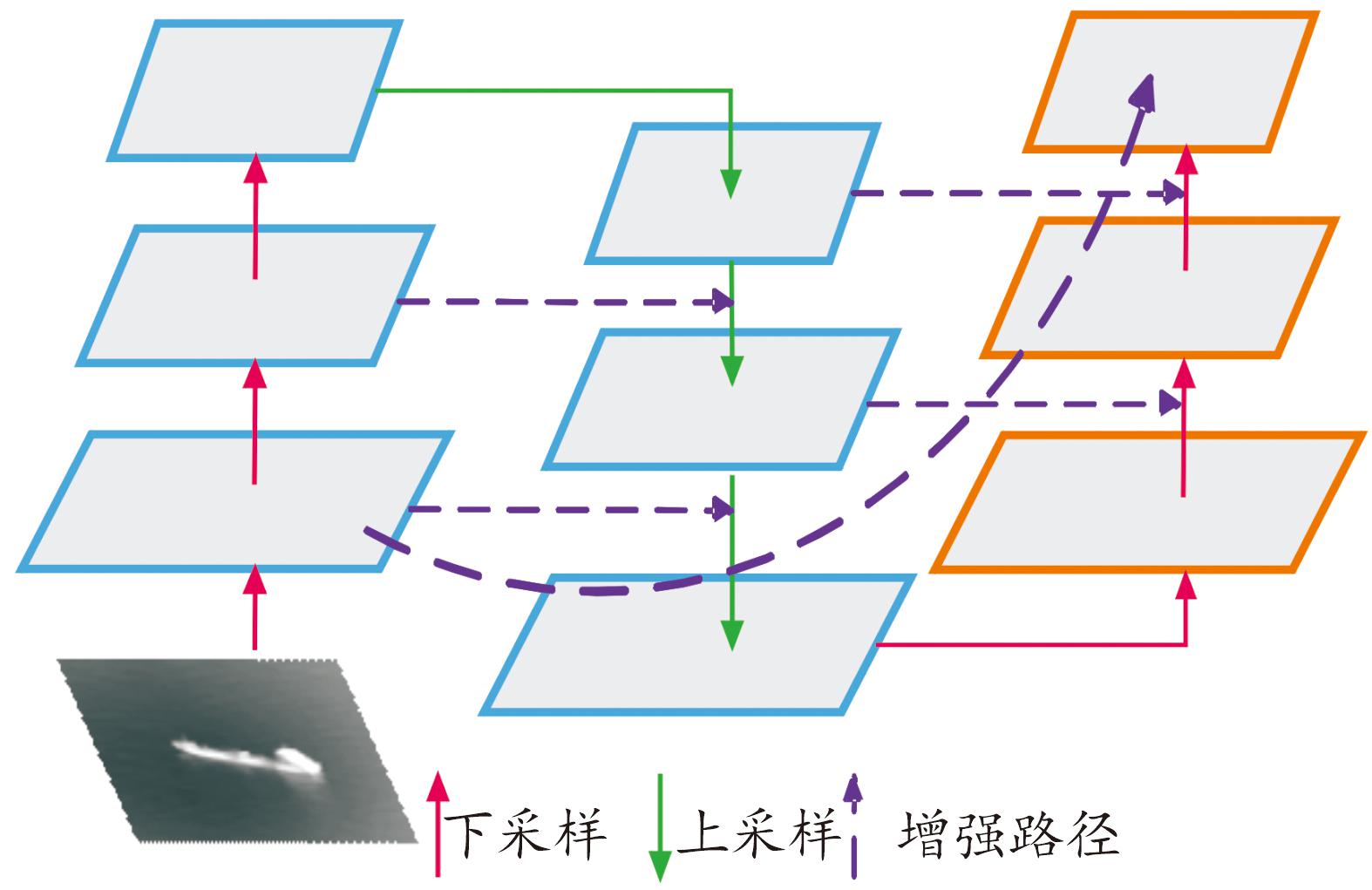

为了提取更加丰富的语义信息特征并与精确定位信息结合,对多维特征的融合处理,对网络的颈部进行相应的改进,除采用传统特征金字塔网络FPN自顶向下进行上采样的模式,还设计了多种融合路径,首先对每个特征图进行ROI对齐操作,提取目标的特征;接下来对元素级特征进行最大融合操作,以使网络适配新的特征,对于相邻的层特征不是简单地叠加到一起,而是采用拼接的方式,从而可以获得更高预测准确度;最后,设计自底向上进行下采样的路径将底层信息与高层信息相融合,设计增强路径采用横向、跨级连接的方式来丰富每个级别的特征信息,缩短最底层到顶层的距离,减少计算量。路径结构如图3所示。

图3 特征融合路径图

Fig.3 Feature fusion path map

针对红外船舶目标多尺度、目标小的问题,对算法的检测头进行改进,提出了速度和准确性目标兼具的ET-head。分别将变焦损失(varifocal loss,VFL)[15]和分类聚焦损失(distribution focal loss,DFL)[16]应用到目标检测器中对分类和定位任务进行学习, 并获得性能改善。VFL使用目标分数对正样本的损失进行加权,使高IoU正样本对损失的贡献相对较大,让模型在训练期间更加关注高质量样本,而非低质量样本。对于DFL,为了解决检测框表示不灵活的问题,使用通用分布预测检测框。最终设计损失函数为

![]()

(2)

式中: α、β、γ为权重因子。

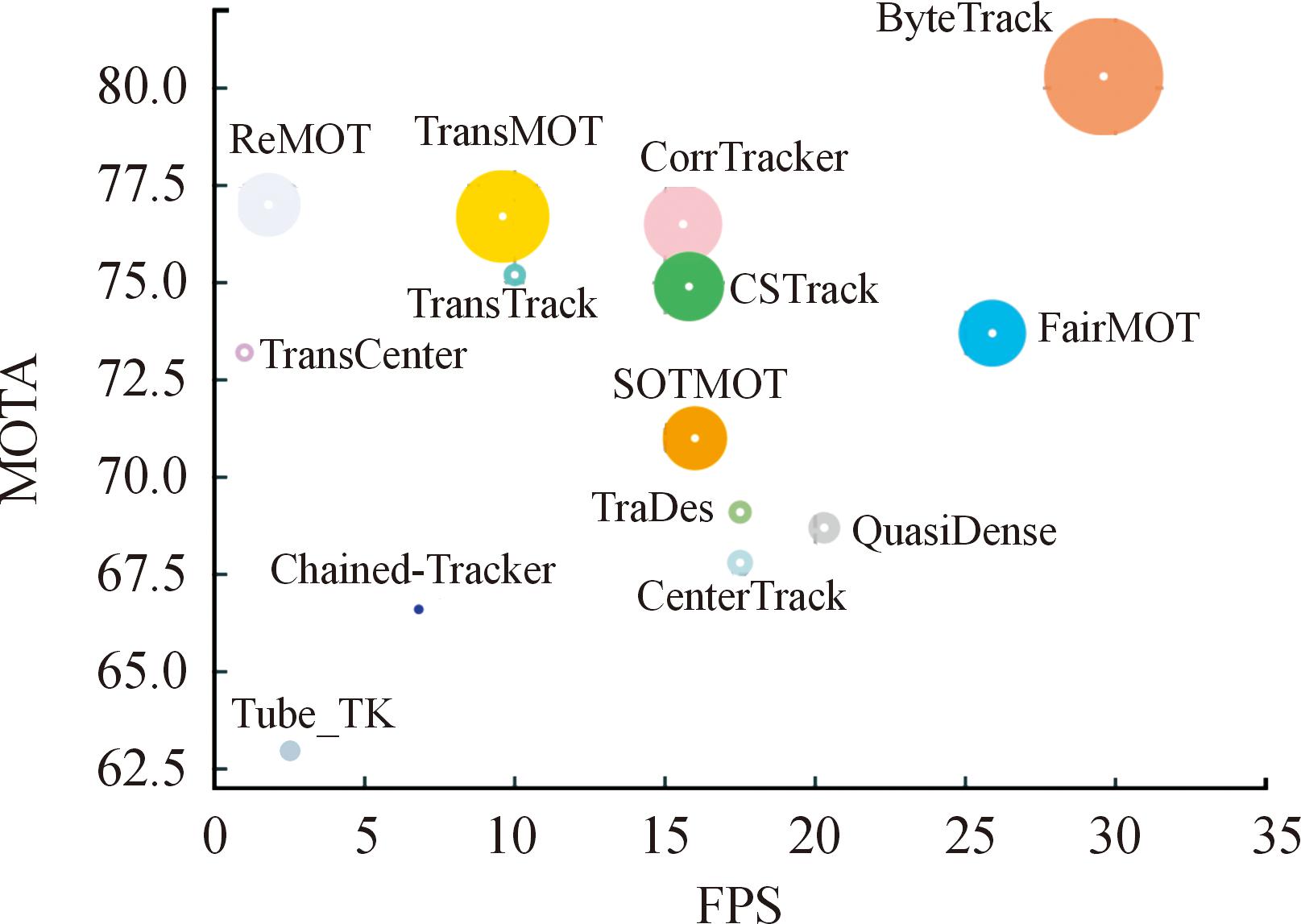

2 基于ByteTrack的船舶目标跟踪算法

ByteTrack是一种基于tracking-by-detection范式的跟踪方法,Tracking-by-detection是MOT中的一个经典高效的流派,通过对目标的位置、外观、运动等相似度信息进行关联来得到跟踪轨迹[17],在传统跟踪算法中,因为视频场景的复杂性,检测器无法得到完美的检测结果,会设置一个阈值以舍弃低于阈值的检测结果,这会导致跟踪过程中出现大量的漏检及轨迹中断的情况,从降低了整体的跟踪效果[18-19],对于这种不合理的情况,提出了一种简单高效的数据关联方法即BYTE。BYTE将高分框和低分框分开处理,利用检测框和跟踪轨迹之间的相似性,在保留高分检测结果的同时,从低分检测结果中去除背景,挖掘出真正的物体(遮挡、模糊等困难样本),从而降低漏检并提高轨迹的连贯性,速度可达到30 FPS。ByteTrack性能与其他跟踪算法比较如图4所示。

图4 算法性能对比

Fig.4 Algorithm performance comparison

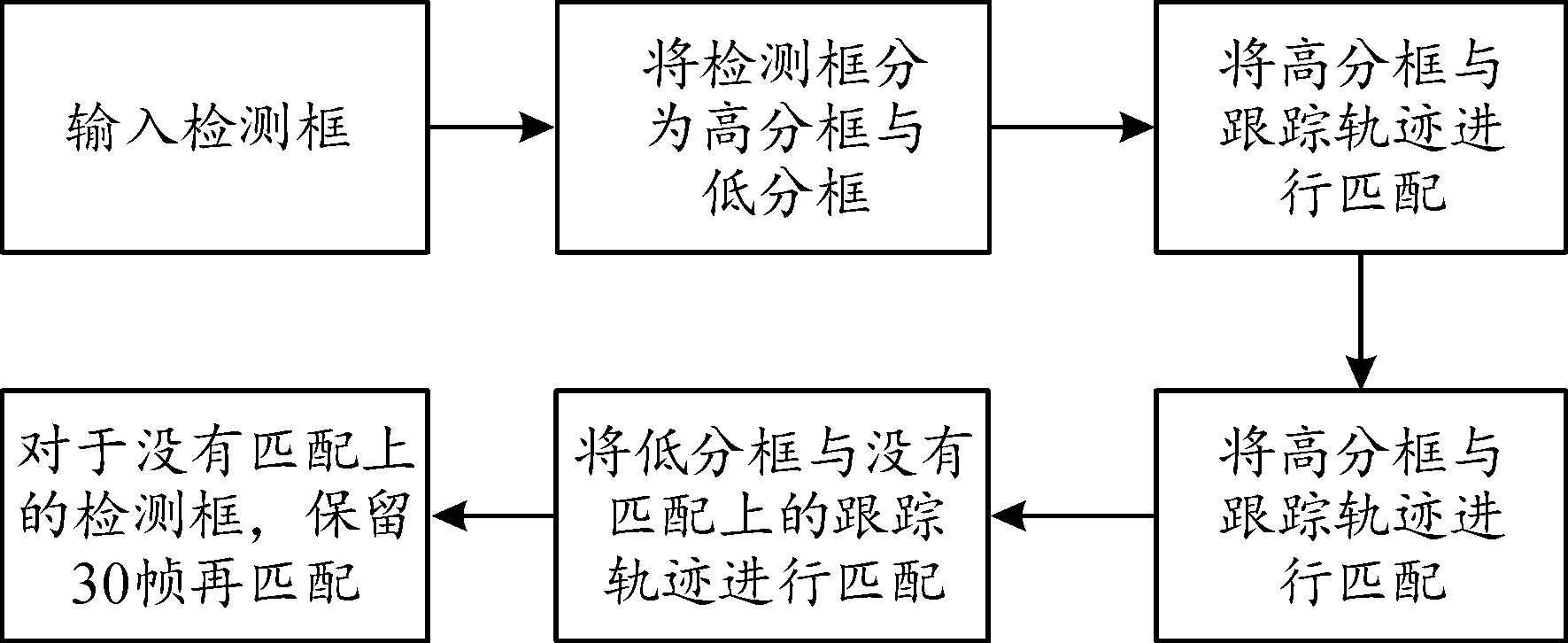

ByteTrack算法的主要思路是通过创建追踪的轨迹,然后利用追踪到的轨迹对每一帧的目标进行匹配,经过逐帧匹配目标后,最终形成完整的轨迹。算法流程如图5所示。

图5 算法流程框图

Fig.5 Algorithm flowchart

ByteTrack在数据关联的过程中,和SORT一样,只使用卡尔曼滤波[20]来预测当前帧的跟踪轨迹在下一帧的位置,预测的框和实际的检测框之间的IoU作为2次匹配时的相似度,通过匈牙利算法[21]完成匹配。对于时间轨迹T在第t帧处的计算为

![]()

(3)

式中: Bt为轨迹T在t帧时的差值框,t1<t<t2。

对于船舶目标的跟踪,需要重点解决的是其被云雾暂时遮挡后,能否连续跟踪不丢失的问题,基于此对ByteTrack算法进行相应的改进。在ByteTrack算法中并没有采用ReID特征[22]来计算外观相似度,仅采用了运动模型,通过卡尔曼滤波就可以保证预测位置的准确性,这样一定程度降低了模型的计算量,可以有效保证跟踪的实时性,但是对于低速的船舶目标而言却并非必要,对于运动不确定性较低的情况,采用马氏距离作为关联度量,是一种十分适合方法,但是此时通过卡尔曼滤波获得的图像空间的运动状态,结果并不理想。尤其是在相机高速的运动时,可能会对图像平面引入快速的位移,进而导致马氏距离在处理遮挡情况下的度量结果,变得非常不准确的,甚至使得关联方法失效,造成ID Switch的现象。

因此,引入了另外一种关联方法,计算每个检测框dj的外观描述符rj来完成度量,并对其限制条件设定为![]() 通过计算检测和轨迹间的特征向量,把它们之间最小的余弦距离,用作检测框外观匹配的程度,但由于轨迹太长会导致外观发生变化,因此对轨迹在Lk=100之内检测框的最小余弦距离进行计算:

通过计算检测和轨迹间的特征向量,把它们之间最小的余弦距离,用作检测框外观匹配的程度,但由于轨迹太长会导致外观发生变化,因此对轨迹在Lk=100之内检测框的最小余弦距离进行计算:

![]()

(4)

算法伪代码:

输入:视频序列V、目标检测器Det、检测评分阈值τ

输出:跟踪视频Τ

1: 初始化:Τ←0

2: for frame fk in V do

3: Dk←Det(fk)

4: Dhigh←0

5: Dlow←0

6: for d in Dk do

7: if d. score>τ then

8: Dhigh←Dhigh∪{d}

9: end

10: else

11: Dlow←Dlow∪{d}

12: end

13: end

14: for t in Τ do

15: t ← KalmanFilter(t)

16: end

17: Associate Τ and Dhigh using Similarity#1

18: Dremain ← remaining object boxes from Dhigh

19: Τremain ← remaining tracks from Τ

20: Associate Τremain and Dlow using similarity#2

21: Τre-remain←remaining tracks from Τremain

22: Τ ← Τ\Τre-remain

23: for d in Dremain do

24: Τ ← Τ∪{d}

25: end

26: end

27: Return: Τ

3 实验验证

3.1 数据准备及实验环境

实验数据集通过操作民用无人机航拍采集的红外船舶视频影像进行制作,首先使用OpenCV工具包将视频分解成一系列的图像帧,并按照设定的时间间隔对视频帧进行提取,在分解视频帧生成图像帧的过程中,根据每个图像帧的帧列序号进行命名,有助于保证整个数据集的顺序和组织,最终共得到红外船舶图像10 402张,随后使用LabelImg工具对训练集样本进行标注,保存为VOC数据格式。图6为所制作的红外船舶数据集部分样本。

图6 自建数据集

Fig.6 Self-built datasets

实验操作系统为Ubuntu 20.04,深度学习框架为Pytorch 1.9.0,开发工具为Visual Studio,硬件环境CPU为Inter(R) Core(R)i7,GPU为NVIDIA(R) GTX(R) 3080。

3.2 消融实验

为验证无锚框设计、改进网络主干、任务对齐学习以及强化Head对模型检测性能的提升,共设计了4组消融实验进行对比,实验在公开数据集MS COCO-2017上进行测试,该数据集共包括80类和118 K张图像,从其中随机挑选出5 000张图像,实验结果如表1所示。

表1 消融实验结果对比

Table 1 Ablation experimental results

ModelmAP/%ParametersGFLOPsLatency/msFPSBaseline Model48.354.58115.7714.370.3+Anchor-free48.0(-0.3)53.68114.7814.170.2+CSPResNet48.7(+0.7)47.63101.8711.985.6+TAL49.6(+0.9)48.42104.7512.284.1+ET-head50.1(+0.5)52.31110.0713.178.3

从结果中可以看出,引入不同模块在不同程度上提升了网络的检测精度和实时性,采用无锚框范式可以有效降低模型的参数量和时延,改进网络主干可以提升检测精度和速度,采用任务对齐学习可以大幅提升检测精度,强化检测头虽然一定程度上增加了模型的参数量,但是对于特定场景下的目标检测具有重要意义,最终整个网络模型的mAP整体提升了1.8%,每秒十万亿次浮点运算次数降低了5.7,每秒处理的帧数提升了8.0,同时降低了模型的参数量和时延,参数量降低了2.27,时延降低了1.2 ms,对网络整体性能的提升起到了很好的效果。

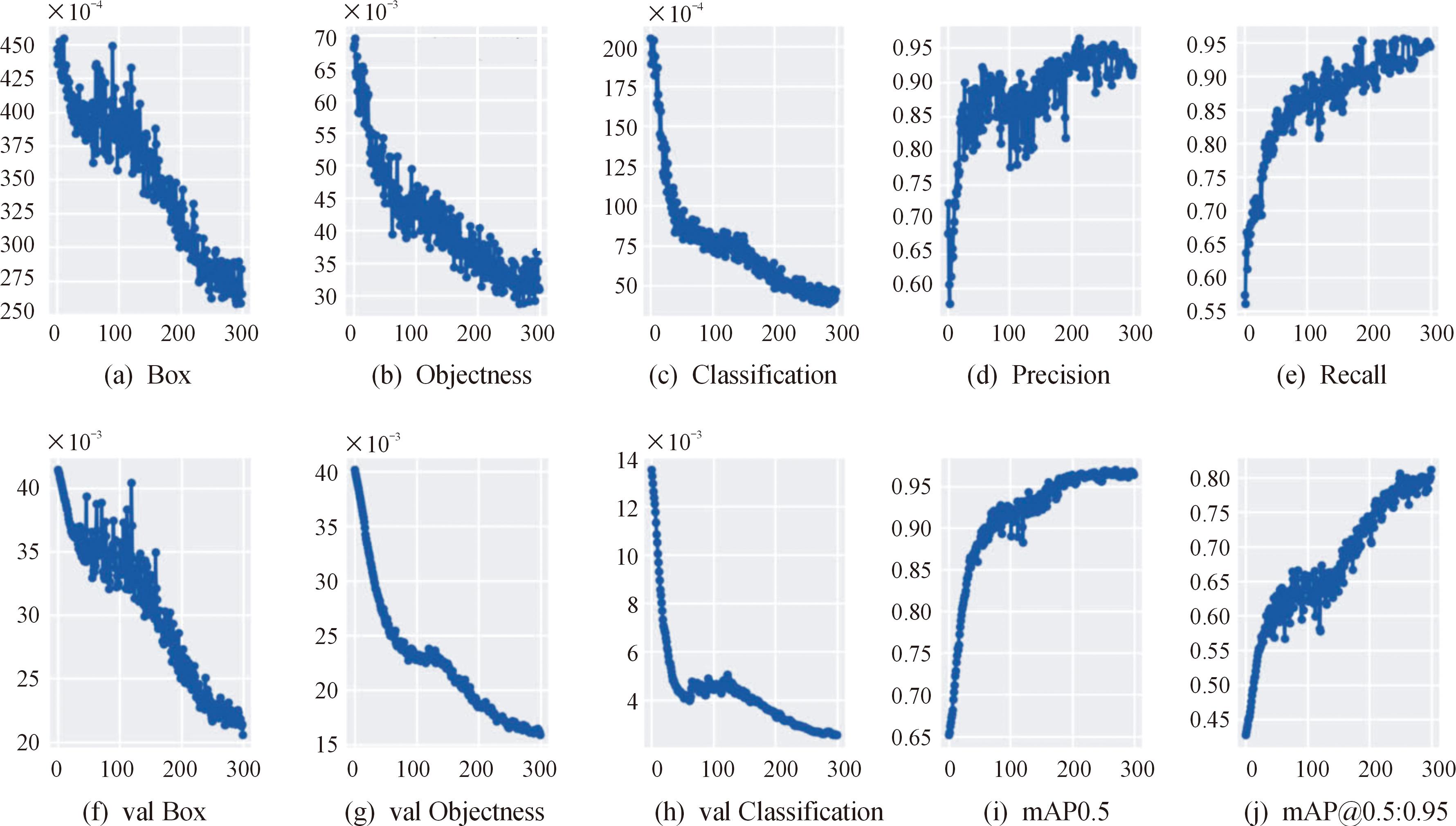

3.3 网络训练

使用自建红外船舶数据集对网络模型进行训练,修改配置文件参数为epoch=300,学习率为0.001,batch_size=4,置信度阈值为0.5,stride=32。最后经训练集训练,测试集验证后,所得结果如图7所示。从结果中可以看出,网络模型经本数据集训练后,效果较好,整体损失值较少,未出现过拟合现象,收敛速度快,波动小,检测精度高。

图7 网络训练结果

Fig.7 Network training results

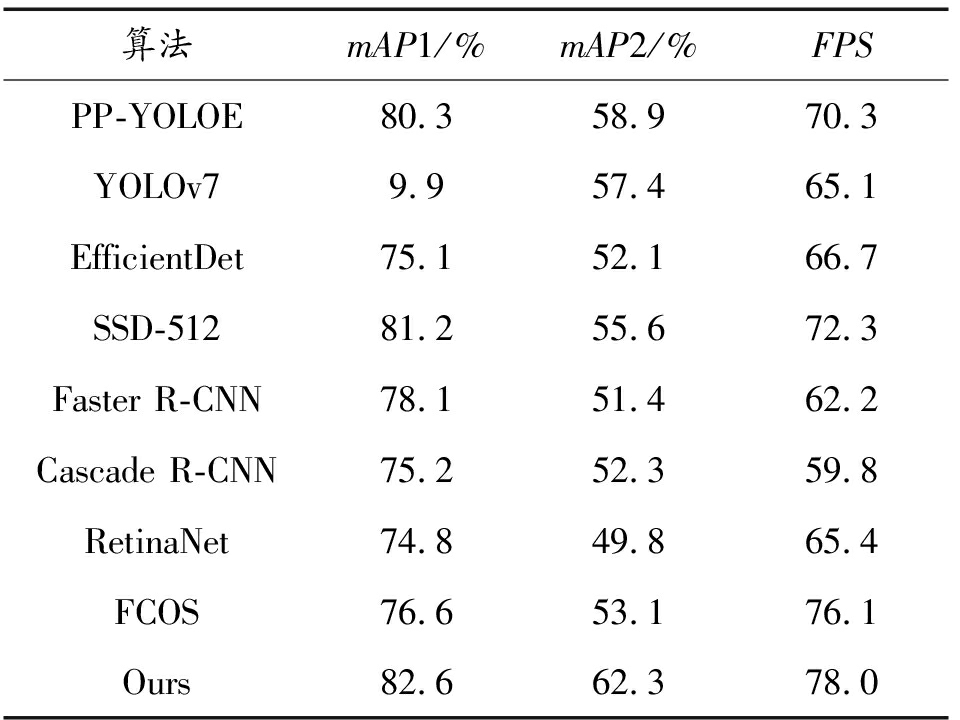

为客观评价改进模型后对算法性能的整体提升,除与原网络进行比较外,还与YOLOv7、EfficientDet、SSD-512等当前最新检测模型进行对比,使用自建数据集,并将其分成2部分,数据集1为简单离岸场景,数据集2为复杂近岸场景,采用随机抽取的方式划定训练集和测试集,并将训练测试比设定为8∶2,结果如表2所示,本算法在近岸场景和离岸场景下的mAP分别可达82.65%和62.3%,FPS可达78.0,可以看出对模型结构的改进以及引入任务对齐学习方法,相比于原算法,对网络的性能有明显提升,算法的准确度和实时性都优于其他算法。

表2 算法性能对比

Table 2 Algorithm performance comparison

算法mAP1/%mAP2/%FPSPP-YOLOE80.358.970.3YOLOv79.957.465.1EfficientDet75.152.166.7SSD-51281.255.672.3Faster R-CNN78.151.462.2Cascade R-CNN75.252.359.8RetinaNet74.849.865.4FCOS76.653.176.1Ours82.662.378.0

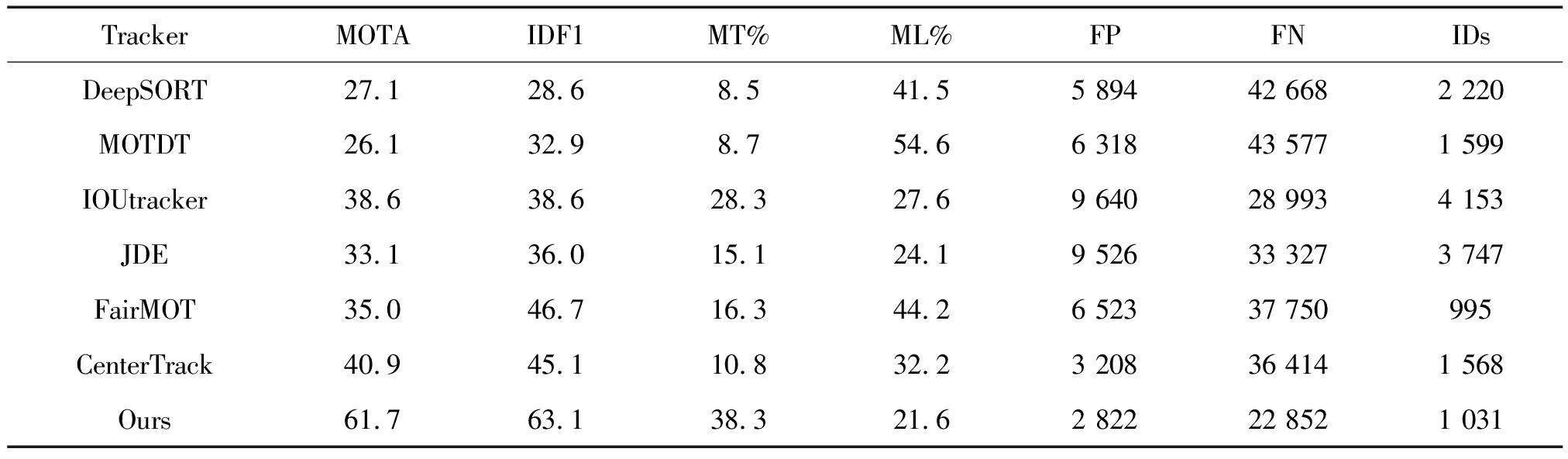

3.4 跟踪结果比较

将ByteTrack同其他流行跟踪算法在红外船舶视频中进行性能比较,所用评价指标包括:MOTA、IDF1、MT、ML、FP、IDs等,其中MOTA用来评价检测性能,IDF1用来评估身份保存能力及关联性能,如表3所示。从结果可以看出,所用方法对于处理红外船舶跟踪过程中多目标遮挡的情况,效果优于其他方法,并且关联性能好,实时性高。

表3 跟踪性能对比

Table 3 Track performance comparisons

TrackerMOTAIDF1MT%ML%FPFNIDsDeepSORT27.128.68.541.55 89442 6682 220MOTDT26.132.98.754.66 31843 5771 599IOUtracker38.638.628.327.69 64028 9934 153JDE33.136.015.124.19 52633 3273 747FairMOT35.046.716.344.26 52337 750995CenterTrack40.945.110.832.23 20836 4141 568Ours61.763.138.321.62 82222 8521 031

3.5 可视化结果

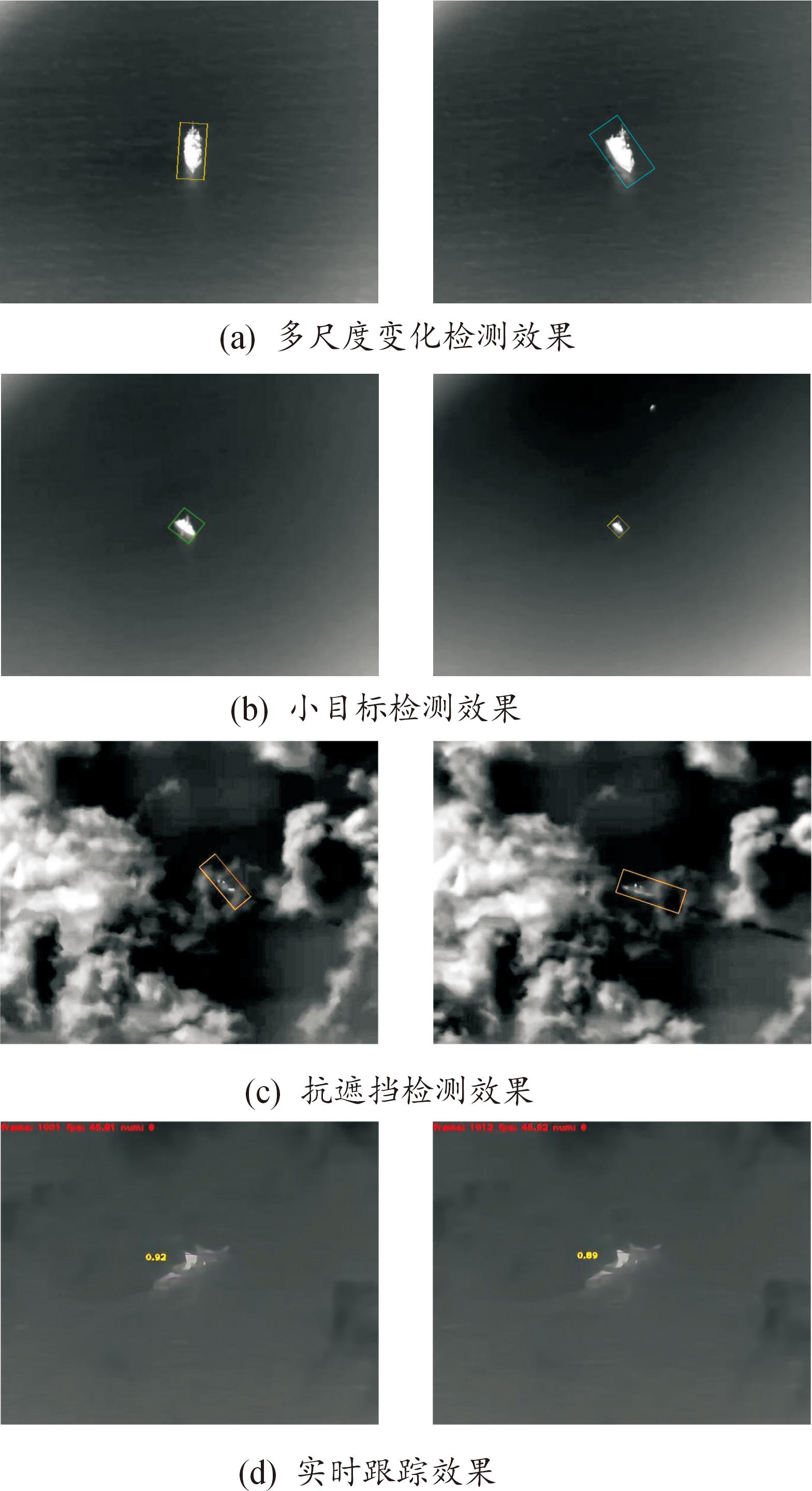

选取部分困难案例的可视化结果,如图8所示。其中,图8(a)为无人机拍摄民用拖船目标航行过程中转变方向的场景,整个船体连续的方向变化可以验证网络对目标多尺度的检测性能;图8(b)是拍摄拖船逐渐远离视野的过程,目标不断变小,可以验证网络对小目标的检测性能;图8(c)是拍摄拖船在有云雾干扰下的场景,可以验证网络对有遮挡目标的检测性能;图8(d)是对视频中的船舶目标进行连续跟踪,可以对实时性进行验证。

图8 可视化结果

Fig.8 Result of the visualization

最终,从检测结果上可以看出本算法对红外船舶多尺度变化、小目标、受遮挡的检测效果较好,跟踪的FPS平均可以达到45.7以上,能够很好满足现实任务的需要。

4 结论

1) 为提升网络对多尺度、小目标的检测性能,改进了PP-YOLOE的网路主干和颈部,使用多路径采样进行特征融合,并强化检测头,使得网络对红外船舶目标的检测性能得到了有效提升,但是同样在一定程度了增加了模型的大小。

2) 为加强对遮挡目标的连续跟踪能力,改进了ByteTrack算法,通过引入匈牙利算法完成目标与轨迹的匹配,使用卡尔曼滤波进行预测后,再采用ReID特征来计算外观相似度,已达到对红外船舶目标连续跟踪目的,但是以同样在一定程度上影响到实时性,然而对于通常是低速航行的船舶而言并不紧要。

[1] 陈钱.红外图像处理技术现状及发展趋势[J].红外技术,2013,35(6):311-318. CHEN Qian.Current situation and development trend of infrared image processing technology[J].Infrared Technology,2013,35(6):311-318.

[2] TANG D,SUN G,WANG D,et al.Research on infrared ship detection method in sea-sky background[C]//International Symposium on Photoelectronic Detection and Imaging 2013:Infrared Imaging and Applications.SPIE,2013,8907:600-609.

[3] 李永松.复杂海面背景下红外目标检测技术研究[D].重庆:重庆大学,2021. LI Yongsong.Research on infrared target detection technology under complex sea surface background[D].Chongqing:Chongqing University,2021.

[4] 顾佼佼,李炳臻,刘克,等.基于改进Faster R-CNN的红外舰船目标检测算法[J].红外技术,2021(6):143-146. GU Lingling,LI Bingzhen,LIU Ke,et al.Infrared ship target detection algorithm based on improved Faster R-CNN[J].Infrared Technology,2021(6):143-146.

[5] 谢晓方,刘厚君,张龙杰,等.融合轻量级YOLOv4与KCF算法的红外舰船目标识别[J].兵器装备工程学报,2021,42(6):175-182. XIE Xiaofang,LIU Houjun,ZHANG Longjie,et al.Infrared ship target recognition based on lightweight YOLOv4 and KCF algorithm[J].Journal of Ordnance Equipment Engineering,2021,42(6):175-182.

[6] JIANG B,MA X,LU Y,et al.Ship detection in spaceborne infrared images based on convolutional neural networks and synthetic targets[J].Infrared Physics &Technology,2019,97:229-234.

[7] ZHANG Yang,LIU Xiaofang,GUO Jun,et al.Surface defect detection of strip-steel based on an improved PP-YOLOE-m detection network[J].Electronics,2022,11(16):2603.

[8] ZHANG Yifu,SUN Peize,JIANG Yi,et al.ByteTrack:Multi-object tracking by associating every detection box[C]//European Conference on Computer Vision.Cham:Springer Nature Switzerland,2022:1-21.

[9] TIAN Z,SHEN C,CHEN H,et al.FCOS:A simple and strong anchor-free object detector[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2020,44(4):1922-1933.

[10] ZHANG YANCHAO,ZHANG WENBO,YU JIYA,et al.Complete and accurate holly fruits counting using YOLOX object detection[J].Computers and Electronics in Agriculture,2022,198:107062.

[11] KONG T,SUN F,LIU H,et al.Foveabox:Beyound anchor-based object detection[J].IEEE Transactions on Image Processing,2020,29:7389-7398.

[12] WANG C Y,LIAO H Y M,WU Y H,et al.CSPNet:A new backbone that can enhance learning capability of CNN[C]//Proceedings of the IEEE/CVF conference on computer vision and pattern recognition workshops.[S.l.]:[s.n.],2020:17:390-391.

[13] JU C,GUAN C.Tensor-cspnet:A novel geometric deep learning framework for motor imagery classification[J].IEEE Transactions on Neural Networks and Learning Systems,2022,24:1548-1557.

[14] SONG G,LIU Y,WANG X.Revisiting the sibling head in object detector[C]//Proceedings of the IEEE/CVF conference on computer vision and pattern recognition.[S.l.]:[s.n.],2020:11563-11572.

[15] FU A,ZHANG X,N,et al.VFL:A verifiable federated learning with privacy-preserving for big data in industrial IoT[J].IEEE Transactions on Industrial Informatics,2020,18(5):3316-3326.

[16] WANG Z,LIU H,XU S,et al.A diffraction measurement model and particle filter tracking method for RSS-based DFL[J].IEEE Journal on Selected Areas in Communications,2015,33(11):2391-2403.

[17] LEON F,GAVRI M.A review of tracking and trajectory prediction methods for autonomous driving[J].Mathematics,2021,9(6):660.

[18] SHI J,SUN D,QIN D,et al.Planning the trajectory of an autonomous wheel loader and tracking its trajectory via adaptive model predictive control[J].Robotics and Autonomous Systems,2020,131:103570.

[19] LI X,WANG W,WU L,et al.Generalized focal loss:Learning qualified and distributed bounding boxes for dense object detection[J].Advances in Neural Information Processing Systems,2020,33:21002-21012.

[20] FANG Y,HUANG Z,PU J,et al.AUV position tracking and trajectory control based on fast-deployed deep reinforcement learning method[J].Ocean Engineering,2022,245:110452.

[21] WAN X,ZHOU S,WANG J,et al.Multiple object tracking by trajectory map regression with temporal priors embedding[C]//Proceedings of the 29th ACM international conference on multimedia.[S.l.]:[s.n.],2021,578:1377-1386.

[22] LOBBTO D J,VLOET T P,HOUT W B,et al.Feasibility,safety,and outcomes of a stratified fast-track care trajectory in pituitary surgery[J].Endocrine,2020,69:175-187.