0 引言

对于区域性的地表未爆子弹药检测定位,常用的方法是采用人工或车载平台进行地面平推式搜索[1-3],然而该方法不但检测速度慢,且对作业人员的生命安全也存在较大风险。而最安全最快速的检测方式,是使用搭载光学探测器的无人机载荷平台,对射击后的区域进行非接触式飞行扫描,从而获得地表未爆子弹药在二维地图中的图像信息。通常情况下,搜寻地表未爆子弹药的区域面积非常大,为实现快速扫描检测,一般要求无人机要在一定高度的空中飞行,使其搭载的光学探测器对地面进行扫描成像,而扫描过程中得到的目标图像一般都比较小,甚至只有几个像素,难以分辨出目标的轮廓和性质,更难以区分是否是噪声干扰,给目标的特征提取和检测带来很大的难度。试验发现,使用视场角为94°的大视场角可见光探测器,飞行高度约100 m,飞行速度约11.4 m/s,扫描1.7 km2的面积需要约60 min,通过扫描构建的二维重建地图中未爆子弹药所占像素面积约为2×2;如果将飞行高度降至50 m,飞行速度保持不变,扫描相同的面积需要约110 min,未爆子弹药所占像素面积约为3×3。此时,目标在图像中的像素信息不足,无法检测出未爆子弹药。如果将无人机载荷平台的飞行高度降到3 m,未爆子弹药在二维地图中的像素面积增大到7×21,显然此时目标在图像中变得完整且清晰,但完成区域扫描的时间将大大延长,不但极大地降低了目标检测效率,而且无人机载荷平台自身搭载的电池电量难以维继,与此同时也增加了无人机载荷平台的使用保障要求。

1 基于SIFT算法的同源图像检测

随着计算机算力的升级加速和算法的迭代更新,基于数字图像处理技术的目标检测效率越来越高,也为小目标检测奠定了技术基础。目前,基于尺度空间理论的图像配准算法因其具有强大的尺度不变性和稳定性,且受光照强度影响较小,而广泛应用于解决小目标检测的问题。廖逍等[4]针对无人机对电网巡检过程中移动镜头下的目标检测问题,利用SIFT算法完成特征点提取和匹配,能够准确检测运动目标;蒙晓宇等[5]采用SIFT算法检测目标图像和彩色背景图像的特征点并进行匹配,以此实现消除图像抖动的目的,提高了目标检测的准确率。因此,使用SIFT算法用于地表未爆子弹药图像特征点提取及配准,可以获得未爆子弹药在图像中的信息。

1.1 SIFT算法的基本原理

SIFT[6]是计算机视觉领域中检测和描述图像中局部特征的算法,由于其在处理图像过程中具有尺度不变性,主要用于局部特征的提取检测,同时这些特征对于亮度变化具有很强的鲁棒性,对于噪声和视角的微小变化也能保持一定的稳定性。该算法在目标识别、自动导航、图像拼接、三维建模、手势识别、视频跟踪等领域均有较好应用[7]。一般可将SIFT算法检测过程区分为检测极值、定位特征点、确定方向角度和生成特征点描述符等4个阶段。

1) 检测极值。特征提取的第1步是能够检测目标的位置和尺度,对于同一个目标在不同的视角下的位置和尺度可以被重复分配,主要是利用尺度空间的连续尺度函数[8]搜索所有尺度上的稳定特征,以检测目标的位置。图像的尺度空间表达式可被定义为

L(x,y,σ)=G(x,y,σ)⊗I(x,y)

(1)

式(1)中:⊗表示在x和y两个方向上进行卷积操作,而G(x,y,σ)为

![]()

(2)

式(2)中:σ是尺度空间因子,它决定着图像模糊平滑处理的程度,(x,y)则表示在σ尺度下的图像像素坐标。

利用高斯拉普拉斯方法(laplacian of gaussian,LoG)[9]能够在不同的尺度下检测到图像的斑点特征,从而可以确定图像的特征点。特征点检测算子表达式为

D(x,y,σ)=(G(x,y,kσ)-G(x,y,σ))⊗I(x,y)=

L(x,y,kσ)-L(x,y,σ)

(3)

式(3)中:k是一个常量。

2) 定位特征点。特征点是一个三维矢量,它包括尺度和尺度图像坐标,即X=(x,y,σ)T,因此可使用三维函数的泰勒级数展开式,并舍去二阶以上的高阶项,其表达式为

![]()

(4)

式(4)中:X0表示离散空间下的插值中心(在离散空间内也就是采样点)坐标,X表示拟合后连续空间下的插值点坐标。

3) 确定方向角度。为了实现图像的旋转不变性,特征点矢量还需要确定其方向角度,也就是根据检测到的特征点所在高斯尺度图像的局部结构求得一个方向基准[10]。

像素梯度的幅值和幅角的计算公式为

![]()

(5)

![]()

(6)

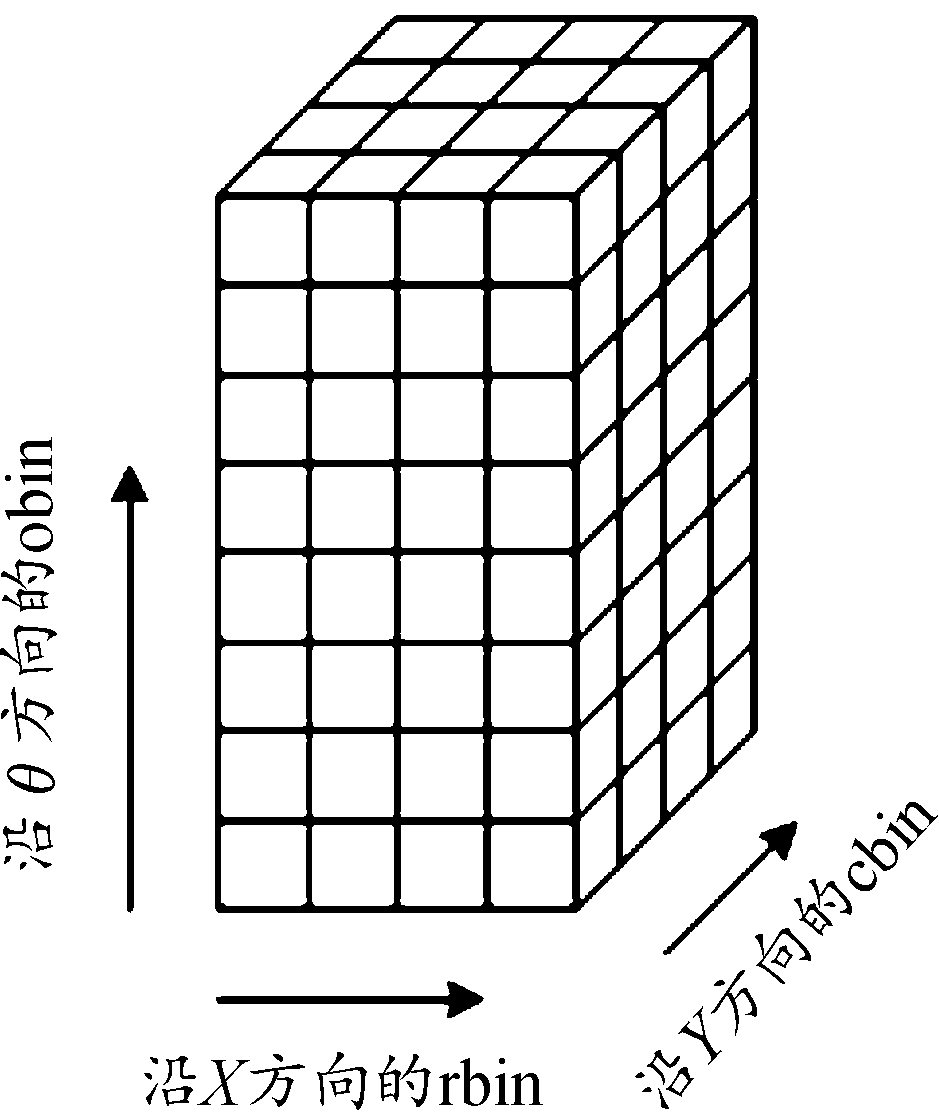

4) 生成特征向量。特征向量与特征点的尺度有关,在高斯尺度图像中,三维直方图是一个立方体(如图1所示),立方体的底就是特征点邻域区域,该区域被分为4×4个子区域,即16个子区域,立方体的三维直方图的高为邻域像素幅角的大小,把360°的幅角进行8等分,每一个等份为45°,则该直方图一共有4×4×8=128个小正方体组成。而这个三维直方图的值则是正方体内所有邻域像素的高斯加权后的梯度幅值之和,所以一共有128个值,而这128个数写成一个128维的矢量,则该矢量就是该特征点的特征向量[11]。

图1 描述符的三维直方图[12]

Fig.1 Three-dimensional histogram of descriptor

1.2 基于SIFT的地表未爆子弹药检测试验

为了验证基于SIFT的可见光同源图像配准检测在大面积区域检测地表未爆子弹药的效果,进行试验验证,试验条件如下:使用M300六旋翼无人机作为无人机载荷平台,飞行高度50 m,搭载H20T可见光探测器,使用大疆智图、图像交叉匹配程序构建二维地图。

对于同源图像,使用基于SIFT的特征匹配方法,完成图像配准,在此基础上,对2幅图像进行差值运算检测疑似目标区域。

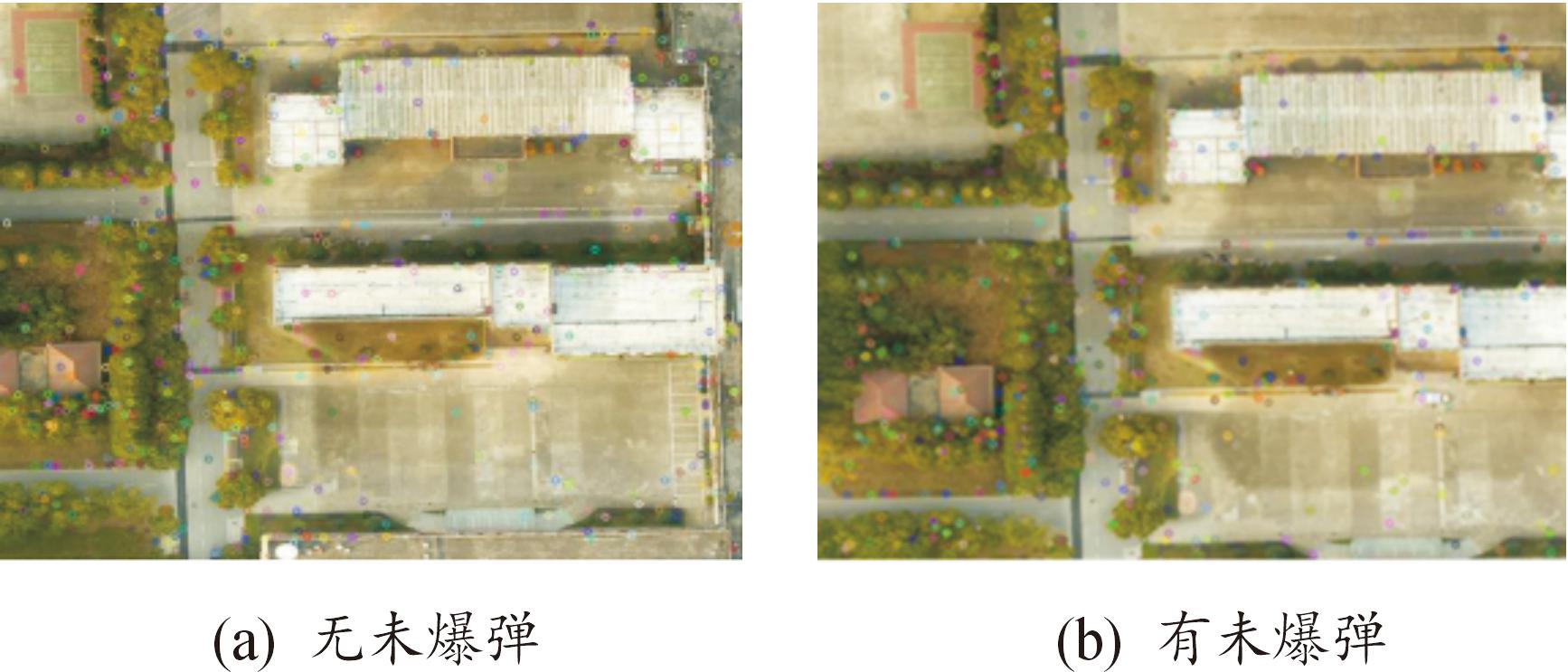

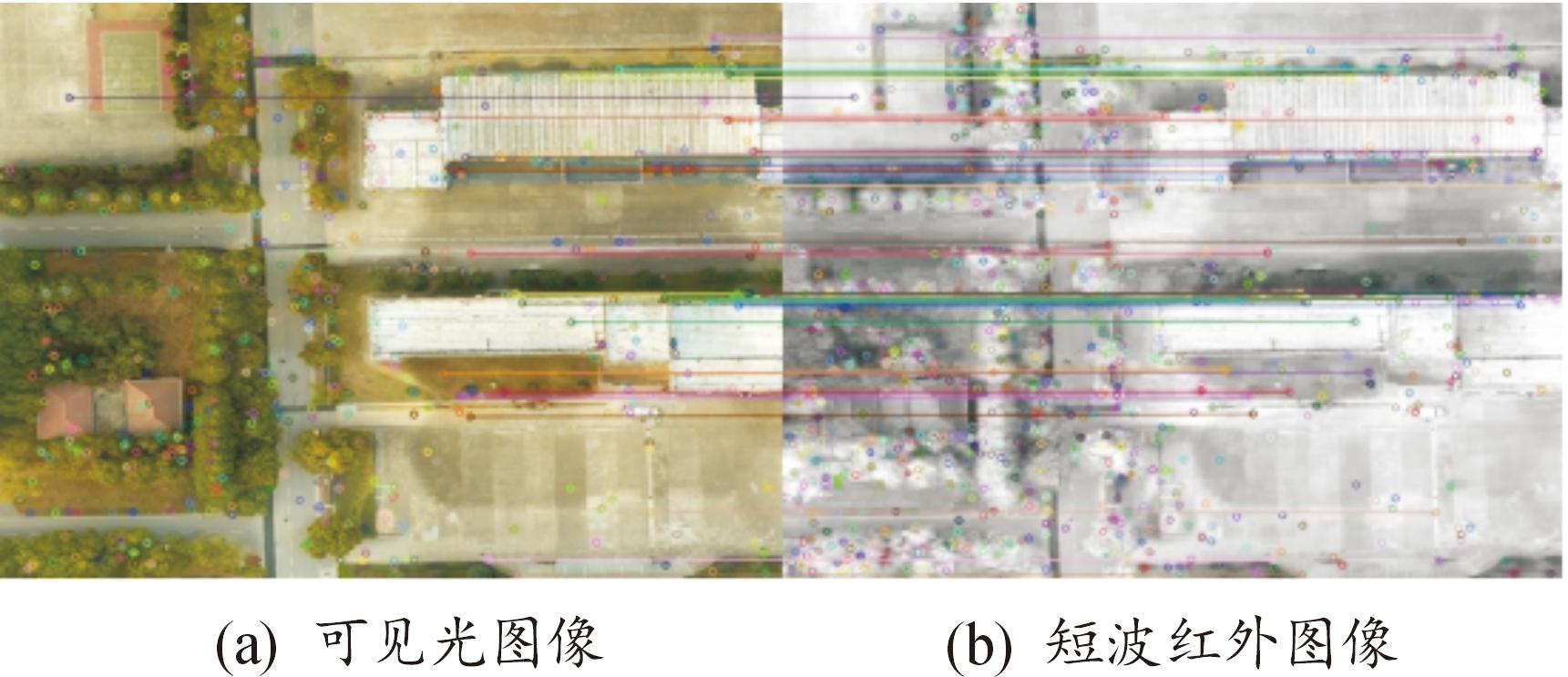

1) 在同一高度下,扫描放置未爆子弹药前后的区域,重建出2幅二维地图,并进行特征点提取,如图2所示。

图2 50 m二维地图重建图像特征点提取图

Fig.2 50 m two-dimensional map reconstruction image feature point extraction map

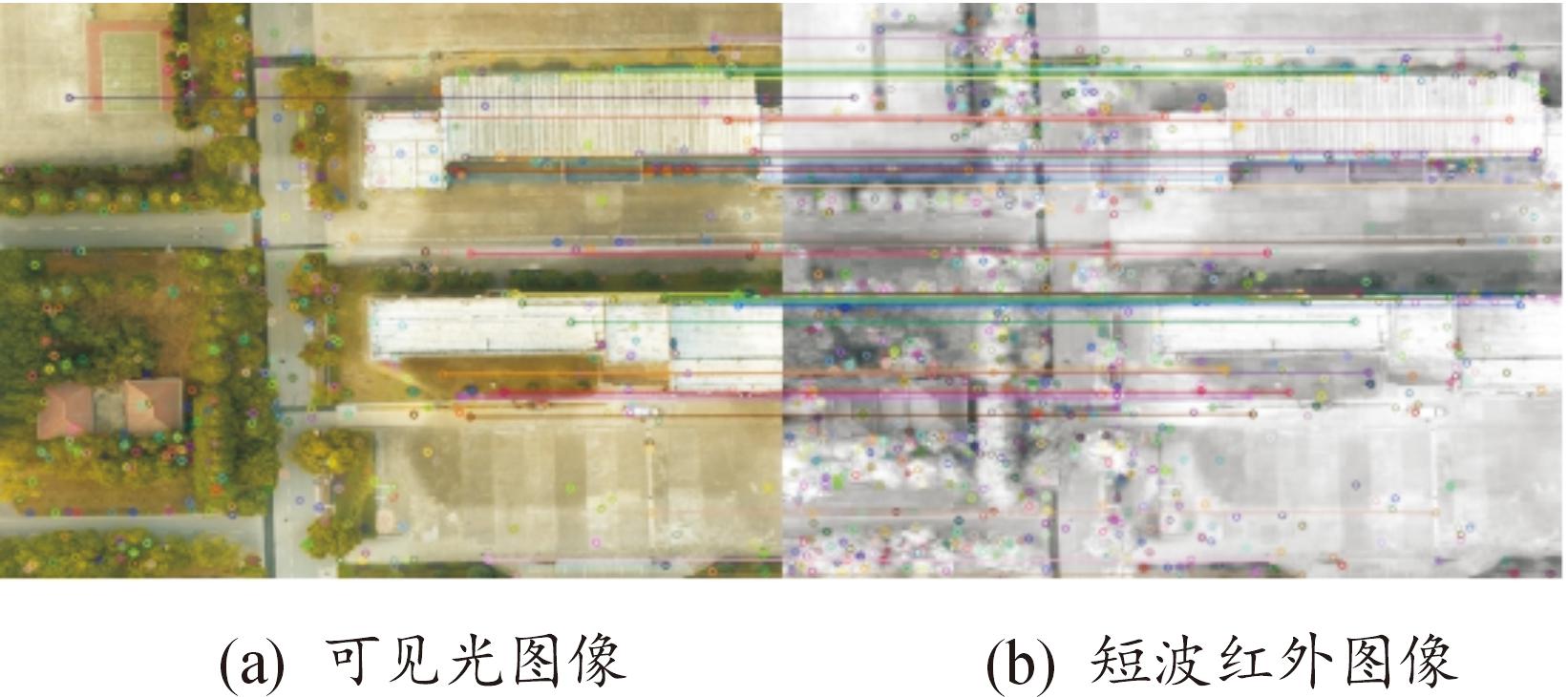

2) 使用Brute-Force算法[13]在第1幅图像上选取1个特征点,然后依次与第2幅图像的每个特征点进行距离测试,最后返回距离最近的特征点,以此类推,找到2幅图像中的一定数量的对应特征点(优选前80%的特征点),如图3所示。

图3 50 m可见光图像配准图

Fig.3 50 m visible image registration map

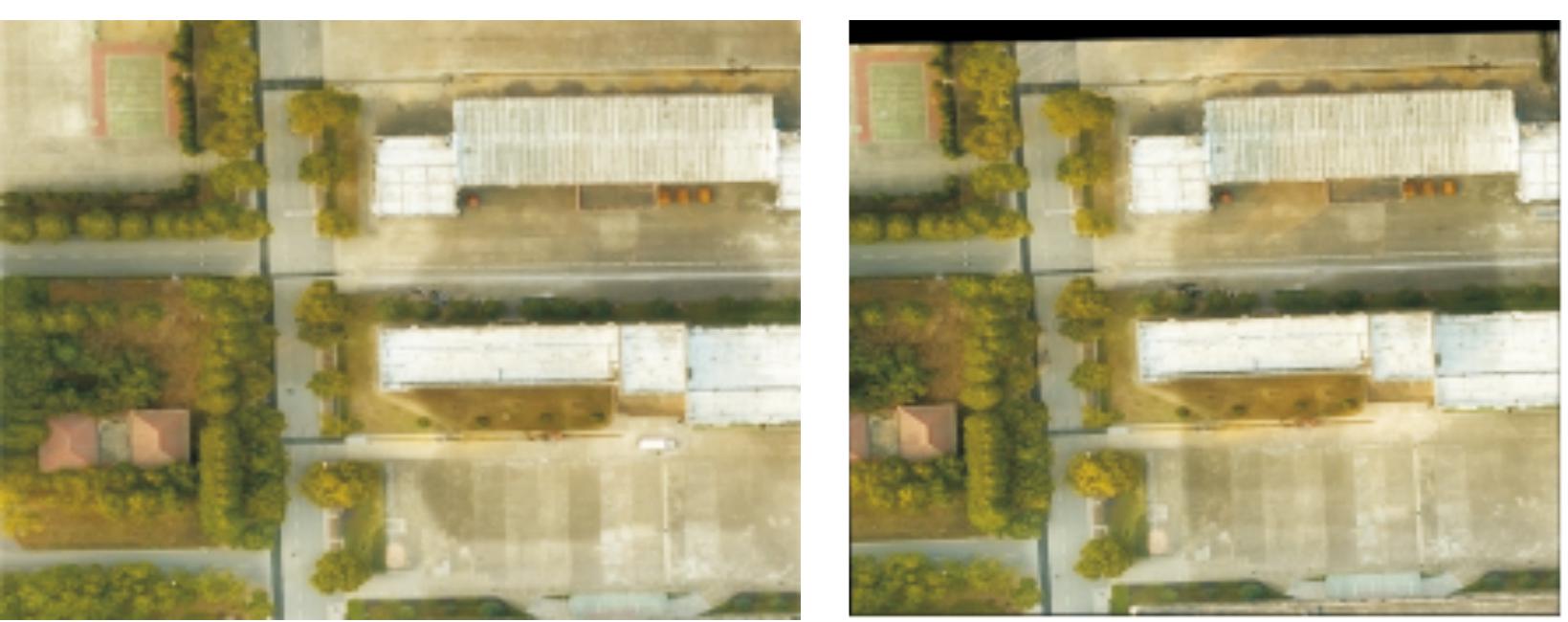

3) 根据特征点的对应关系计算单应矩阵,使用单应矩阵完成从一幅图像到另一幅图像的仿射变换[14],这里采用了4个自由度的单应矩阵计算,如图4所示。

图4 50 m二维地图重建图像仿射变换图

Fig.4 50 m two-dimensional map reconstruction image affine transformation map

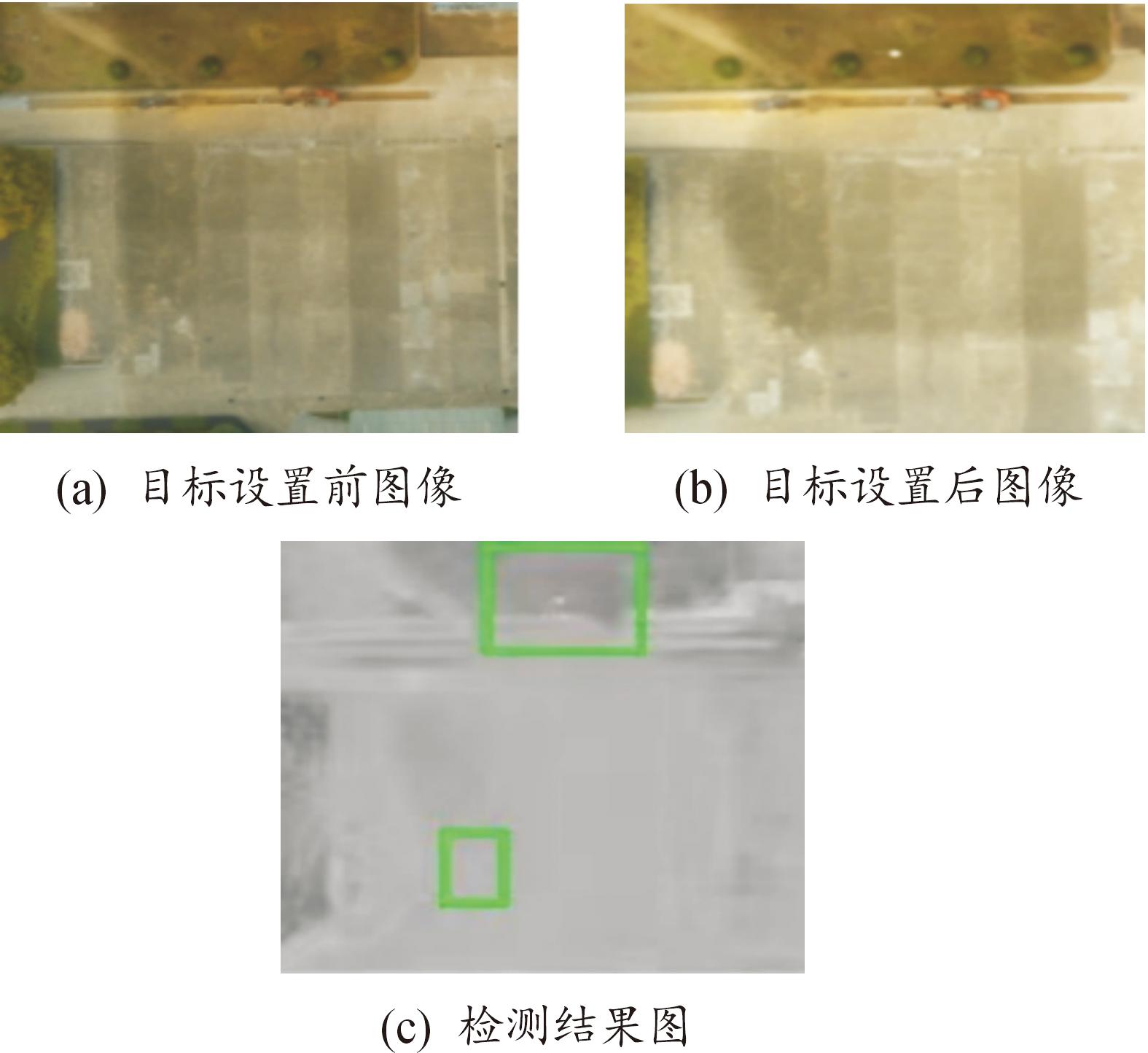

4) 对经过仿射变换处理的2幅图像进行灰度变换与亮度归一化处理,减少光照对2幅图像比对的影响,然后计算图像差值,并对计算结果进行阈值处理,从而可以判断出疑似目标点。

1.3 试验结果分析

如图5所示,采用基于SIFT算法的同源图像配准检测,通过对获得预置目标前后相同区域内的2张可见光图像进行特征点提取、图像配准、差值计算,并对计算结果进行阈值处理,去除背景干扰,可以得到疑似目标点,如图5中的方框所示。但是,由于光照强度的影响和可见光探测器成像时的噪声干扰,以及阈值大小的选择对检测效果的影响难以全部消除,虽然利用SIFT算法能够成功检测出目标点,但是同时检测出来的结果存在误判结果,出现了虚警,如图5中下方的绿色方框内的白点所示。由于可见光成像获得的图像灰度受光照强度和背景物体噪声干扰影响较大,先后2次获得的图像虽然设置的试验条件相同,但是由于天气状况、光照强度和成像角度不同而存在随机误差和系统误差。因此,仅仅依靠基于SIFT算法的同源图像配准检测方法,检测效果必然存在误差,且难以对检测结果进行核准。

图5 同源图像差异点检测结果图

Fig.5 Homologous image difference point detection result map

2 基于SIFT和INIR相结合的异源图像检测

2.1 INIR算法的基本原理

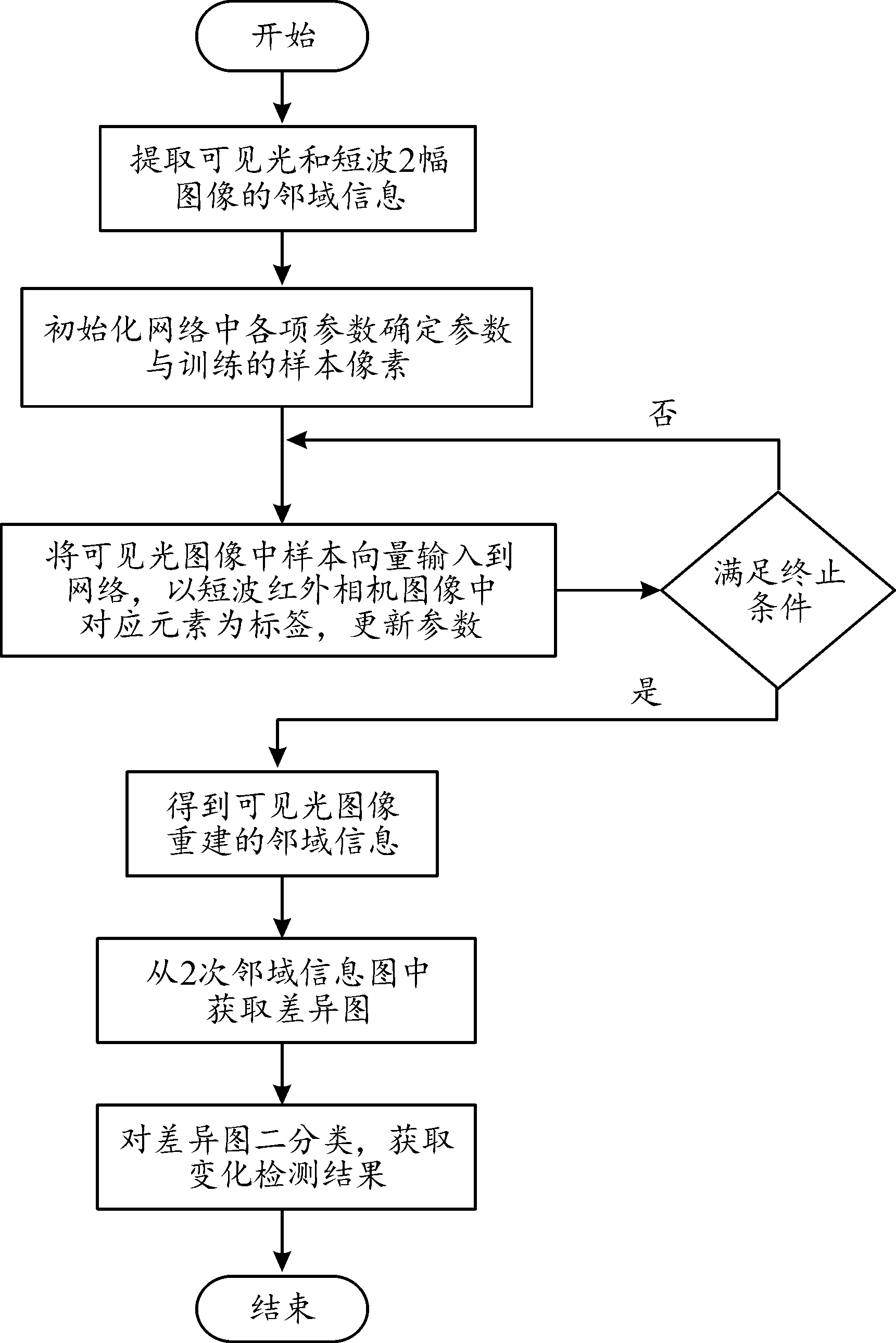

INIR算法是利用神经网络训练与推理图像所有像素点的邻域信息,简化了异源图像的数学模型,实现异源图像之间的完全重构,从而检测异源图像的对应变化区域,其基本思想是将其中一幅图像输入到神经网络,重建出另一幅图像所有像素点的邻域信息[15]。首先对2幅图像进行SIFT特征点提取,当2幅图像对应的区域未产生变化时,INIR算法根据特征点的邻域信息完全重建生成另一幅图像的邻域信息,当2幅图像对应的区域产生了变化时,重建生成另一幅图像时会出现重构误差,对产生的重构误差进行二分类处理就可以得到差异图。利用普通的阈值、聚类等方法对差异图进行分类处理,最终得到变化检测的差异点二值图。该方法仅仅对2幅图像进行了类似于同源图像配准的步骤,大大减少了利用数学方法对图像实施预处理的操作步骤,方法步骤得到了精简优化,如图6所示。

图6 异源图像配准图

Fig.6 Heterogeneous image registration image

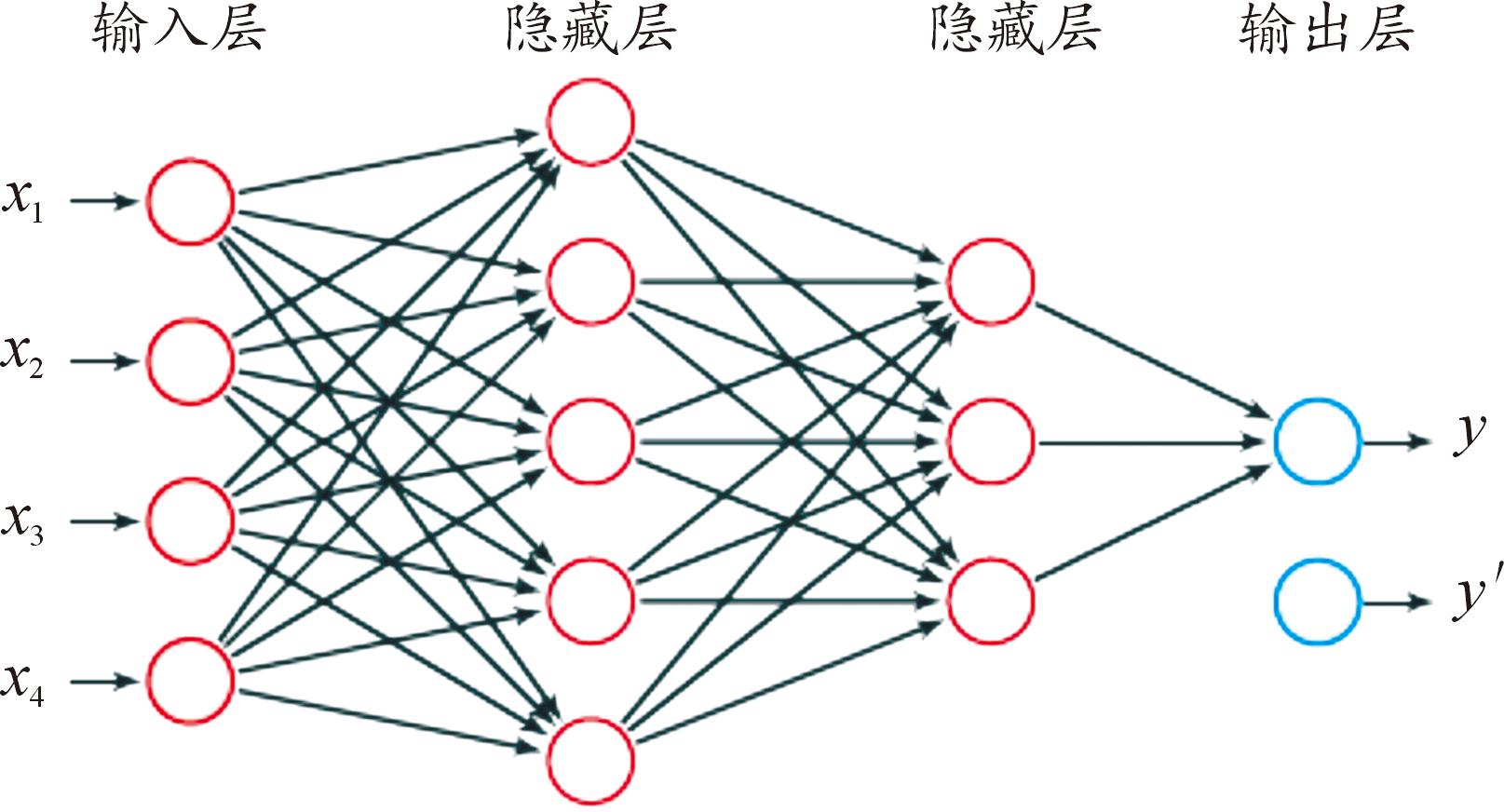

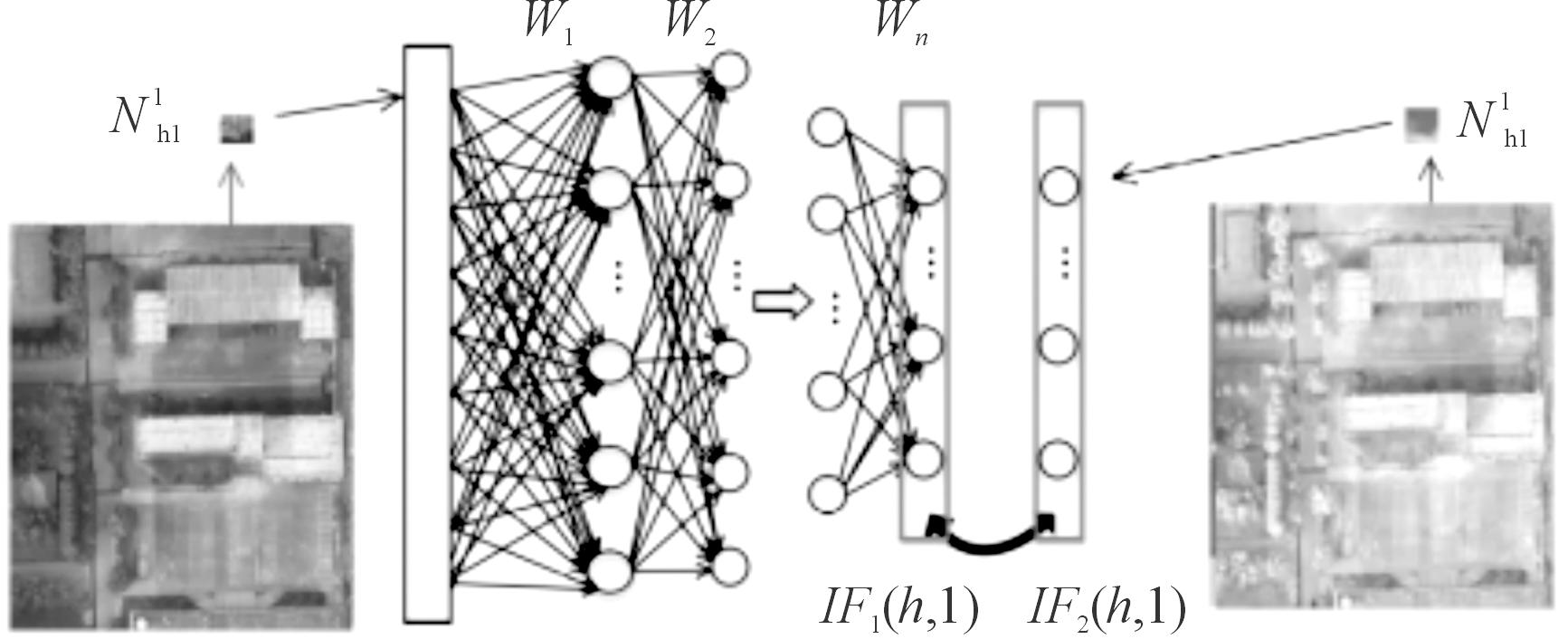

可见光图像和短波红外图像对地表物体的灰度表现有很大差别,所以输入的样本为特征点各像素点的邻域信息。在图7中,输入参数{x1,x2,…,xn}为经过图像配准、灰度变换、亮度归一化后的可见光图像像素邻域信息,输出向量为重构生成的短波红外图像结果,与实际采集的短波红外图像样本,通过分析差异性来获得疑似目标点。其中,神经网络训练采用BP反向传播算法的随机梯度下降方法。

图7 基于INIR的神经网络结构示意图

Fig.7 Neural network structure diagram based on INIR

2.2 基于SIFT和INIR的地表未爆子弹药检测试验

为了验证基于SIFT和INIR的可见光-红外异源图像差异性检测在大面积区域检测地表未爆子弹药的效果,进行试验验证,试验条件如下:使用M300六旋翼无人机作为无人机载荷平台,飞行高度50 m,搭载包含35 mm长焦镜头的国惠GH-SWCL短波红外云台和H20T可见光、长波红外双光云台2种成像探测类型的多模成像云台(如图8所示),使用大疆智图、图像交叉匹配程序构建二维地图,试验流程如图9所示。

图8 试验使用的无人机搭载探测平台图

Fig.8 The UAV carrying detection platform diagram used in the test

图9 基于SIFT和INIR的可见光-红外异源图像差异性检测流程框图

Fig.9 The difference detection flow chart of visible light-infrared heterogeneous image based on SIFT and INIR

对于异源图像差异点检测,使用基于SIFT算法的特征匹配方法完成图像配准,在此基础上,使用INIR算法训练与推理异源图像之间的变化区域,从而检测出疑似目标点。

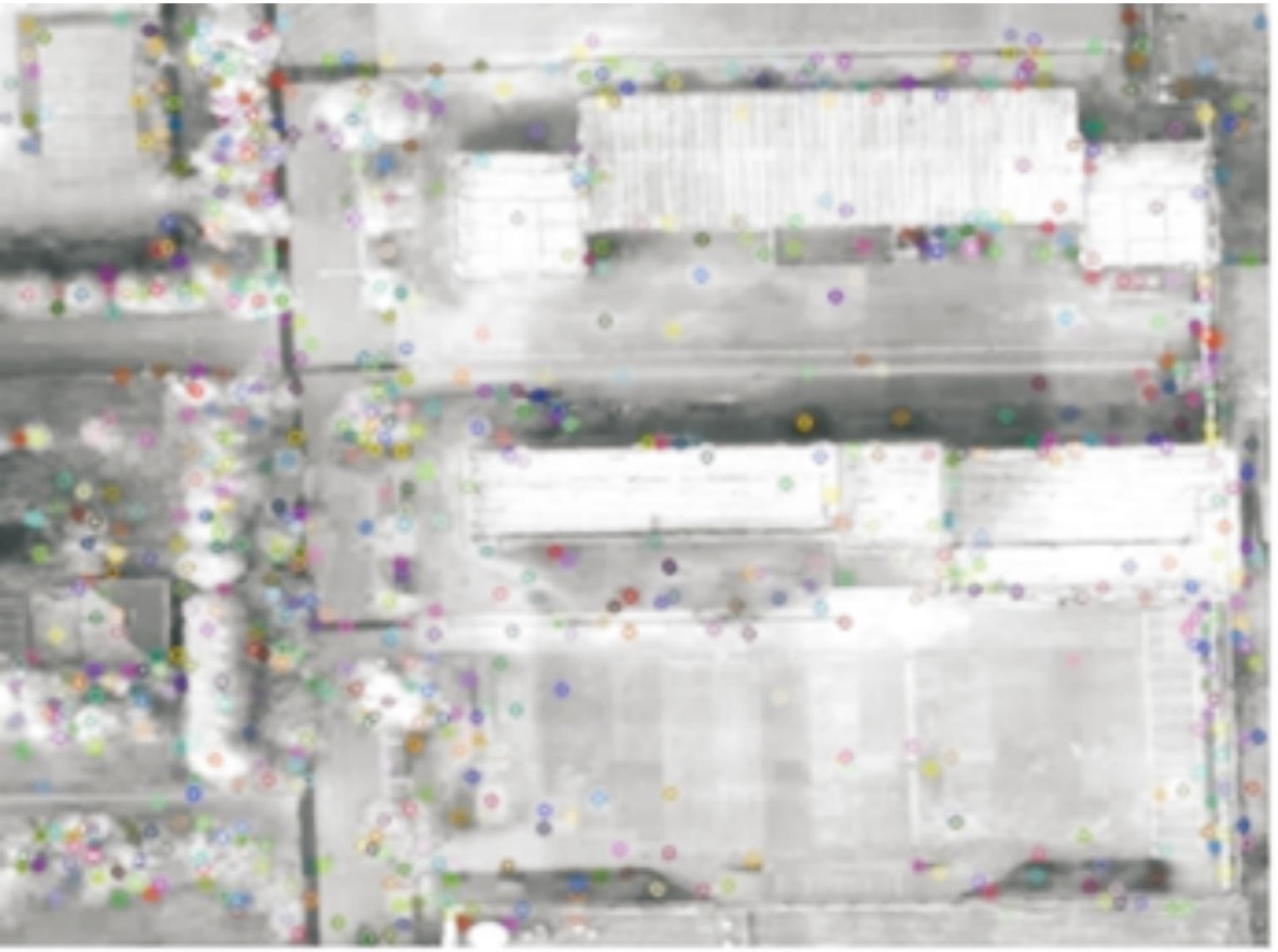

1) 由不相一致的异源成像探测器收集数据对,并对其进行预先处理,让其形成坐标系统的数据对,以此为基础,收集异源图像数据,建立异源图像映射数据集,如图10和图11所示。

图10 短波红外图像特征点提取图

Fig.10 Shortwave infrared image feature point extraction map

图11 异源图像配准图

Fig.11 Heterogeneous image registration map

2) 根据INIR算法的原理,利用神经网络训练异源图像之间的重建权重,训练生成的权重可以完成将一幅可见光灰度图像输入到神经网络后,重建出一幅相应的短波红外图像所有像素点的任务配置。

当输入1张可见光灰度图像后,首先提取其像素点的邻域信息,然后通过神经网络完成推理过程,输出对应的短波红外图像像素点的邻域信息,最后重构出相应的短波红外图像。该方法所用到的是全连接神经网络,其结构如图12所示。

图12 基于图像邻域信息重建的神经网络结构图

Fig.12 Neural network structure diagram based on image neighborhood information reconstruction

在图12中,在神经网络结构左半侧输入的图像是可见光灰度图像像素点的邻域信息,经过BP算法回归,右半侧输出层即被重建生成的短波红外图像,可见光图像和短波红外图像的灰度差异性很大。

3) 在完成前2个步骤后,2幅图像对应的未变化区域,可见光图像的邻域信息会被完全重构,而发生变化的区域对应的短波红外图像变化区域会出现重构误差,对重构误差进行分析处理可得2幅异源图像对应的差异图。得到差异图之后,利用阈值、聚类等处理方法对其分类处理,最终的结果是一幅二值图像,如图13所示。

图13 基于INIR的异源图像差异检测结果图

Fig.13 Image difference detection results based on INIR

2.3 试验结果分析

如图13所示,采用基于SIFT和INIR算法的可见光-红外异源图像差异性检测,通过获得预置目标前后相同区域内的可见光和红外图像,首先利用SIFT算法对可见光图像和红外图像进行特征提取、灰度变换和图像配准,再利用INIR算法将含有目标信息的可见光图像重建成红外图像,最后进行误差分析和阈值处理,得到疑似目标点(如图13中的圆圈内的白点所示)。该方法相对于同源图像配准检测减小了光照强度和背景噪声的干扰,提高了目标检测精度。与此同时,试验中无人机载荷平台搭载了可见光和红外多模成像云台,起飞重量大大增加,减少了无人机载荷平台单次起飞的检测扫描时间。

3 结论

1) 鉴于SIFT算法在图像处理与识别领域的广泛应用,采用试验的方法验证了基于SIFT算法的同源图像配准检测方法在解决地表未爆子弹药等小目标检测应用上的可行性,同时也发现该方法存在背景虚警率高、出现误判等问题。

2) 在同源图像配准检测的基础上提出了基于SIFT和INIR的可见光-红外异源图像差异性检测方法,该方法能够降低误判、漏判的可能性,减小了背景噪声干扰。

3) 通过对比发现,在同等试验条件下,异源图像检测相较于同源图像检测精度有了较大幅度的提升,但是由于异源图像检测需携带多模摄像头,导致设备重量增加,其平台单次飞行工作时间相较于仅搭载可见光成像设备缩短了近一半。

试验结果表明,基于SIFT和INIR的异源图像检测方法在解决未爆子弹药等小目标快速检测问题中有更好的应用前景,在有效提升目标检测效率的同时,也为下一步地表未爆子弹药的准确识别定位提供了可能,为该类小目标的搜寻系统实现提供了有力的技术支撑。

[1] 徐建国,丁凯,李阳明.未爆弹药探测技术发展现状及思考[J].中国公共安全,2020(4):176-178.XU Jianguo,DING Kai,LI Yangming.Development status and thinking of unexploded ordnance detection technology[J].China Public Security,2020(4):176-178.

[2] 倪宏伟,房旭民.地雷探测技术[M].北京:国防工业出版社,2003.NI Hongwei,FANG Xumin.Mine detection technology[M].Beijing:National Defense Industry Press,2003.

[3] 曾昭发,刘四新,冯晅.探地雷达原理与应用[M].北京:电子工业出版社,2010.ZENG Zhaofa,LIU Sixin,FENG Xuan.Principle and application of ground penetrating radar[M].Beijing:Electronic Industry Press,2010.

[4] 廖逍,张弛,应国德,等.基于背景差分法的电网巡检运动目标检测技术[J].沈阳工业大学学报,2023,45(1):78-83.LIAO Xiao,ZHANG Chi,YING Guode,et al.Moving target detection technology based on background difference method for power grid patrol inspection[J].Journal of Shenyang Polytechnic University,2023,45(1):78-83.

[5] 蒙晓宇,朱磊,张博,等.基于结构相似性粗定位与背景差分细分割的运动目标检测方法[J].科学技术与工程,2021,21(36):15563-15570.MENG Xiaoyu,ZHU Lei,ZHANG Bo,et al.Moving target detection method based on rough positioning of structure similarity and fine segmentation of background difference[J].Science Technology and Engineering,2021,21(36):15563-15570.

[6] LOWE D G.Object recognition from local scale-invariant features[C]//In International Conference on Computer Vision.[S.l.]:[s.n.],1999,2:1150-1157.

[7] 孙希延,刘博,纪元法,等.基于SIFT改进的无人机图像匹配算法[J].电光与控制,2023,30(5):34-38.SUN Xiyan,LIU Bo,JI Yuanfa,et al.Improved UAV image matching algorithm based on SIFT[J].Optoelectronics and Control,2023,30(5):34-38.

[8] 高凯元,刘雷,崔海华,等.基于小波变换的精密测量点云多尺度分解[J].光学精密工程,2023,31(3):340-351.GAO Kaiyuan,LIU Lei,CUI Haihua,et al.Multi-scale decomposition of point cloud data based on wavelet transform[J].Optics and Precision Engineering,2023,31(3):340-351.

[9] 罗柏槐,李扬,林熙烨,等.融合LoG特征的凸焊螺母检测算法[J/OL].计算机工程与应用:1-12[2023-05-09].LUO Baihuai,LI Yang,LIN Xiye,et al.Weld nut detection algorithm based on LoG feature fusion[J/OL].Computer Engineering and Applications:1-12[2023-05-09].

[10] 刘杰,游品鸿,占建斌,等.改进SIFT快速图像拼接和重影优化[J].光学精密工程,2020,28(9):2076-2084.LIU Jie,YOU Pinhong,ZHAN Jianbin,et al.Improved SIFT fast image stitching and ghosting optimization algorithm[J].Optics and Precision Engineering,2020,28(9):2076-2084.

[11] LOWE D G.Distinctive image features from scale-invariant key points[J].International Journal of Computer Vision,2004,60(2):91-110.

[12] 拉斐尔·C.冈萨雷斯,理查德·E.伍兹.数字图像处理[M].阮秋琦,阮宇智,译.4版.北京:电子工业出版社,2020:637-648.RAFAEL C G,RICHARD E W.Digital image processing[M].RUAN Qiuqi,RUAN Yuzhi,translation.4th ed.Beijing:Electronics Industry Press,2020:637-648.

[13] 杨洋,项辉宇,薛真,等.模式图像的特征提取与配准方法[J].包装工程,2017,38(1):185-190.YANG Yang,XIANG Huiyu,XUE Zhen,et al.Feature extraction and matching algorithm of pattern image[J].Packing Engineering,2017,38(1):185-190.

[14] JIN B,HU W L,WANG H Q.Human interaction recognition based on transformation of spatial semantics[J].IEEE Signal Processing Letters,2012,19(3):139-142.

[15] 王志锐.基于深度神经网络的异源遥感图像变化检测[D].西安:西安电子科技大学,2018:10-12.WANG Zhirui.Change detection for hetergeneous remote sensing image based on deep neural network[D].Xi’an:Xidian University,2018:10-12.