0 引言

为了获取更好的测量效果,科研人员一直致力于鲁棒立体视觉匹配算法的研究[1]。立体匹配算法被分为局部立体匹配算法和全局立体匹配算法。前者主要利用区域内匹配像素点的匹配信息来计算视差;后者通常构建一个由数据项和平滑项组成的能量函数,通过最优化此能量函数的值来达到效果较好的立体匹配[2]。

当被测物表面纹理不明显时,双目立体视觉很难准确地匹配两相机视图中的对应点且匹配过程伴随着非常高的误匹配。结构光的使用可以显著地降低匹配难度,在提高匹配准确度的同时降低误匹配率[3-4]。因此,结构光常常与立体视觉结合起来用于实时的三维测量,这种测量方法被称为主动立体视觉[5]。目前,许多结构光图案已被设计用于辅助照明[6-7],例如,激光散斑图案,相位图案,点图案和线图案。每种结构光都有各自的优势和劣势。激光散斑图案对平面物体有着高测量准确度,但在测量曲率变化较大的复杂形状物体时其准确度会显著地降低[8-11]。相位图案有着高准确度和高分辨率,但在测量不连续的相位区域时会出现信息缺失的现象[12]。点图案对外界光的抗干扰力较强且测量准确度较高[13-15],但其分辨率较低。类似于点图案,线图案对外界光也有较强的抵抗力同时能够实现高准确度测量。此外,线图案的分辨率相较于点图案有显著地增加。例如,文献[16]中应用线图案在强光的干扰下检测和重建高反射区域,其能够准确地识别和重建大范围的焊接表面。文献[17]中应用线图案在中雨环境条件下重建人脸,其展现了在复杂和非均匀传播介质中重建物体的可能性。文献[18]中提出了一种基于颜色分段和颜色边缘的精确立体匹配方法,该方法在高精度的工业机器人应用中具有可行性。文献[19]中提出了一种基于深度卷积神经网络的中心线提取算法,能精确地提取用于重建轴类零件的激光线条纹的中心线。文献[20]中提出了一种基于灰度拓展的复合光轮廓法,该方法能够确保三维曲面重建结果的完整性。文献[21]中提出了一个基于双频双步相移方法的测量系统,该系统能够重建复杂动态物体的三维表面。

选择哪一种结构光取决于实际应用场景。就线图案而言,选用线的宽度越窄,则投射在待测物体表面的线数量就越多,三维测量分辨率也就越高。然而,线条纹分布过于密集不仅会增加线的分割难度而且会降低分割线的质量。为了同时获得高重建分辨率和高匹配准确度,文献[22]中提出了一种鲁棒的由疏到密的RGB线图案和一种匹配像素差模型(matched pixel difference modeling)方法。为了减小匹配难度,RGB线图案增加了相邻红色线之间的距离。MPDM方法用绿线像素建立像素差模型预测蓝线像素的匹配关系,待蓝线像素完成匹配后,更新像素差模型预测红线像素的匹配关系。总的来说,MPDM预测模型在测量动态及可形变物体时是鲁棒的,但它不能准确预测深度变化范围较大物体边缘位置处的匹配关系。为了进一步扩大RGB线图案的设计优势,避免其潜在的限制。提出了一种由红色、浅绿色、青色和紫色四种颜色组成的线图案。设计的四色线图案依旧遵循由疏到密的原则,它包含垂直的青色线、垂直的浅绿色线、垂直的紫色线和垂直的红色线。其中,两相邻青色线之间的距离最大,两相邻红色线之间的距离最小。为了避免边缘位置处的模型预测错误,提出了线连接算法用于匹配对应的线。首先,匹配青色线,然后,用匹配后的青色线作为约束区间匹配浅绿色线和紫色线。最后,用匹配后的三种颜色线作为约束区间匹配红色线。

在立体匹配之后,物体表面的三维点根据视差原理计算[23],物体表面的三维形状用样条插值进行重建[24]。Kinect作为获取物体深度信息的测量设备已被用于各种领域[25-27]。文献[28]选择英特尔深度相机作为移栽机器人获取秧苗深度图像的捕捉设备,有效减少了幼苗的移栽损失。实验后续将KinectV1,KinectV2和IntelD435与所提方法对不同物体的重建结果进行了比较。最后,所提方法与MPDM方法对动态物体的重建结果进行了比较。实验结果表明提出的方法相较于现存的方法或产品有着更强的鲁棒性。

1 提出的方法

1.1 主动立体视觉测量系统和设计的四颜色线结构光图案

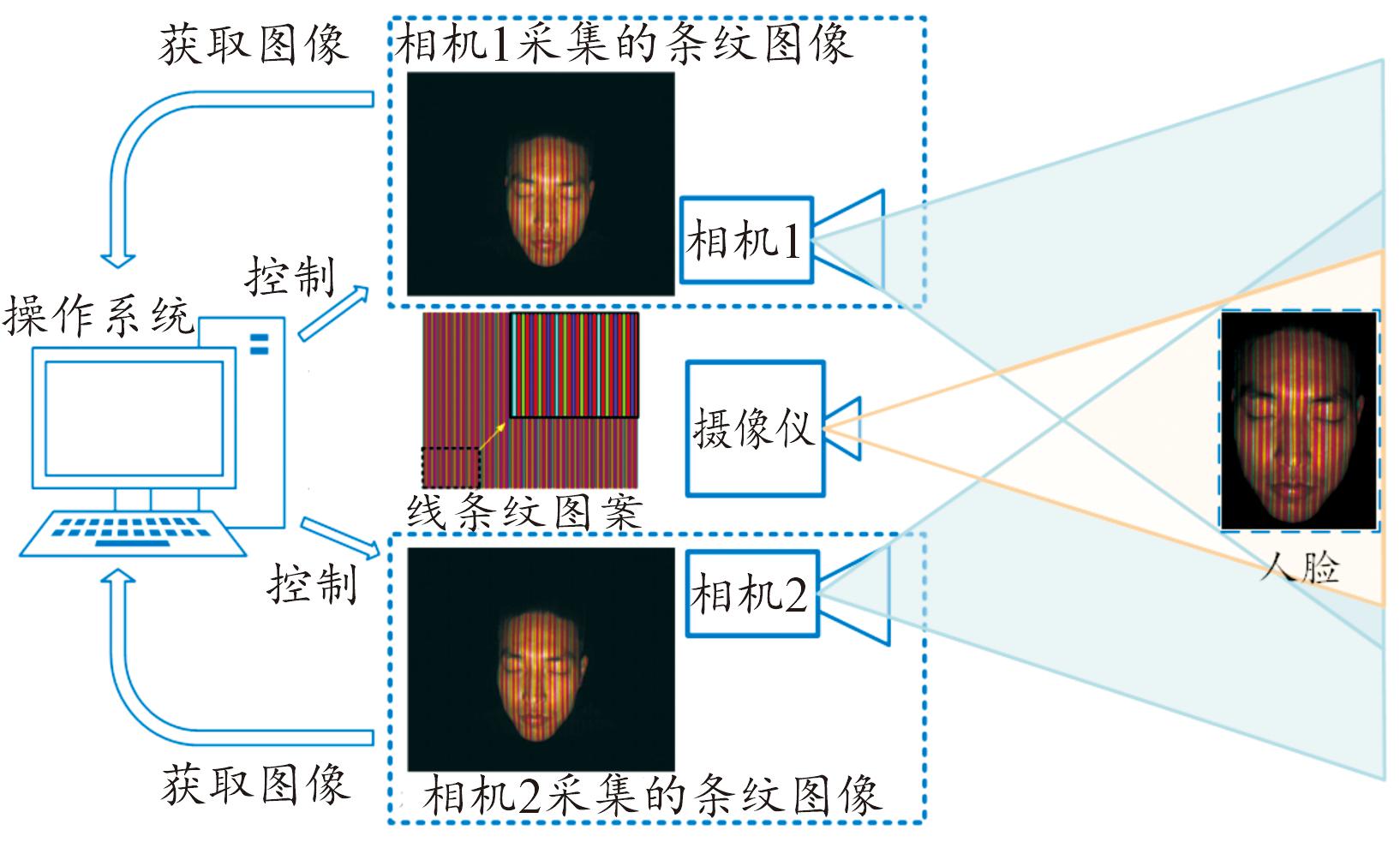

图1是主动立体视觉测量系统示意图。图中投影仪将线结构光投射在被测物体表面,2个相机同步采集条纹图像。

图1 主动立体视觉测量系统示意图

Fig.1 Diagram of the active stereo vision measurement system

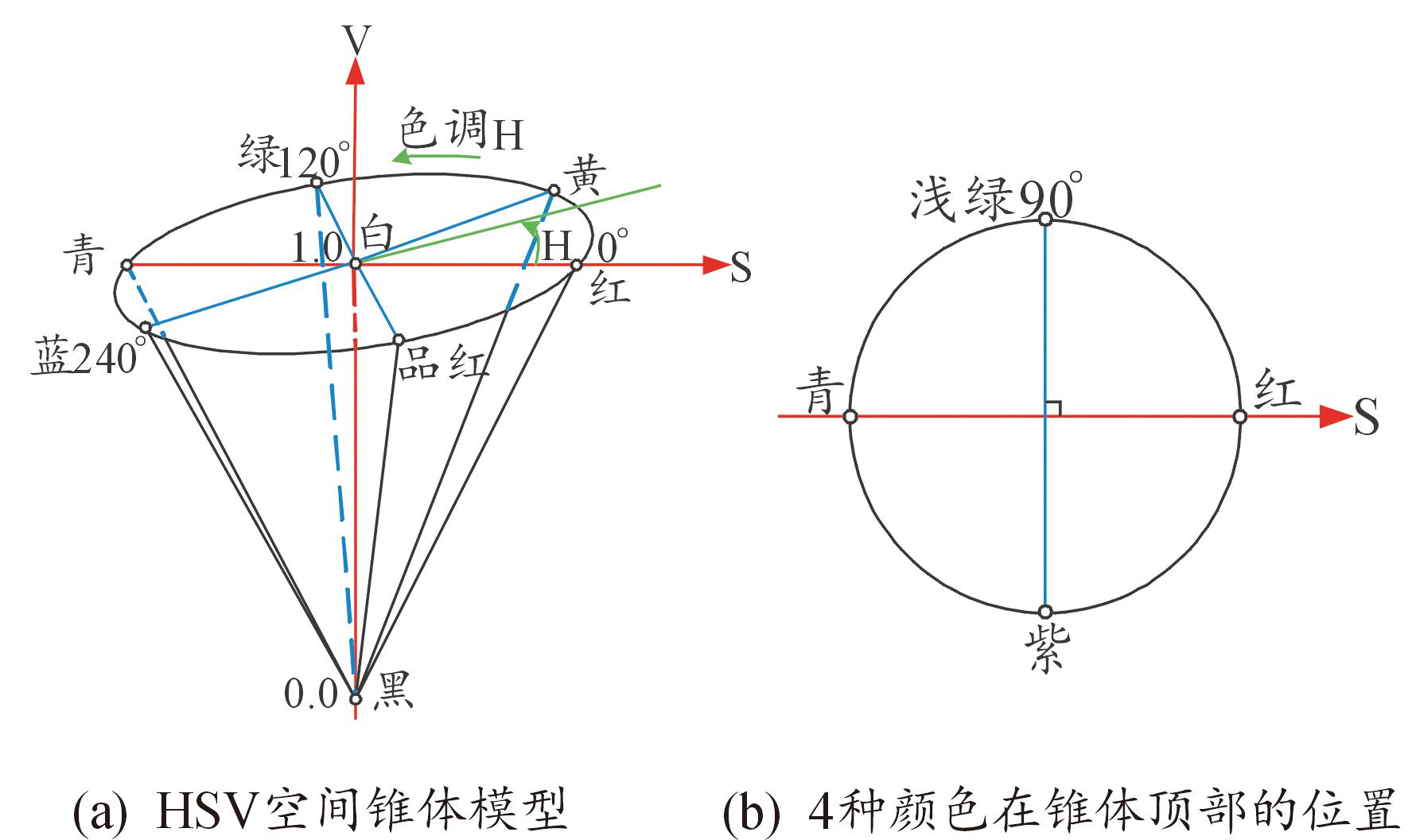

图2中(a)和(b)分别展示了HSV颜色空间锥体模型和4种颜色在锥体模型顶部的位置。选出的4种颜色分别是红色(255,0,0),浅绿色(128,255,0),青色(0,255,255)和紫色(128,0,255)。如图2(b)所示,4种颜色任意相邻两种颜色间的夹角为90°。

图2 每种颜色在色调,饱和度,亮度(HSV)颜色空间的空间位置

Fig.2 The spatial position of each color in hue,saturation,brightness (HSV) color space

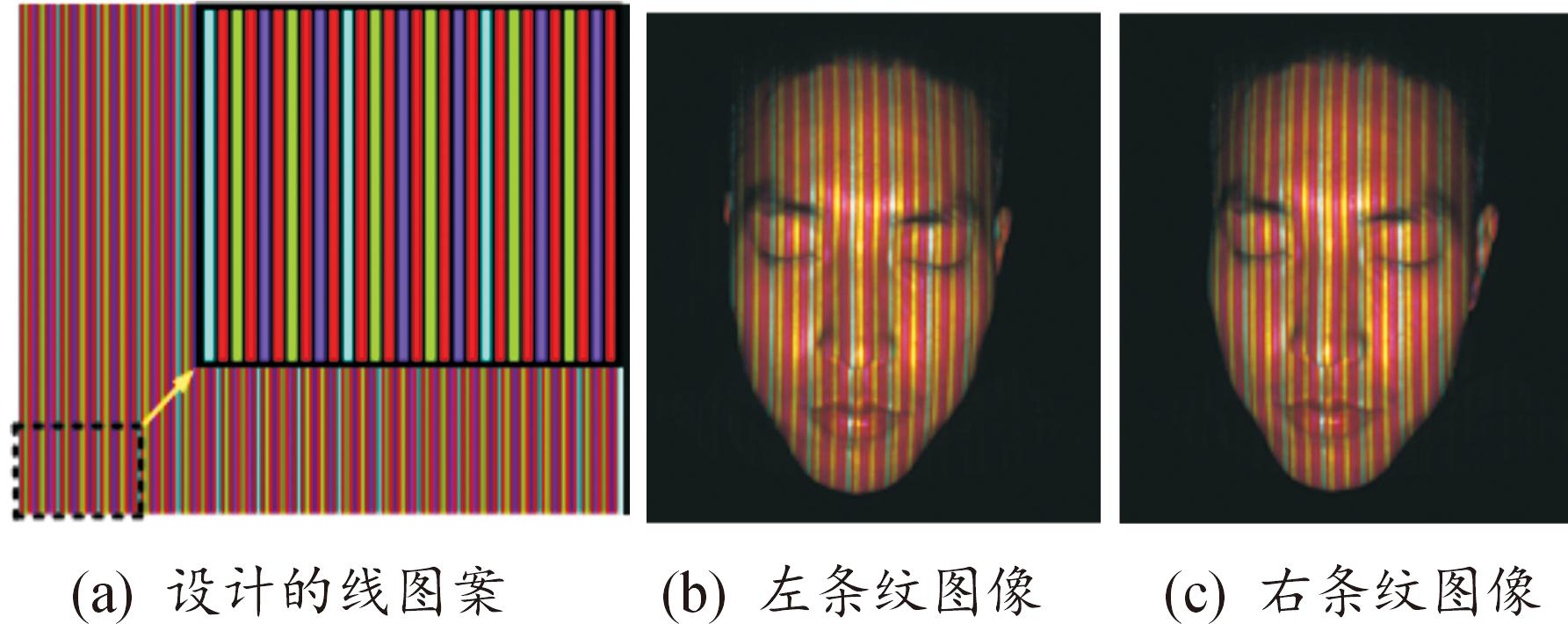

图3是设计的四色线图案和采集的条纹图像,如图3(a)所示。设计的条纹图案包含红色线,浅绿色线,青色线和紫色线,并且它们按青色、红色、浅绿色、红色、紫色、红色、浅绿色、红色、紫色和红色的顺序循环排列。在每个循环周期中,红色线的数量为五,浅绿色线的数量和紫色线的数量都为二,青色线的数量为一。图3(b)展示了左相机采集的条纹图像。图3(c)展示了右相机采集的条纹图像。在双目实验中因为人脸便于控制摆出一些复杂的三维动作,所以将人脸选定为主要的测量目标来测试立体匹配算法的鲁棒性。

图3 设计的4种颜色线图案和两立体相机采集的条纹图像

Fig.3 Demonstration of the designed four color lines pattern and the acquired pattern images by two stereo cameras

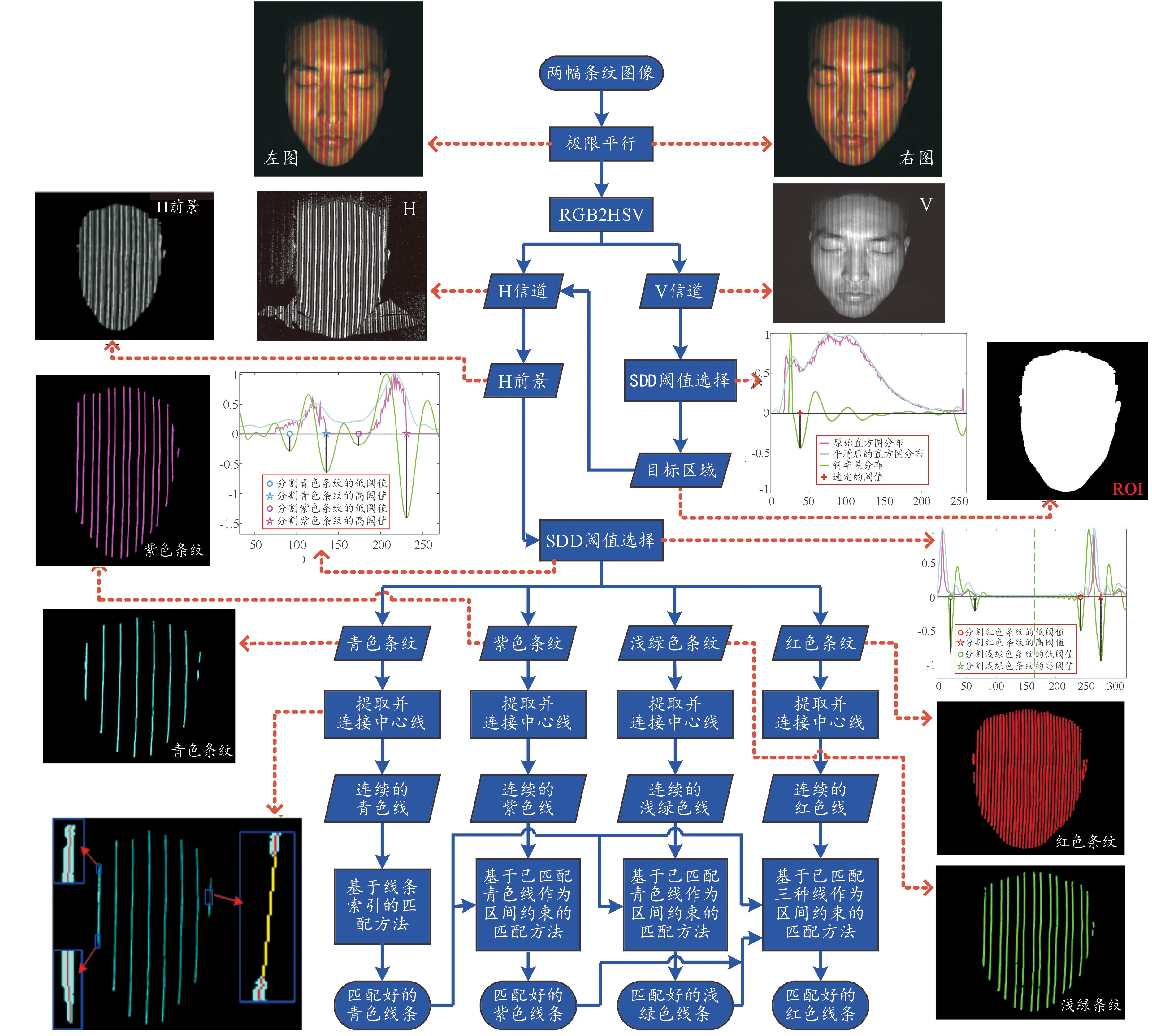

图4是提出的立体匹配方法的流程图。

图4 提出的立体匹配方法的流程

Fig.4 The flowchart of the proposed stereo matching approach

其包括以下几个步骤:

步骤1:左相机和右相机同步采集得到两幅条纹图像,接着通过极限平行校准图像,使得两条纹图像中对应的像素点位于同一水平线上。

步骤2:条纹图像由RGB颜色空间转换到HSV颜色空间。条纹图像的V信道通过斜率差分布(SDD)阈值选择方法获取图像中感兴趣的区域(ROI),ROI可作为约束区域得到线图像H信道的前景区域。前景图像通过SDD阈值选择进行分割可获得红色条纹,浅绿色条纹,青色条纹和紫色条纹。

步骤3:提取各颜色条纹的中心线,断开线的相邻端点用拟合线连接。

步骤4:两相机视图中的青色线根据提出的线索引方法进行匹配,已匹配的青色线作为区间约束对紫色线和浅绿色线进行匹配。最后,将所有已匹配的青色线,紫色线和浅绿色线共同作为区间约束匹配红色线。

1.2 提出的线分割方法

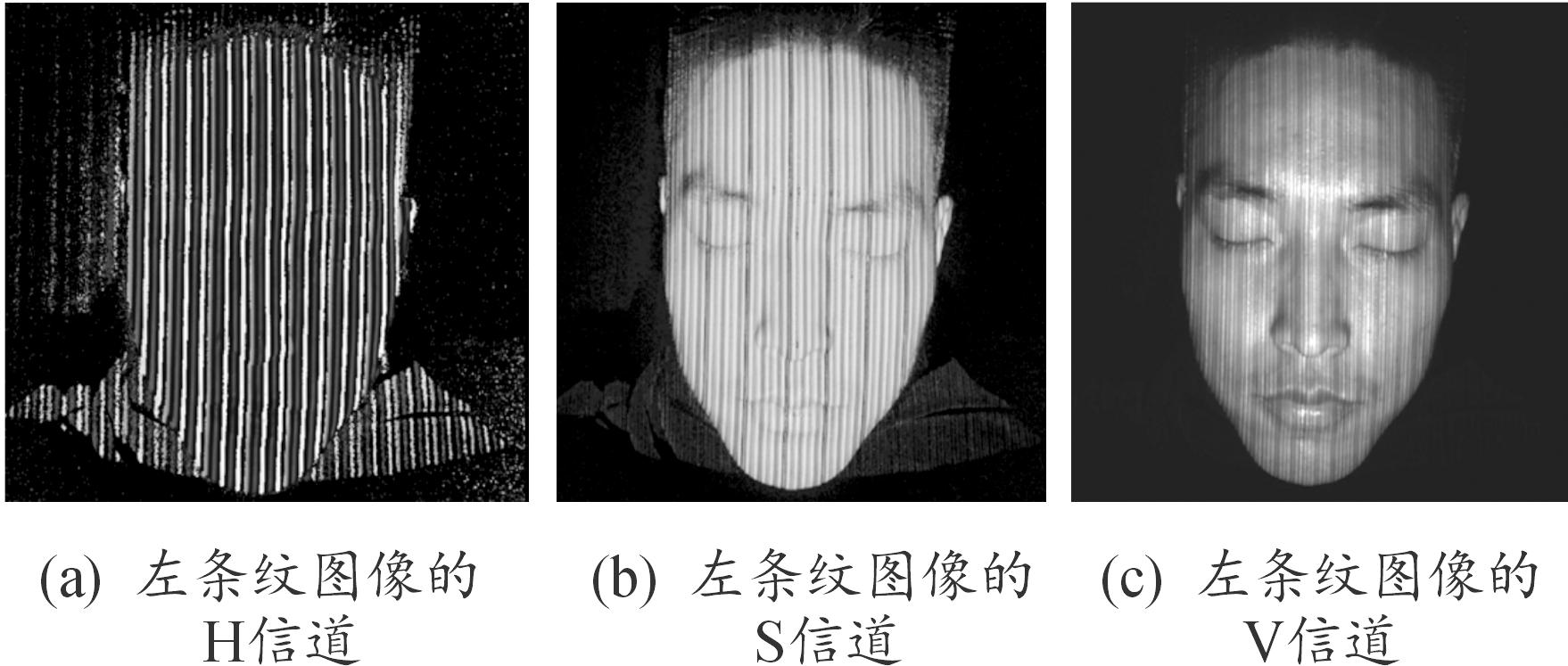

四色线图案中的线周期性出现。在每次循环中,有一根垂直的青色线,2根垂直的浅绿色线,两根垂直的紫色线和五根垂直的红色线。以这种方式设计的图案可以在HSV颜色空间轻松地分割出每一种颜色线。相较于RGB颜色空间,外界光在HSV颜色空间中对线分割的干扰影响明显地减小。图5展示了在HSV颜色空间中条纹图像的3个信道图像。

图5 左条纹图像的H信道,S信道和V信道

Fig.5 Demonstration of the captured left pattern image in H,S,and V channels

图5(a)展示了左条纹图像的H信道,图5(b)和(c)分别展示了左条纹图像的S信道和V信道。正如图5(a)中所示,在人脸区域外部有额外的线且很难对这些线进行鲁棒的聚类。因此,人脸外部的线需要使用ROI区域移除。条纹图像的V信道可以用来获取人脸的ROI区域。显然,阈值选择是分割V信道得到ROI最有效的方法。相较于其他的阈值选择方法,SDD阈值选择方法[29]可以更准确地计算出不同颜色条纹的聚类中心和阈值点,通过标定参数W和N可在图像直方图中选出最优阈值。W为低通离散傅里叶滤波器的带宽,N为拟合数值。通过解下列方程可以方便地选出阈值和图像直方图的聚类中心:

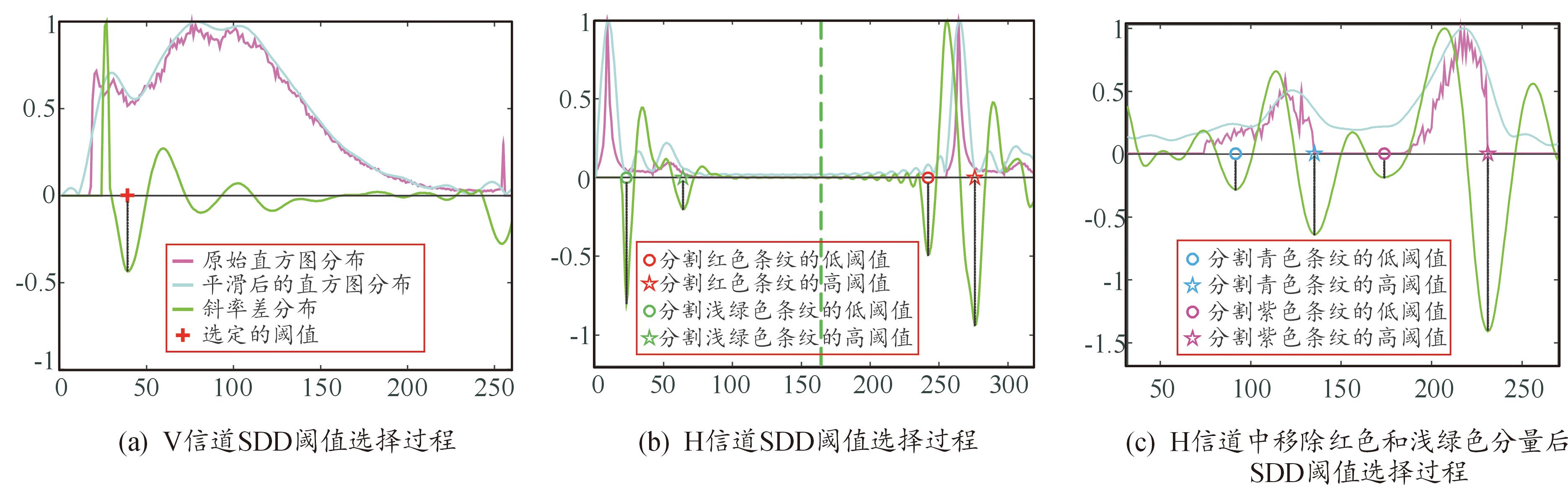

![]()

(1)

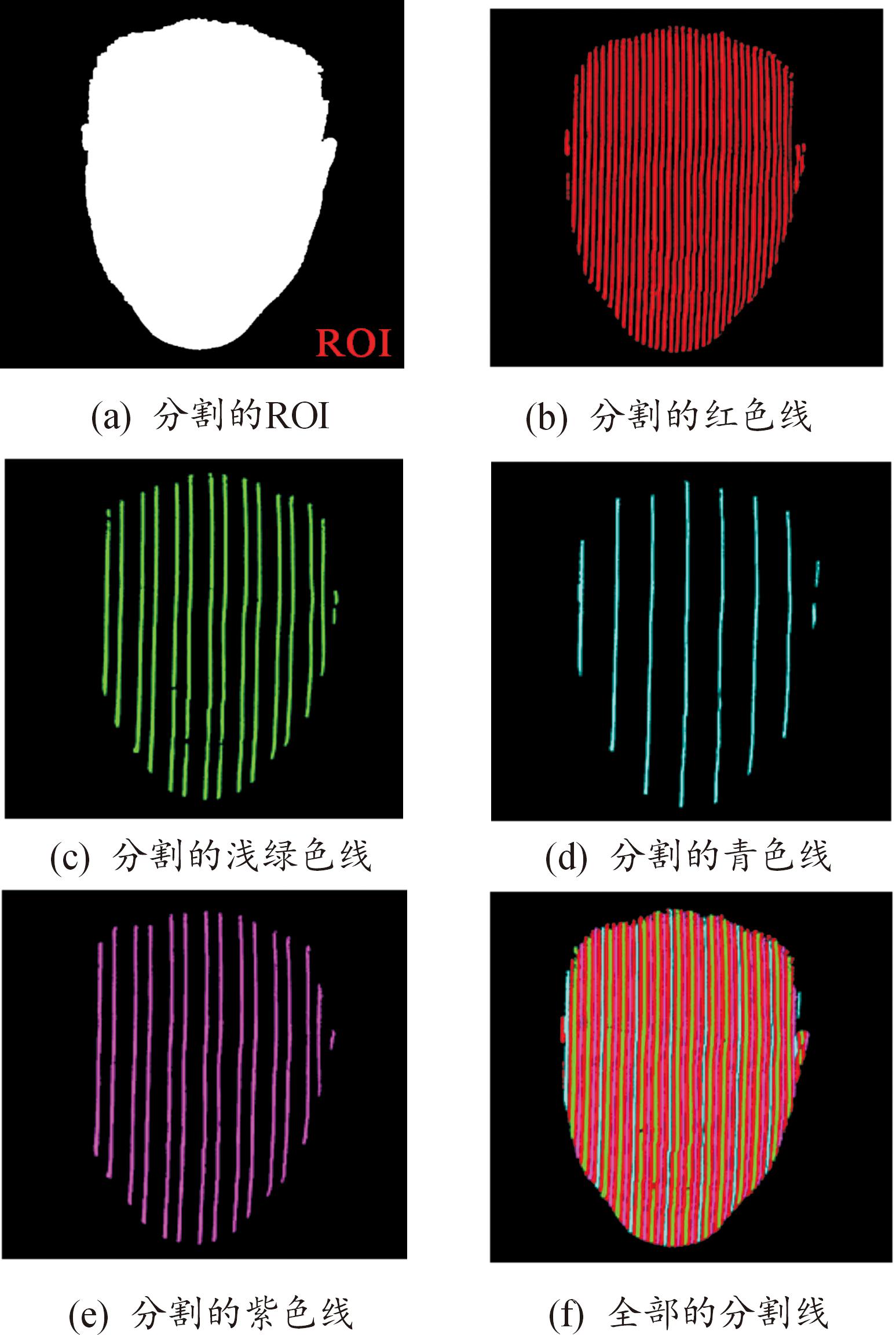

式(1)中:S(x)为图像平滑后直方图的斜率差分布;x为平滑后直方图上的点。图6(a)展示了V信道SDD阈值选择过程,在V信道中选出的阈值TV用红色加号表示。如图7(a)所示,用阈值TV得到ROI图像。在条纹图像的H信道中通过双SDD阈值可以分割出红色线,浅绿色线,青色线和紫色线。图6(b)展示了H信道SDD阈值选择过程。选择的红色线低阈值TR1和高阈值TR2分别用红色圆圈和红色五角星表示。选择的浅绿色线低阈值TL1和高阈值TL2分别用绿色圆圈和绿色五角星表示。图6(c)展示了H信道中移除红色和浅绿色分量后SDD阈值选择过程。选择的青色线低阈值TC1和高阈值TC2分别用青色圆圈和青色五角星表示。选择的紫色线低阈值TP1和高阈值TP2分别用紫色圆圈和紫色五角星表示。在所有颜色线的阈值确定之后,红色线,浅绿色线,青色线和紫色线分别根据下面的公式进行分割:

![]()

(2)

![]()

(3)

![]()

(4)

![]()

(5)

图6 条纹图像H信道和V信道SDD阈值选择过程

Fig.6 Demonstration of the SDD threshold selection process for the pattern image in H and V channels

图7 分割的ROI和分割的不同颜色线

Fig.7 Demonstration of the segmented ROI and the segmented lines in different colors

其中:H表示条纹图像的H信道;V表示条纹图像的V信道;R代表红色线的分割结果;L代表浅绿色线的分割结果;C代表青色线的分割结果;P代表紫色线的分割结果;(i, j)表示采集的条纹图像中像素的索引。

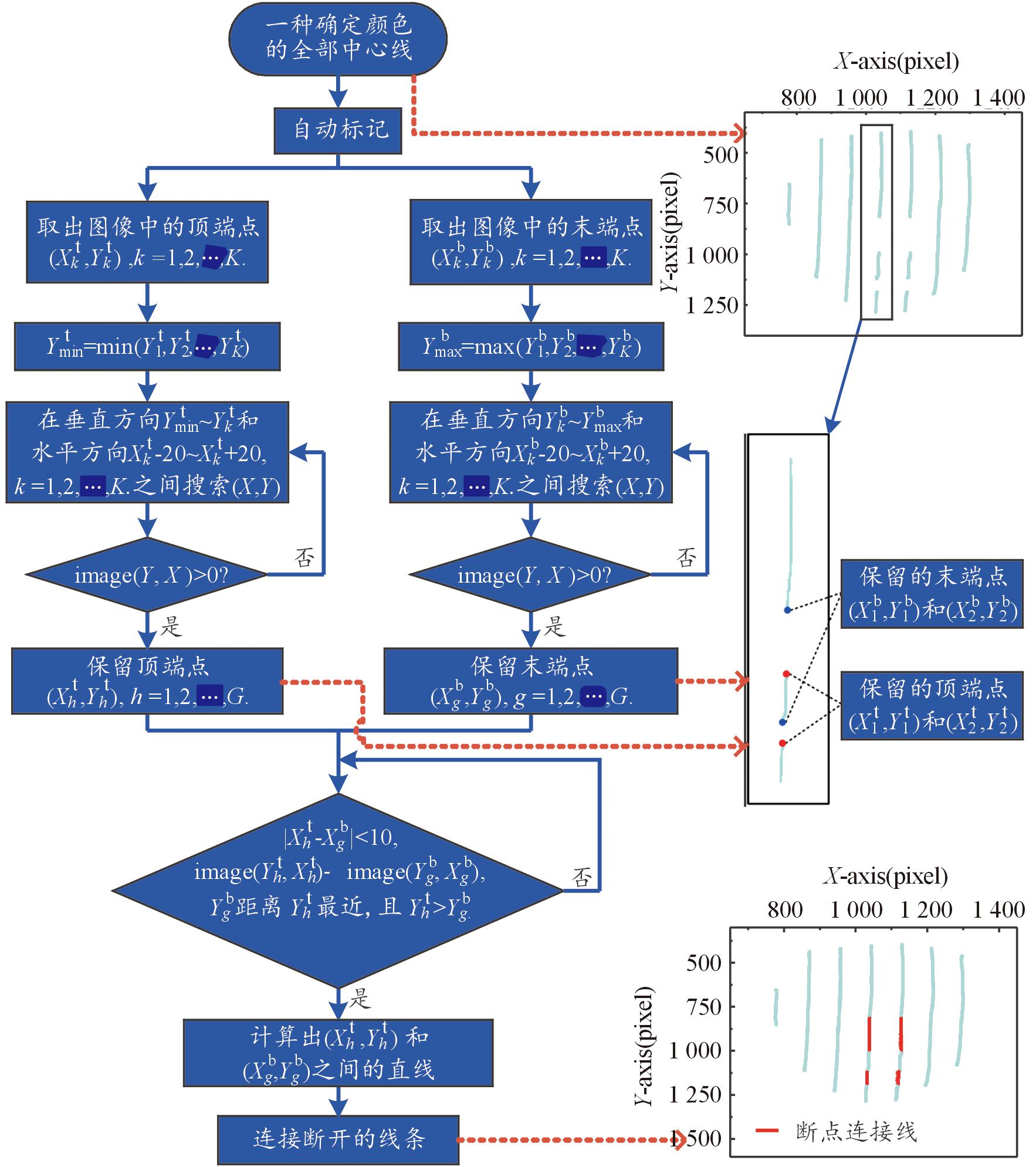

在分割所有的颜色线之后,为了有效地进行立体匹配,需要提取出每种颜色线的中心线。在该研究中,通过在水平方向上计算出每一根条纹中所有像素坐标的均值,再取整来获取条纹的中心线。在提取出所有颜色线的中心线后,通过直线连接算法连接断开的线,直线连接算法的流程如图8所示。首先,标记所有的中心线。对于标记后的中心线,它们的顶端点和末端点分别被计算为![]() 和

和![]() 表示图中所有标记线的顶端点总数。图中顶端点总数等于末端点总数。所有顶端点的最小值被计算为

表示图中所有标记线的顶端点总数。图中顶端点总数等于末端点总数。所有顶端点的最小值被计算为![]() 然后,在垂直范围

然后,在垂直范围![]() 和在水平范围

和在水平范围![]() 之间搜索(Y,X)。如果满足它的像素值大于0这一条件,即image(Y,X)>0,则保留顶端点

之间搜索(Y,X)。如果满足它的像素值大于0这一条件,即image(Y,X)>0,则保留顶端点![]() 所有保留的顶端点表示为

所有保留的顶端点表示为![]() 表示图中保留的顶端点总数。图中保留的顶端点总数等于保留的末端点总数。所有末端点的最大值被计算为

表示图中保留的顶端点总数。图中保留的顶端点总数等于保留的末端点总数。所有末端点的最大值被计算为![]() 然后,在垂直范围

然后,在垂直范围![]() 和在水平范围

和在水平范围![]() 之间搜索(Y,X)。如果满足它的像素值大于0这一条件,即image(Y,X)>0,则保留末端点

之间搜索(Y,X)。如果满足它的像素值大于0这一条件,即image(Y,X)>0,则保留末端点![]() 所有保留的末端点表示为

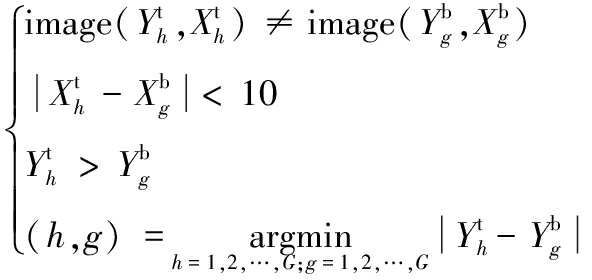

所有保留的末端点表示为![]() 下面联立的式(6)可以确定对应的顶端点

下面联立的式(6)可以确定对应的顶端点![]() 和末端点

和末端点![]() 组。

组。

(6)

图8 直线连接算法的流程

Fig.8 Flowchart of the straight-line connection algorithm

然后,一组对应的顶端点和末端点之间的直线由式(7)计算:

![]()

(7)

最后,断开的线用计算出的直线进行连接。

1.3 提出的立体匹配方法

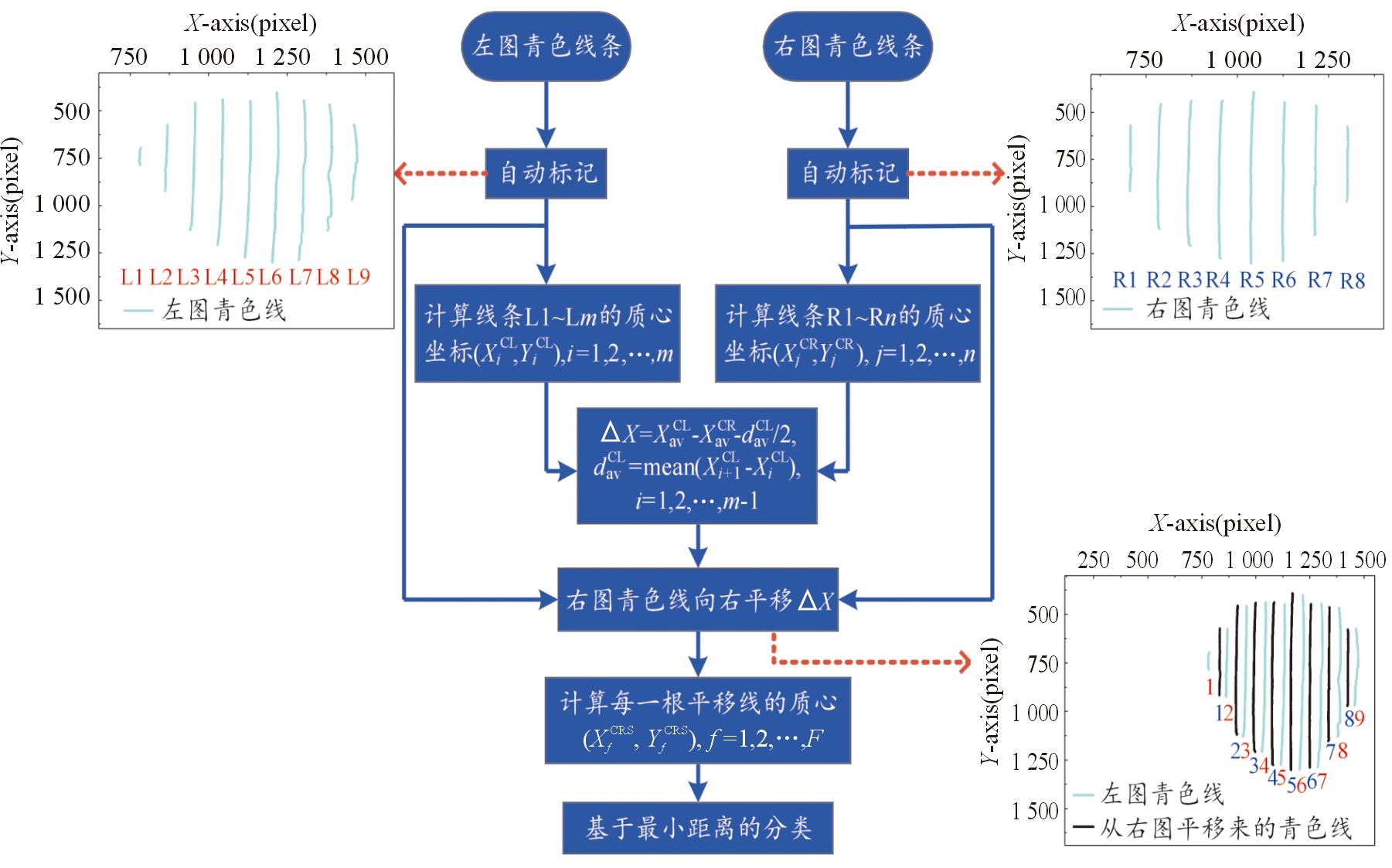

首先,匹配青色线。图9展示了青色线匹配方法的流程图,它包含以下几步:

图9 青色线匹配方法的流程图

Fig.9 The flowchart of the matching method for the cyan lines

第1步:标记左图中的青色线并且计算其中每一根青色线的质心![]() 表示左图青色线,m表示左图中青色线的总数量。然后,标记右图的青色线并且计算其中每一根青色线的质心

表示左图青色线,m表示左图中青色线的总数量。然后,标记右图的青色线并且计算其中每一根青色线的质心![]() 表示右图青色线,n表示右图中青色线的总数量。

表示右图青色线,n表示右图中青色线的总数量。

第2步:计算左图中所有青色线质心的平均值![]() 和右图中所有青色线质心的平均值

和右图中所有青色线质心的平均值![]() 另外,计算左图中所有质心水平坐标之间的平均距离

另外,计算左图中所有质心水平坐标之间的平均距离![]() 通过计算

通过计算![]() 得出这两个平均值之间的平移距离ΔX。

得出这两个平均值之间的平移距离ΔX。

第3步:右图中的所有青色线向右平移ΔX。很明显,在任意相邻的两根平移青色线之间有一根来自左图的青色线。更重要的是,平移距离ΔX使得右图中的青色线在平移之后位于它们左图对应青色线的左边。然后,计算每一根平移青色线的质心![]() 表示平移后的右图青色线,F表示平移青色线的总数目。最后,青色线基于最小距离的分类进行匹配,根据以下规则给平移后的右图青色线分配左图青色线的标记号码:(1)平移后的右青色线在左青色线的左边。(2)平移后的右青色线与左青色线距离最近,即

表示平移后的右图青色线,F表示平移青色线的总数目。最后,青色线基于最小距离的分类进行匹配,根据以下规则给平移后的右图青色线分配左图青色线的标记号码:(1)平移后的右青色线在左青色线的左边。(2)平移后的右青色线与左青色线距离最近,即![]() 与

与![]() 之间的距离最近。

之间的距离最近。

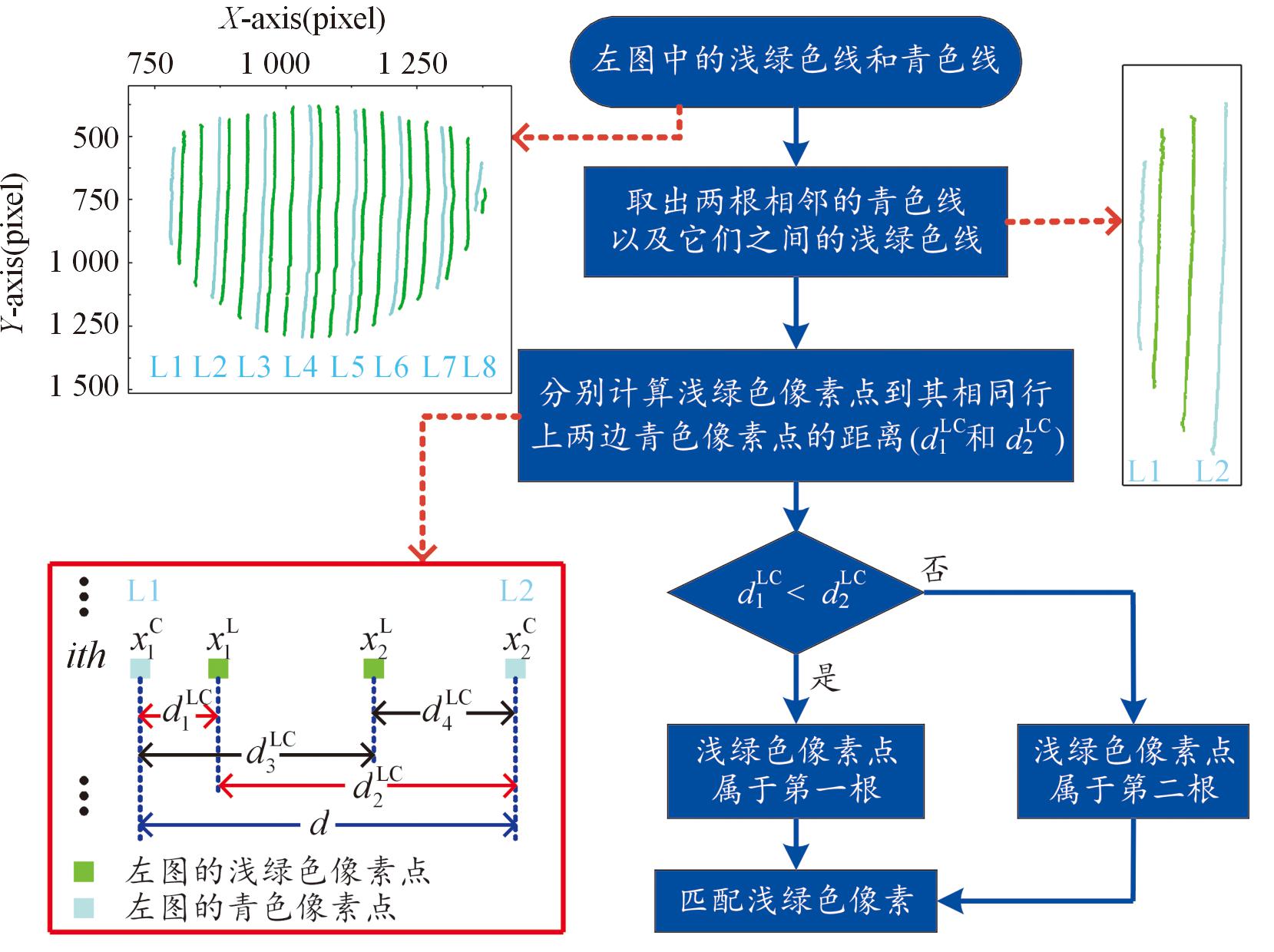

根据四色线图案的排列特征可知,在两根相邻的青色线之间有两根浅绿色线和紫色线。因此,浅绿色线和紫色线都基于青色线进行匹配。图10展示了浅绿色线匹配方法的流程图。L1表示左图第一根青色线,L2表示左图第二根青色线。不同于青色线的匹配方法,浅绿色线的匹配方法是基于像素而不是基于线的,它包括以下几步:

图10 浅绿色线匹配方法的流程图

Fig.10 The flowchart of the matching method for the light green lines

第1步:选出两根相邻的青色线以及它们之间的浅绿色线。对于每一根青色线,它最顶端的像素用一根垂直的直线向上延伸,同时它最底端的像素用一根垂直的直线向下延伸。这样,每个浅绿色像素所在行的两边必有一个青色像素。

第2步:计算每一行上浅绿色像素到其两边相邻青色像素之间的距离![]() 和

和![]() 表示浅绿色像素到它左边青色像素的距离。

表示浅绿色像素到它左边青色像素的距离。![]() 表示浅绿色像素到它右边青色像素的距离。

表示浅绿色像素到它右边青色像素的距离。

第3步:根据浅绿色像素是属于第一根线或是第二根线来匹配。如果距离![]() 比距离

比距离![]() 小,则浅绿色像素

小,则浅绿色像素![]() 属于第一根线。如果距离

属于第一根线。如果距离![]() 比距离

比距离![]() 大,则浅绿色像素

大,则浅绿色像素![]() 属于第二根线。如果距离

属于第二根线。如果距离![]() 比距离

比距离![]() 小,则浅绿色像素

小,则浅绿色像素![]() 属于第一根线。如果距离

属于第一根线。如果距离![]() 比距离

比距离![]() 大,则浅绿色像素

大,则浅绿色像素![]() 属于第二根线。

属于第二根线。![]() 和

和![]() 分别表示左图第ith行上左边青色线上的像素和右边青色线上的像素。请注意,

分别表示左图第ith行上左边青色线上的像素和右边青色线上的像素。请注意,![]() 在许多情况下可能是不存在的。该匹配方法是根据浅绿色线和青色线的相对位置关系设计的,请参考图3(a)所示设计的图案。对于第一根青色线左边的浅绿色线,计算浅绿色像素到相同行第一根青色线上像素之间的距离

在许多情况下可能是不存在的。该匹配方法是根据浅绿色线和青色线的相对位置关系设计的,请参考图3(a)所示设计的图案。对于第一根青色线左边的浅绿色线,计算浅绿色像素到相同行第一根青色线上像素之间的距离![]() 如果

如果![]() 那么浅绿色像素属于第一根线。如果

那么浅绿色像素属于第一根线。如果![]() 那么浅绿色像素属于第二根线。d表示在相同行上2个相邻青色像素之间的平均距离。对于最后一根青色线右边的浅绿色线,计算浅绿色像素到相同行最后一根青色线上像素之间的距离

那么浅绿色像素属于第二根线。d表示在相同行上2个相邻青色像素之间的平均距离。对于最后一根青色线右边的浅绿色线,计算浅绿色像素到相同行最后一根青色线上像素之间的距离![]() 如果

如果![]() 那么浅绿色像素属于第一根线。如果

那么浅绿色像素属于第一根线。如果![]() 那么浅绿色像素属于第二根线。

那么浅绿色像素属于第二根线。

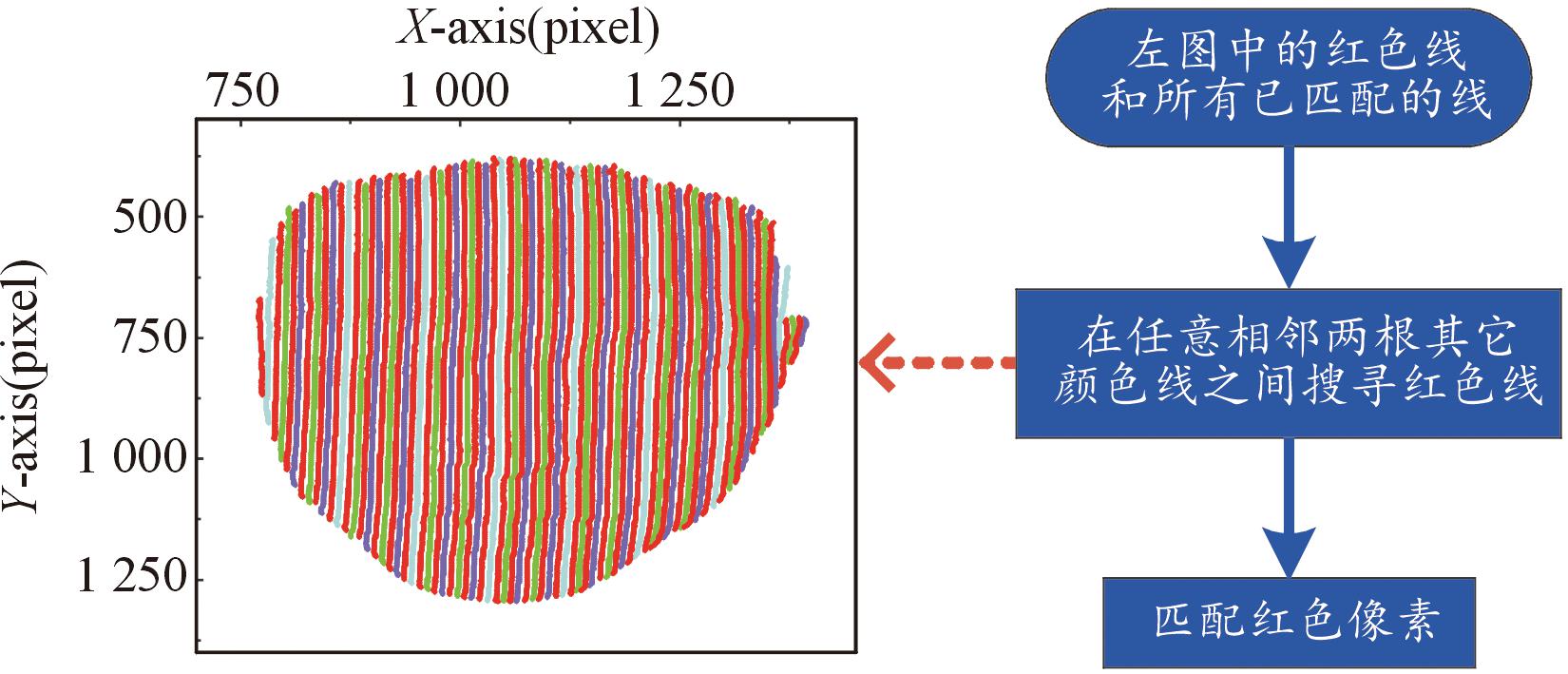

紫色线的匹配方法与浅绿色线的匹配完全一样。最后,对红色线进行匹配。根据设计的图案可知,在两条相邻的红线之间有一条其他颜色的线,反之亦然。图11展示了红色线匹配方法的流程图。

图11 红色线匹配方法的流程

Fig.11 The flowchart of the matching method for the red lines

第1步:在左图中从左到右依次挑出两根相邻的其他颜色线。

第2步:在两根相邻的其他颜色线之间搜索红色像素。

第3步:根据已匹配的青色线,浅绿色线和紫色线匹配红色像素。

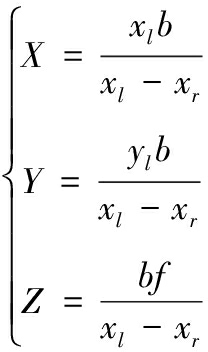

1.4 深度视差法

图12为视差法的原理图。图中三维点A(X,Y,Z)与两相机光心的连线分别交左右相机平面于点a和点a′,点a与点a′可通过所提方法确定并且得出两点在各自相机平面中的位置坐标(xl,yl)和(xr,yr)。最后,根据由相似三角形原理推导的视差公式计算点A的三维坐标。所有点的三维坐标都由视差公式(8)计算:

(8)

图12 视差法的原理图

Fig.12 The principle diagram of the disparity method

式中:基线b为两相机光心之间的距离OO′, f为左相机的焦距,即光心O到左相机平面中心的距离。实验中两相机为同一型号,故焦距相同。参数b,f,O和O′可以通过双目相机标定获得。

2 实验结果

2.1 实验误差分析

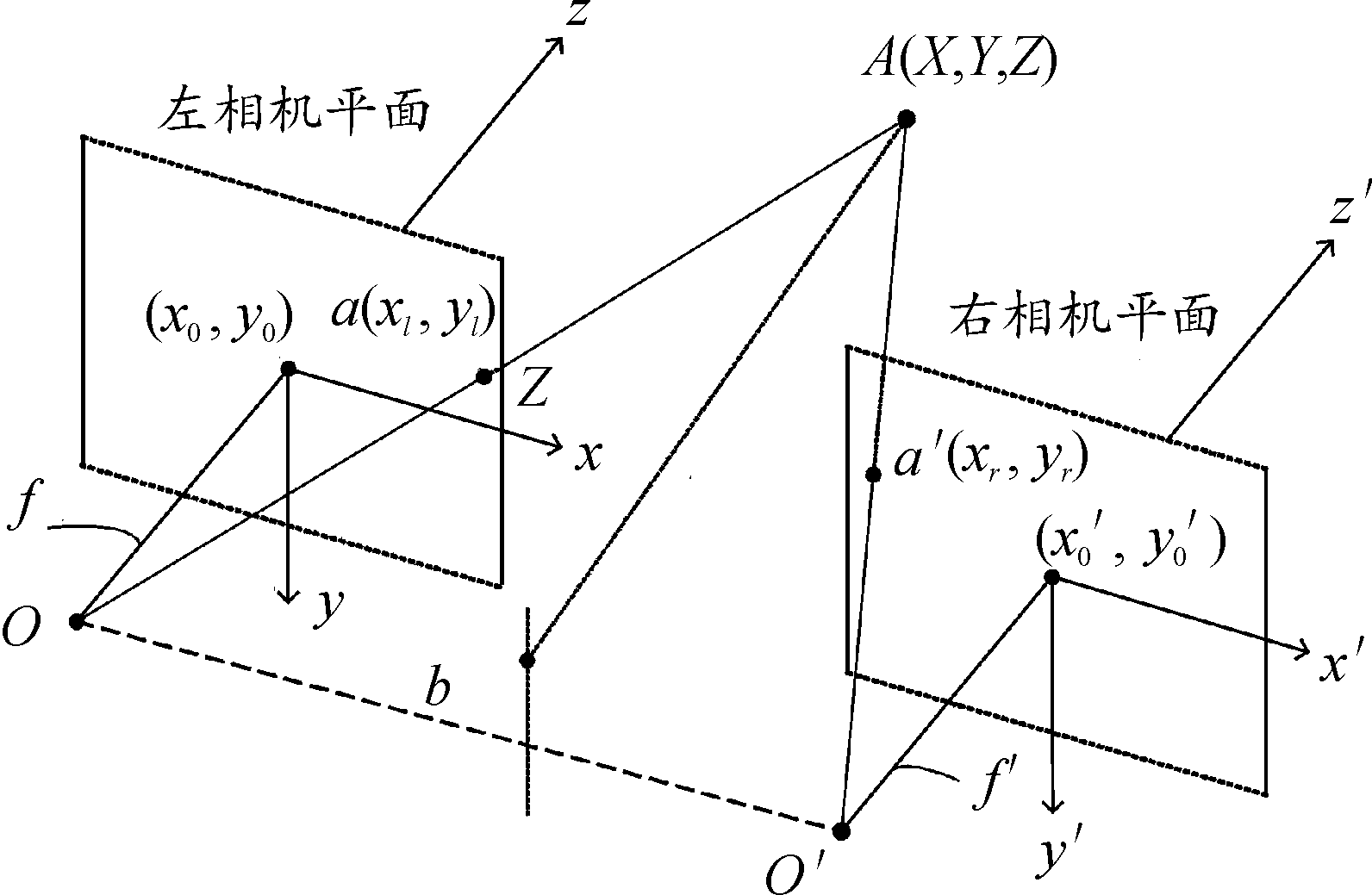

图13(a)展示了该实验中的图像采集系统,其中使用一台NEC NPP451X+3LCD投影仪将设计的线图案投射在被测物体表面,然后,2台分辨率为2 048×1 536的BFLY-PGE-31S4C-C相机实时地采集图像。如图13(b)所示,选用带有24个标记圆的栅格板来测量实验误差且这24个标记圆的质心坐标是已知的。24个标记圆质心的真实坐标与它们测量坐标之间的平均距离作为平均测量误差。![]() 表示第i个标记点的真实坐标与它测量坐标之间的距离,距离

表示第i个标记点的真实坐标与它测量坐标之间的距离,距离![]() 由式(9)计算:

由式(9)计算:

![]()

(9)

图13 图像采集系统和评估实验误差的栅格板

Fig.13 The image acquisition system and the grid used for evaluating experimental error

式中:![]() 是第i个标记点的测量坐标,

是第i个标记点的测量坐标,![]() 是第i个标记点的真实坐标。全部标记圆的真实坐标与测量坐标之间的平均距离误差(EMD)由式(10)计算:

是第i个标记点的真实坐标。全部标记圆的真实坐标与测量坐标之间的平均距离误差(EMD)由式(10)计算:

![]()

(10)

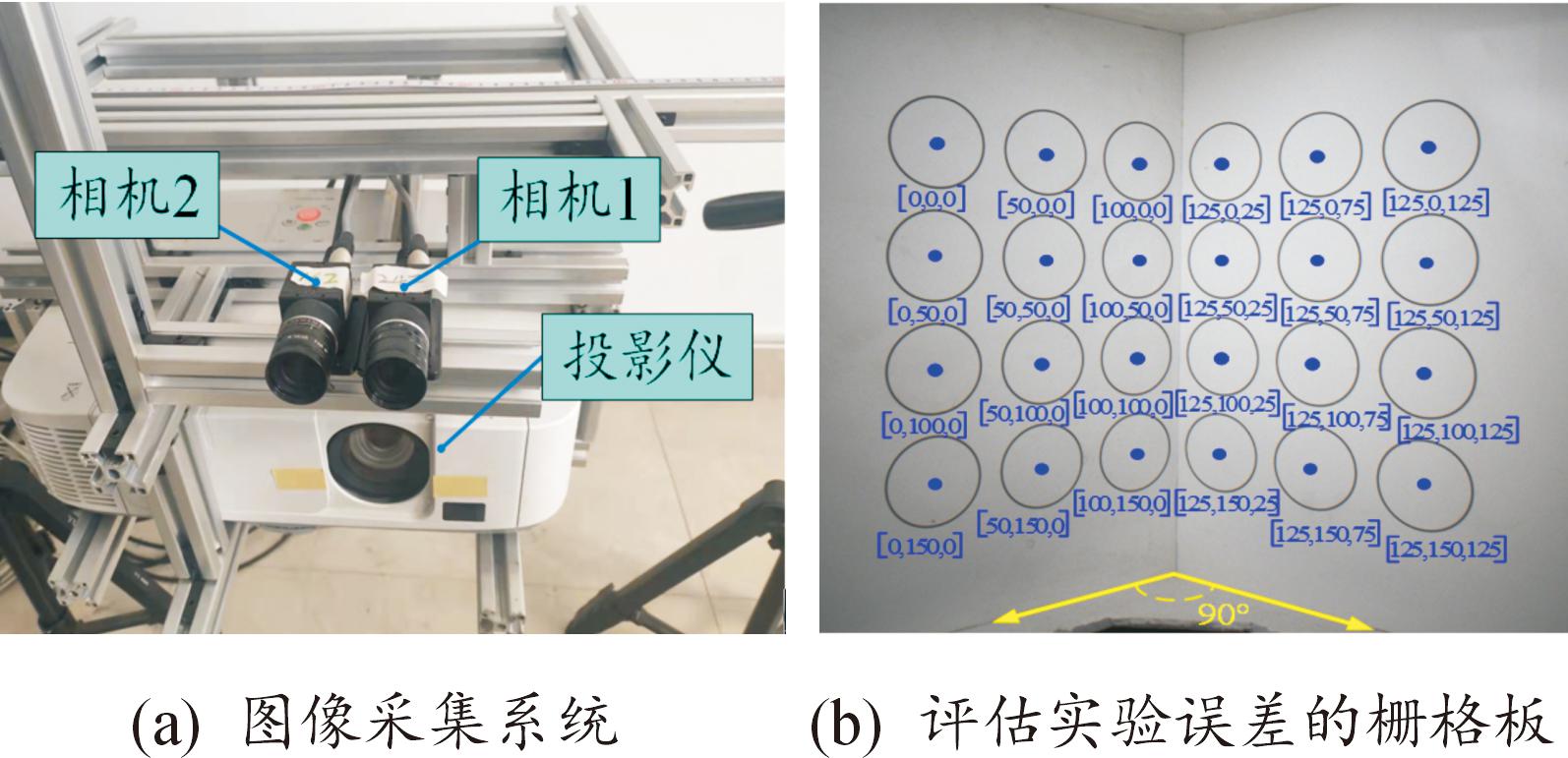

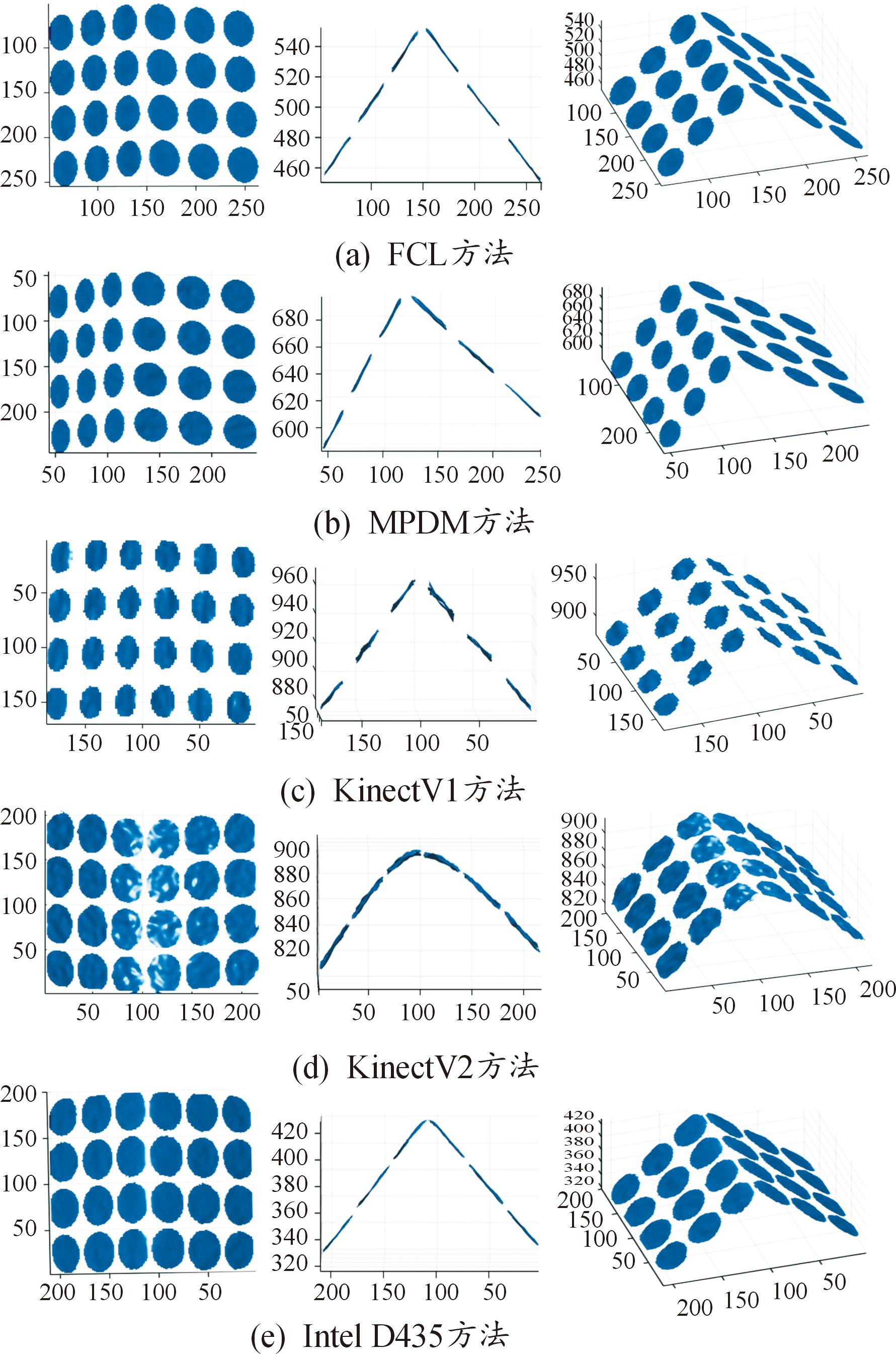

图14展示了提出的方法,MPDM,KinectV1,KinectV2和Intel D435对栅格板重建结果之间的定性比较。从图14中可以看出,所提方法重建的板子结果比MPDM, KinectV1,KinectV2和Intel D435重建的板子结果准确度要更高。这些方法的重建误差值由式(10)计算,其结果被展示在表1中。从表1中可以看出所提方法的测量误差最小。

表1 不同三维重建方法对栅格板的测量误差

Table 1 The measurement errors of different 3D reconstruction methods for the grid

测量方法测量误差/mmKinect V113.104 1Kinect V25.874 5Intel D4350.908 2MPDM0.390 8提出的方法(FCL)0.382 5

图14 提出的方法,MPDM,KinectV1,KinectV2和Intel D435重建栅格板结果之间的定性比较

Fig.14 Qualitative comparison of the proposed approach,MPDM,KinectV1,KinectV2,Intel D435 in reconstructing the grid

2.2 所提方法的有效性验证

为了进一步测试提出方法的有效性,图15展示了不同类型物体的重建结果。此外,KinectV1、KinectV2、Intel D435以及MPDM方法对测试物体的重建结果也被展示在图15中。通过图15中重建结果的定性比较可以看出,所提方法重建的结果最为准确,即重建结果与原图物体最为相像。MPDM方法重建的结果第二准确,Intel D435重建的结果第三准确,KinectV2重建的结果第四准确,KinectV1重建的结果最差。

图15 KinectV1,KinectV2,Intel D435,MPDM和所提方法重建不同类型物体结果之间的定性比较

Fig.15 Qualitative comparison of KinectV1,KinectV2,Intel D435,MPDM and the proposed approach in reconstructing different types of objects

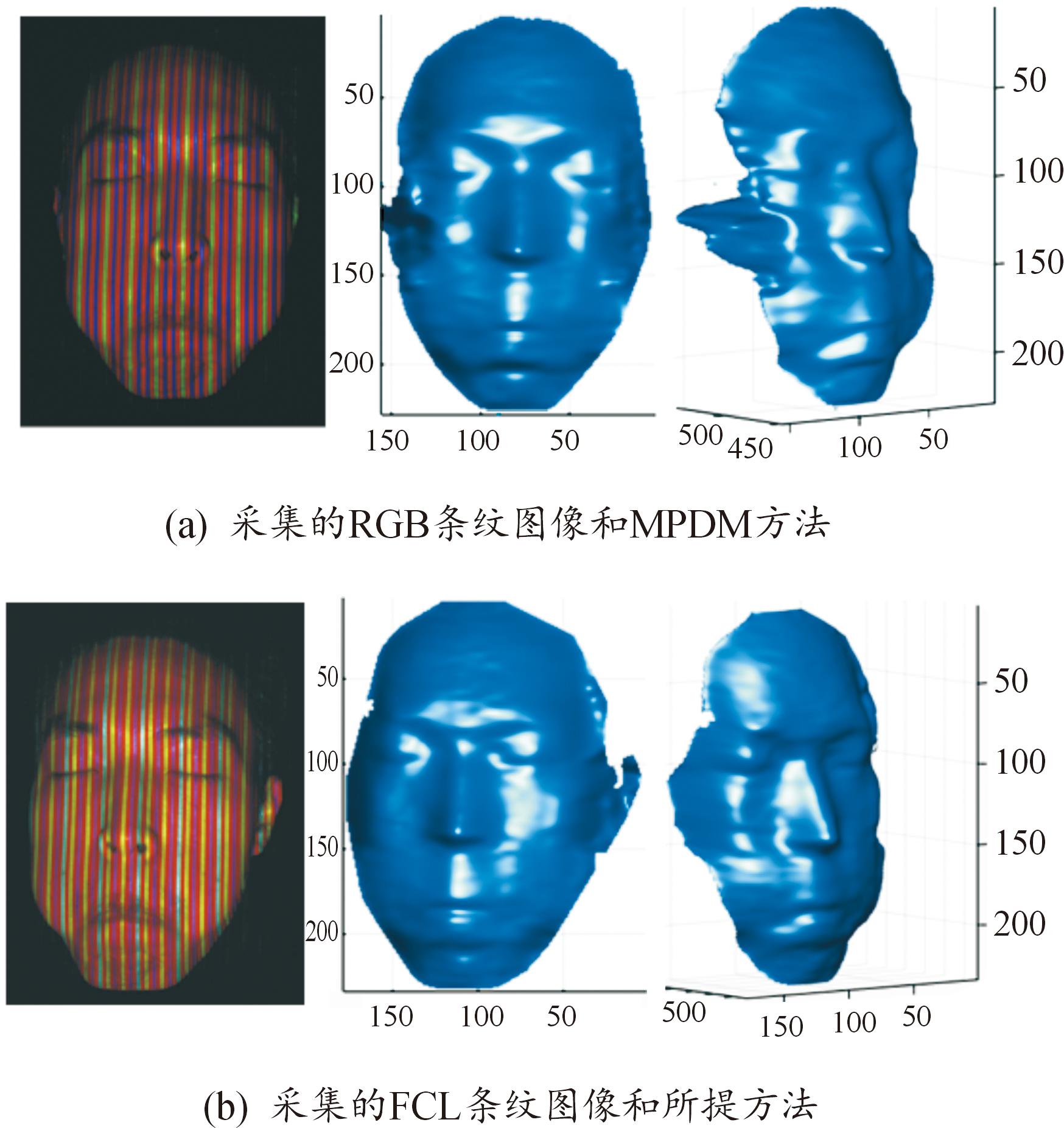

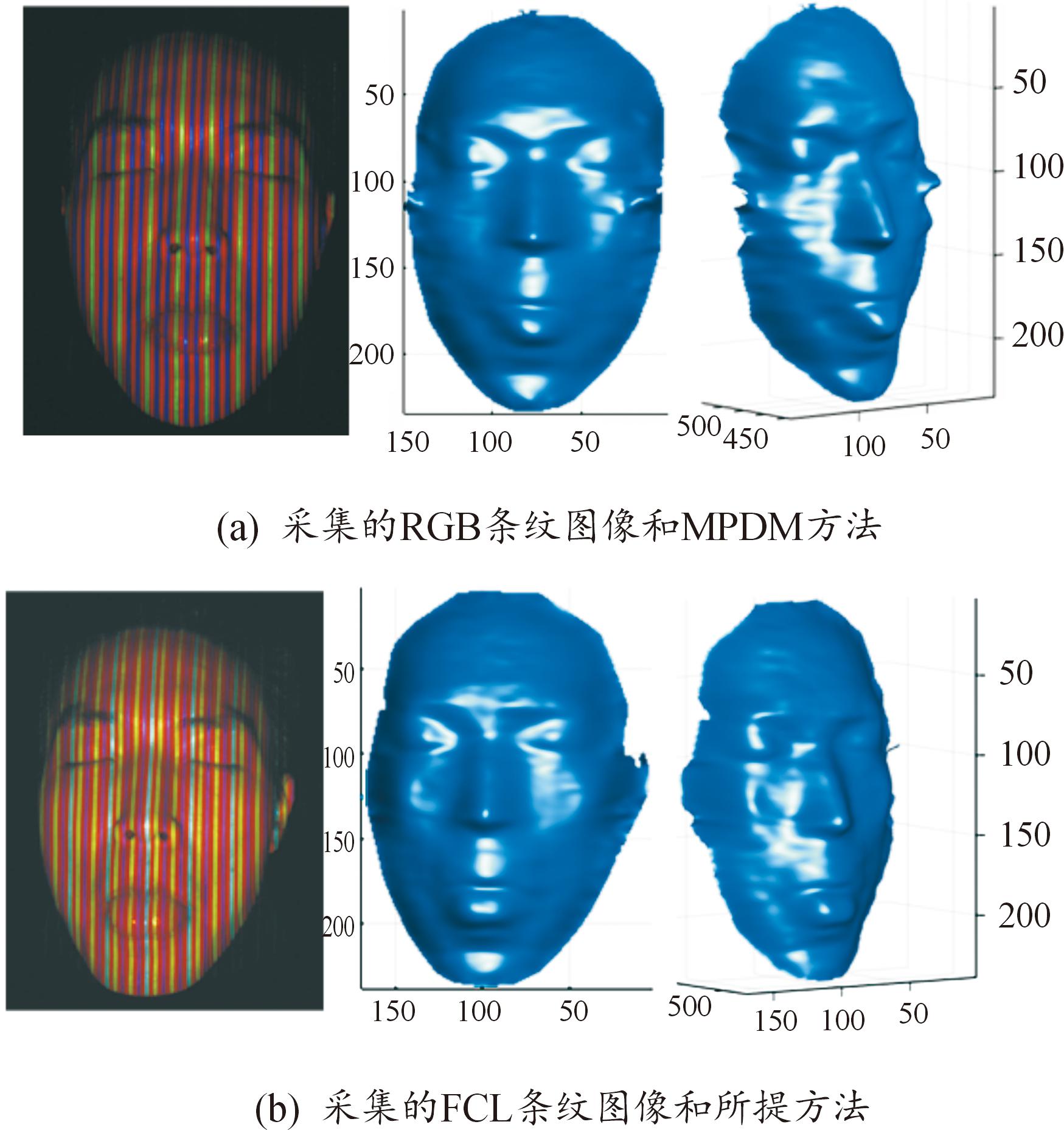

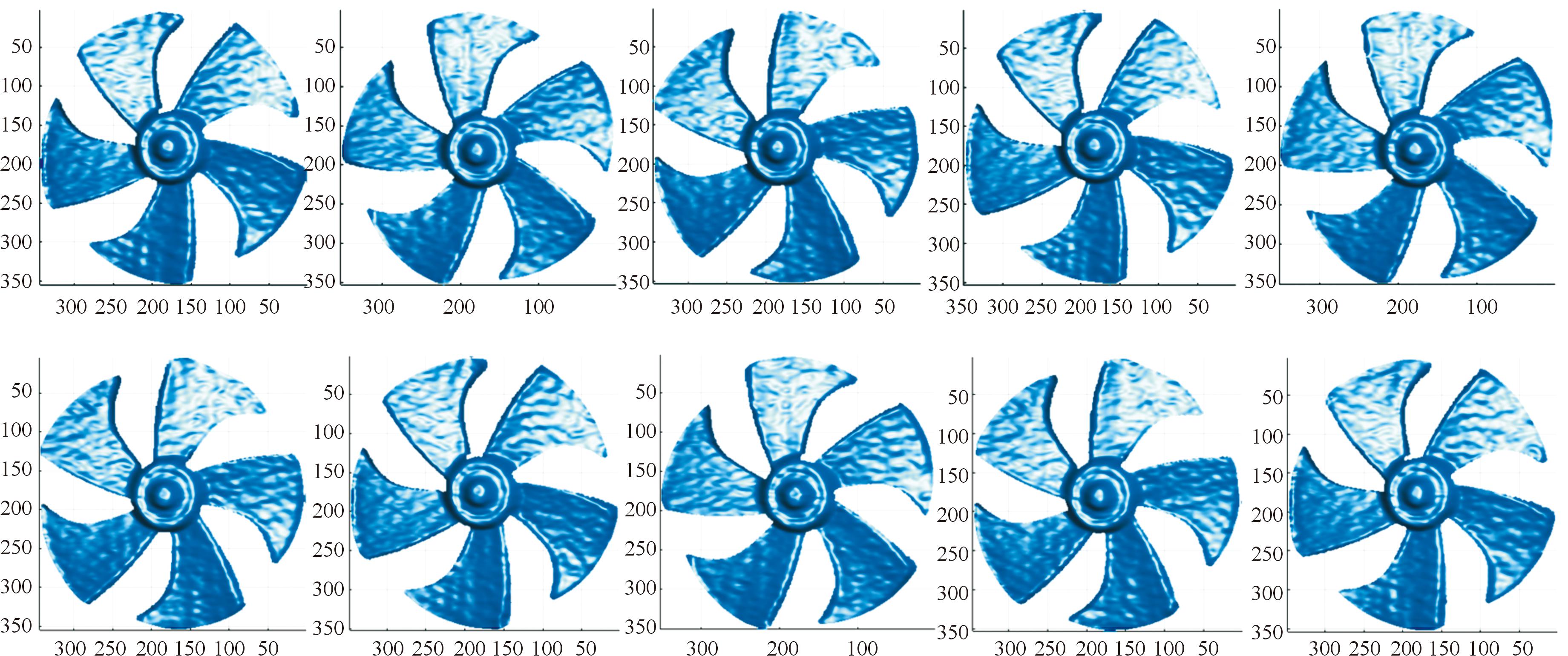

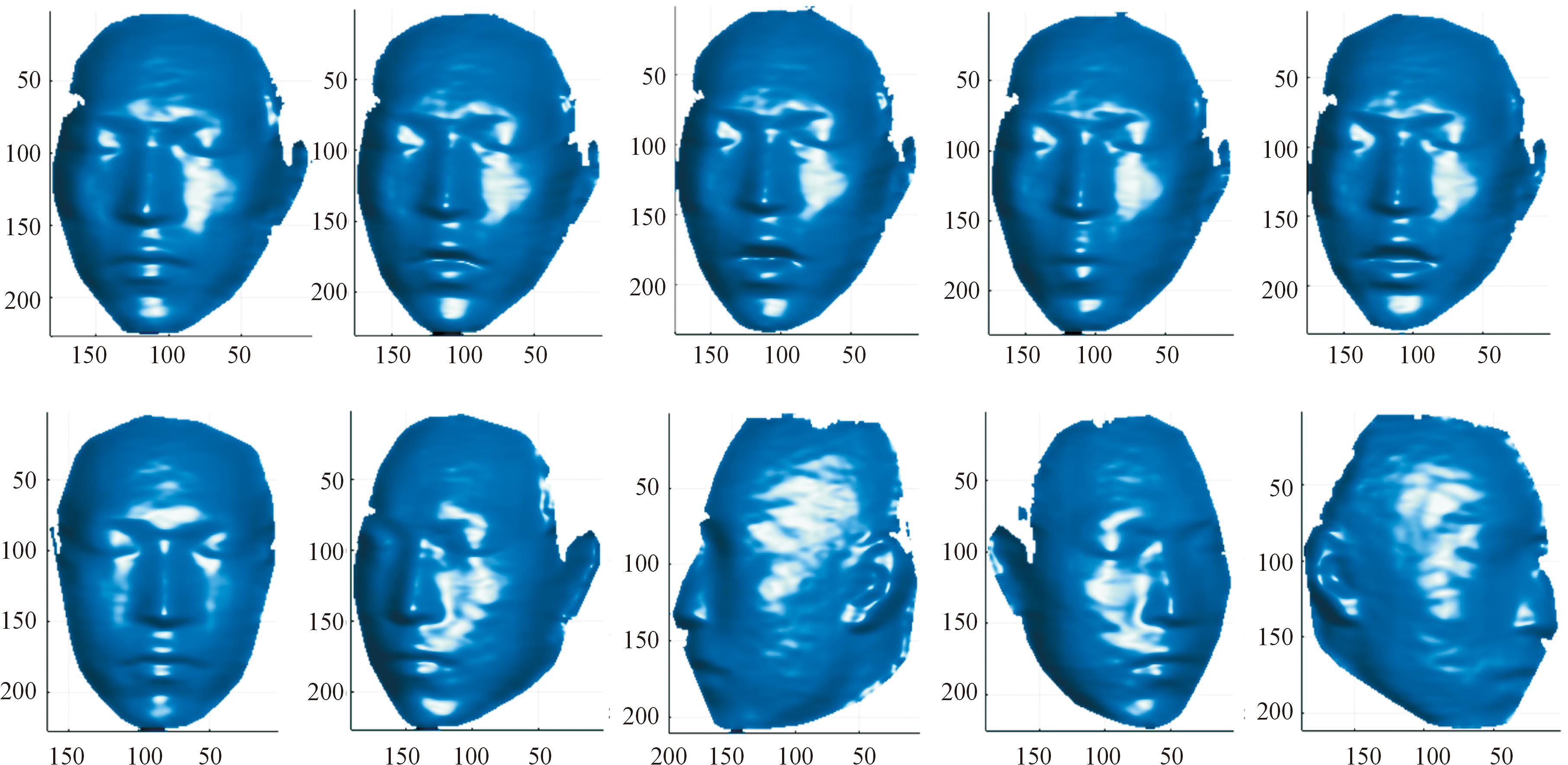

为了进一步证明提出方法的鲁棒性,图16和图17用所提方法与文献[22]中的MPDM方法重建动态人脸进行比较。从图中可以看出,MPDM方法不能鲁棒地预测待测人脸的边缘部位,这是因为人脸的深度变化范围相对较大。图18展示了所提方法在重建动态风扇视频中的10帧重建结果。图19展示了所提方法在重建动态人脸视频中的10帧重建结果。图18和图19分别呈现了风扇和人脸在不同时刻下的形貌特征信息。动态风扇和动态人脸的重建结果表明所提方法能够对动态目标进行鲁棒地三维重建。

图16 所提方法与MPDM方法测量带有面部表情1的动态人脸结果的定性比较

Fig.16 Qualitative comparison of the proposed method with the MPDM method in measuring the dynamic face with facial expression1

图17 所提方法与MPDM方法测量带有表情2的动态人脸结果的定性比较

Fig.17 Qualitative comparison of the proposed method with the MPDM method in measuring the dynamic face with facial expression2

图18 所提方法在重建动态风扇视频中的10帧重建结果

Fig.18 Ten frames reconstruction results in reconstructing the dynamic fan video by the proposed method

图19 所提方法在重建动态人脸视频中的10帧重建结果

Fig.19 Ten frames reconstruction results in reconstructing the dynamic human face video by the proposed method

为了更直观地将所提方法和现存的其他方法进行比较,附加了采用不同方法重建的动态风扇视频fan.mp4和动态人脸视频face.mp4。视频可登录以下网址查看:https://space.bilibili.com/1936799376/video。正如看到的,在重建动态物体时,所提方法比现有的其他方法更具鲁棒性。

3 结论

1) 4种颜色线图案能够在被测物体表面提供大量的特征信息,提高了测量精度和重建分辨率。

2) SDD阈值选择方法可以在HSV颜色空间中鲁棒地提取出四种颜色线,具有较好的分割效果。

3) 四线双目立体视觉匹配算法与MPDM方法相比,其在测量深度变化范围较大的目标时具有更强的鲁棒性。此外,在与最先进一拍法测量技术(KinectV1,KinectV2和Intel D435)的比较中,四线测量法在重建静态和动态目标时具有更好的测量效果。

[1] AGUILAR J J,TORRES F,LOPE M A.Stereo vision for 3D measurement:accuracy analysis,calibration and industrial applications[J].Measurement,1996,18(4):193-200.

[2] TIPPETTS B,LEE D J,LILLYWHITE K,et al.Review of stereo vision algorithms and their suitability for resource-limited systems[J].Journal of Real-Time Image Processing,2016,11:5-25.

[3] WANG Z Z.Removal of noise and radial lens distortion during calibration of computer vision systems[J].Optics Express,2015,23(9):11341-11356.

[4] ZHANG X,CHEN L,ZHANG F F,et al.Research on the accuracy and speed of three-dimensional reconstruction of liver surface based on binocular structured light[J].IEEE Access,2021,9:87592-87610.

[5] WANG Z Z.Review of real-time three-dimensional shape measurement techniques[J].Measurement,2020,156:107624.

[6] ZHANG S.Flexible and high-accuracy method for uni-directional structured light system calibration[J].Optics and Lasers in Engineering,2021,143:106637.

[7] GORTHI S S,RASTOGI P.Fringe projection techniques:whither we are?[J].Optics and Lasers in Engineering,2010,48:133-140.

[8] KHAN D,SHIRAZI M A,KIM M Y.Single shot laser speckle based 3D acquisition system for medical applications[J].Optics and Lasers in Engineering,2018,105:43-53.

[9] FU K R,XIE Y J,JING H L,et al.Fast spatial-temporal stereo matching for 3D face reconstruction under speckle pattern projection[J].Image and Vision Computing,2019,85:36-45.

[10] HEIST S,LUTZKE P,DIETRICH P,et al.Experimental comparison of laser speckle projection and array projection for high-speed 3D measurements[C]//Optical Measurement Systems for Industrial Inspection IX.SPIE,2015,9525:282-289.

[11] YANG X,CHEN X B,XI J T.Error suppression for speckle correlation-based 3D shape measurement via dynamic shape function selection[J].Optics Communications,2022,508:127584.

[12] LIU X R,KOFMAN J.Real-time 3D surface-shape measurement using background-modulated modified Fourier transform profilometry with geometry-constraint[J].Optics and Lasers in Engineering,2019,115:217-224.

[13] WANG Z Z.An imaging and measurement system for robust reconstruction of weld pool during arc welding[J].IEEE Transactions on Industrial Electronics,2015,62(8):5109-5118.

[14] WANG Z Z,ZHOU Q,SHUANG Y C.Three-dimensional reconstruction with single-shot structured light dot pattern and analytic solutions[J].Measurement,2020,151:107114.

[15] WONG A K C,NIU P,HE X.Fast acquisition of dense depth data by a new structured light scheme[J].Computer Vision &Image Understanding,2005,98(3):398-422.

[16] LI B Z,XU Z J,GAO F,et al.3D reconstruction of high reflective welding surface based on binocular structured light stereo vision[J].Machines,2022,10(2):159.

[17] CHEN B Q,SHI P,LI H S,et al.Three-dimensional imaging and reconstructions of objects under rainy conditions using the generation and propagation of coherent structured signal[J].IEEE Photonics Journal,2022,14(1):1-10.

[18] WEI H,MENG L J.An accurate stereo matching method based on color segments and edges[J].Pattern Recognition,2022,133:108996.

[19] YANG G W,WANG Y Z.Three-dimensional measurement of precise shaft parts based on line structured light and deep learning[J].Measurement,2022,191:110837.

[20] LI H M,CAO Y P,WANG Y P,et al.Composite-structured-light profilometry using greyscale expansion[J].Optik,2020,212:164711.

[21] WANG J H,YANG Y X.3D surface reconstruction scheme for dynamic objects:Principle and implementation[J].Measurement,2022,201:111718.

[22] LI Y K,WANG Z Z.RGB line pattern-based stereo vision matching for single-shot 3-D measurement[J].IEEE Transactions on Instrumentation and Measurement,2021,70:1-13.

[23] SHUANG Y C,WANG Z Z.Active stereo vision three-dimensional reconstruction by RGB dot pattern projection and ray intersection[J].Measurement,2021,167:108-195.

[24] WANG Z Z,YANG Y M.Single-shot three-dimensional reconstruction based on structured light line pattern[J].Optics and Lasers in Engineering,2018,106:10-16.

[25] BILESAN A,OWLIA M,BEHZADIPOUR S,et al.Marker-based motion tracking using Microsoft Kinect[J].IFAC-PapersOnLine,2018,51(22):399-404.

[26] ÖZSOY U,YILDIRIM Y,KARASIN S,et al.Reliability and agreement of Azure Kinect and Kinect v2 depth sensors in the shoulder joint range of motion estimation[J].Journal of Shoulder and Elbow Surgery,2022,31(10):2049-2056.

[27] CHEN Y,ZHANG B H,ZHOU J,et al.Real-time 3D unstructured environment reconstruction utilizing VR and Kinect-based immersive teleoperation for agricultural field robots[J].Computers and Electronics in Agriculture,2020,175:105579.

[28] JIN X,TANG L M,LI R S,et al.Edge recognition and reduced transplantation loss of leafy vegetable seedlings with Intel RealsSense D415 depth camera[J].Computers and Electronics in Agriculture,2022,198:107030.

[29] WANG Z Z.Image segmentation by combining the global and local properties[J].Expert Systems with Applications,2017,87:30-40.